Anything in Any Scene:逼真物体插入(助力各类驾驶数据合成)

原标题:Anything in Any Scene: Photorealistic Video Object Insertion

论文链接:https://arxiv.org/pdf/2401.17509.pdf

代码链接:https://github.com/AnythingInAnyScene/anything_in_anyscene

作者单位:小鹏汽车

论文思路

逼真的(realistic)视频仿真(video simulation)在从虚拟现实到电影制作等各种应用领域都显示出巨大的潜力。尤其是在现实世界中捕捉视频不切实际或成本高昂的情况下。视频仿真中的现有方法通常无法准确地建模光照环境、表示物体几何形状或实现高水平的照片级真实感。本文提出了 Anything in Any Scene ,这是一种新颖且通用的真实视频仿真框架,可以将任何物体无缝插入到现有的动态视频中,并强调物理真实感。本文提出的总体框架包含三个关键过程:1)将真实的物体集成到给定的场景视频中,并放置适当的位置以确保几何真实感(geometric realism);2)估计天空和环境光照分布并模拟真实阴影,增强光照真实感(light realism);3)采用风格迁移网络来细化最终的视频输出,以最大限度地提高照片真实感(photorealism)。本文通过实验证明 Anything in Any Scene 框架可以生成具有出色的几何真实感、光照真实感和照片真实感的仿真视频。通过显着缓解与视频数据生成相关的挑战,本文的框架为获取高质量视频提供了高效且经济高效的解决方案。此外,其应用远远超出了视频数据增强的范围,在虚拟现实、视频编辑和各种其他以视频为中心的应用中显示出广阔的潜力。

主要贡献

本文引入了一种新颖且可扩展的 Anything in Any Scene 视频仿真框架,能够将任何物体集成到任何动态场景视频中。

这篇文章的结构独具特色,着重于在视频仿真中保持几何、光照和照片的真实感,以确保输出结果的高质量和真实性。

经过广泛验证,结果表明该框架具备制作高度逼真视频仿真的能力,从而显著拓展了该领域的应用范围和发展潜力。

论文设计

图像和视频仿真在从虚拟现实到电影制作的各种应用中都取得了成功。通过逼真的图像和视频仿真生成多样化和高质量的视觉内容的能力具有推动这些领域发展的潜力,能够引入新的可能性和应用。尽管在现实世界中捕获的图像和视频的真实性非常宝贵,但它们经常受到长尾分布的限制。这导致常见场景的代表性过高,而罕见但关键的情况的代表性不足,从而提出了称为 out-of-distribution problem 的挑战。通过视频采集和编辑来解决这些限制的传统方法被证明是不切实际的或成本过高,因为难以涵盖所有可能的情况。视频仿真的重要性,特别是通过将现有视频与新插入的物体相集成,对于克服这些挑战变得至关重要。通过生成大规模、多样化和逼真的视觉内容,视频仿真有助于增强虚拟现实、视频编辑和视频数据增强方面的应用。

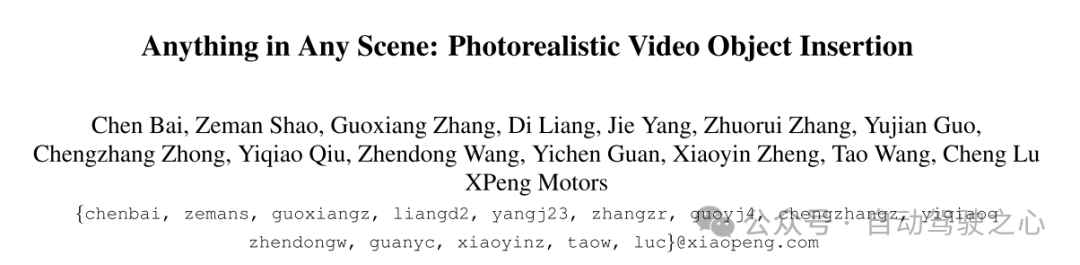

然而,考虑物理真实性生成逼真的仿真视频仍然是一个具有挑战性的开放问题。现有方法通常因专注于特定设置而表现出局限性,特别是室内环境[9,26,45,46,57]。这些方法可能无法充分解决室外场景的复杂性,包括不同的光照条件和快速移动的物体。依赖 3D 模型配准的方法仅限于集成有限类别的物体 [12,32,40,42]。许多方法忽略了一些重要因素,例如光照环境建模、正确的物体放置和实现真实感 [12, 36]。失败的案例如图 1 所示。因此,这些限制极大地限制了它们在需要高度可扩展、几何一致和真实场景视频仿真的领域(例如自动驾驶和机器人)中的应用。

本文提出了一个用于解决这些挑战的逼真视频物体插入的综合框架 Anything in Any Scene。该框架设计具有通用性,适用于室内和室外场景,保证几何真实感、光照真实感和照片真实感等方面的物理准确性。本文的目标是创建视频仿真,不仅有利于机器学习中的视觉数据增强,而且适用于各种视频应用,例如虚拟现实和视频编辑。

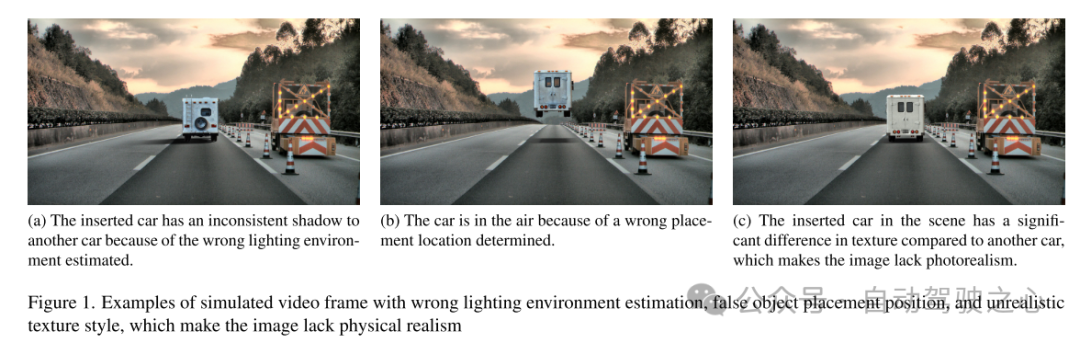

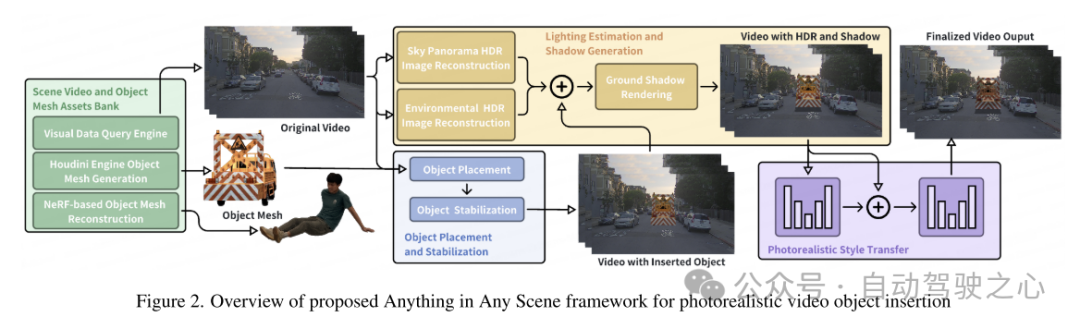

本文的 Anything in Any Scene 框架的概述如图 2 所示。本文在第 3 节中详细介绍了本文新颖且可扩展的流程,用于构建场景视频和物体网格(object mesh)的多样化资产库。本文介绍了一种视觉数据查询引擎,旨在利用描述性关键词从视觉查询中高效检索相关视频片段。接下来,本文提出两种生成 3D meshes 的方法,利用现有 3D 资产以及多视图图像重建。这允许不受限制地插入任何所需的物体,即使它非常不规则或语义较弱。在第 4 节中,本文详细介绍了将物体集成到动态场景视频中的方法,重点是保持物理真实感。本文设计了第 4.1 节中描述的物体放置和稳定方法,确保插入的物体稳定地锚定(anchored)在连续的视频帧上。为了解决创建逼真的光照和阴影效果的挑战,本文估计天空和环境光照并在渲染过程中生成逼真的阴影,如第 4.2 节所述。生成的仿真视频帧不可避免地包含与现实世界捕获的视频不同的不现实的伪影,例如噪声水平、色彩保真度和清晰度方面的成像质量差异。本文在 4.3 节中采用风格迁移网络来增强照片真实感。

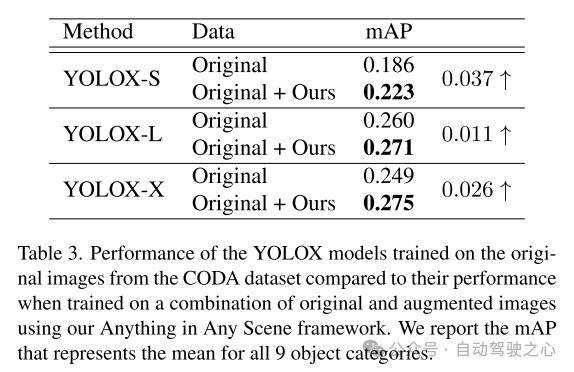

从本文提出的框架生成的仿真视频达到了高度的光照真实感、几何真实感和照片真实感,在质量和数量上都优于其他视频,如第 5.3 节所示。本文在5.4节中进一步展示了本文的仿真视频在训练感知算法中的应用,以验证其实用价值。Anything in Any Scene 框架能够创建大规模、低成本的视频数据集,用于具有时间效率和逼真视觉质量的数据增强,从而减轻视频数据生成的负担,并有可能改善长尾分布和分布外的挑战。凭借其通用的框架设计,Anything in Any Scene 框架可以轻松整合改进的模型和新模块,例如改进的 3D mesh 重建方法,进一步增强视频仿真性能。

图 1. 光照环境估计错误、物体摆放位置错误和纹理风格不真实的仿真视频帧示例,这些问题使得图像缺乏物理真实感。

图 1. 光照环境估计错误、物体摆放位置错误和纹理风格不真实的仿真视频帧示例,这些问题使得图像缺乏物理真实感。 图 2. 用于逼真视频物体插入的 Anything in Any Scene 框架概述

图 2. 用于逼真视频物体插入的 Anything in Any Scene 框架概述 图 3. 用于放置物体的驾驶场景视频示例。每幅图像中的红点是物体插入的位置。

图 3. 用于放置物体的驾驶场景视频示例。每幅图像中的红点是物体插入的位置。

实验结果

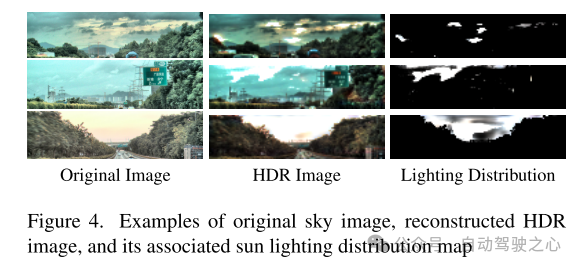

图 4. 原始天空图像、重建的 HDR 图像及其相关的太阳光照分布图的示例

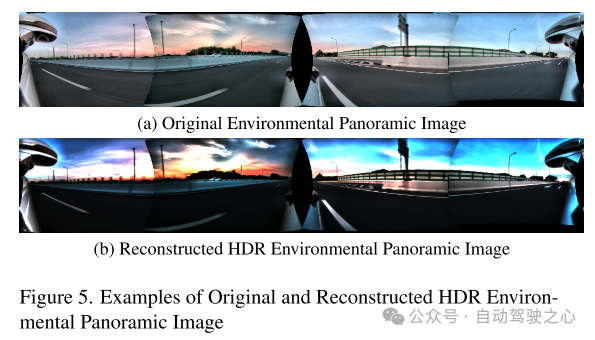

图 5. 原始和重建的 HDR 的环境全景图像示例

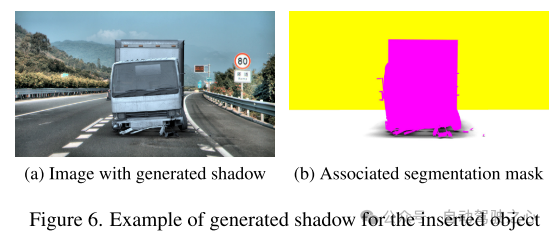

图 6. 为插入的物体生成阴影的示例

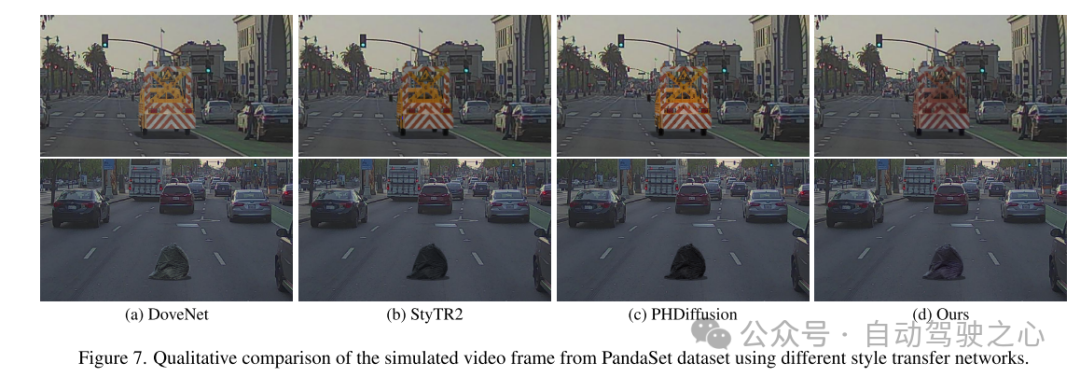

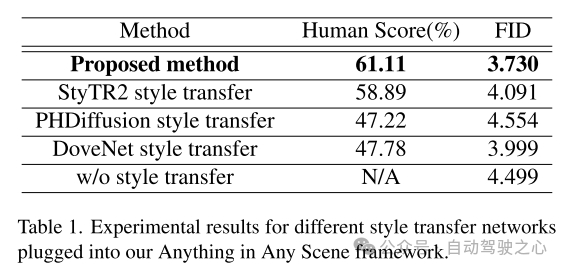

图 7. 使用不同风格迁移网络对 PandaSet 数据集的仿真视频帧进行定性比较。

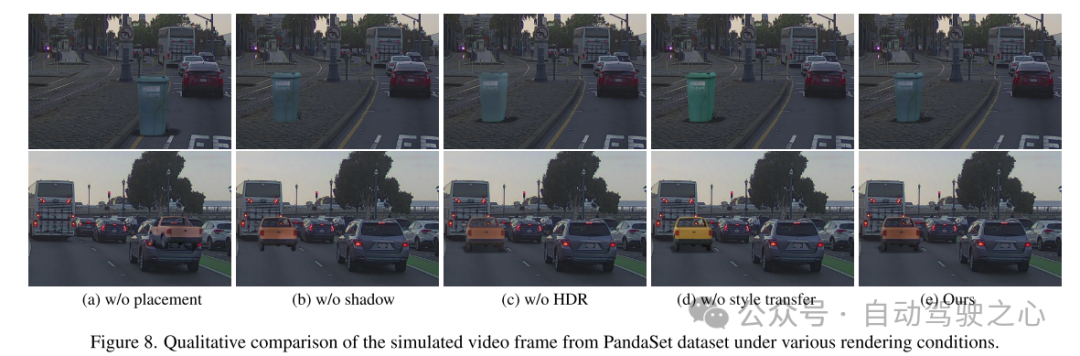

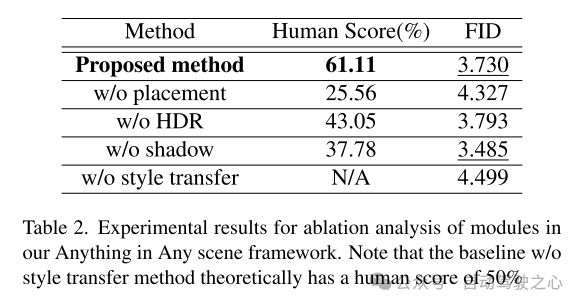

图 8. PandaSet 数据集的仿真视频帧在各种渲染条件下的定性比较。

总结:

本文提出了一个创新且可扩展的框架,”Anything in Any Scene",专为逼真的视频仿真而设计。本文提出的框架将各种物体无缝集成到不同的动态视频中,确保保留几何真实感、光照真实感和照片真实感。通过广泛的演示,本文展示了其在缓解视频数据收集和生成相关挑战方面的功效,提供了适用于各种场景的经济高效且省时的解决方案。本文的框架的应用在下游感知任务中显示出显着的改进,特别是在解决目标检测中的长尾分布问题方面。本文框架的灵活性允许直接集成每个模块的改进模型,本文的框架为逼真视频仿真领域的未来探索和创新奠定了坚实的基础。

引用:

Bai C, Shao Z, Zhang G, et al. Anything in Any Scene: Photorealistic Video Object Insertion[J]. arXiv preprint arXiv:2401.17509, 2024.

以上是Anything in Any Scene:逼真物体插入(助力各类驾驶数据合成)的详细内容。更多信息请关注PHP中文网其他相关文章!

热AI工具

Undresser.AI Undress

人工智能驱动的应用程序,用于创建逼真的裸体照片

AI Clothes Remover

用于从照片中去除衣服的在线人工智能工具。

Undress AI Tool

免费脱衣服图片

Clothoff.io

AI脱衣机

Video Face Swap

使用我们完全免费的人工智能换脸工具轻松在任何视频中换脸!

热门文章

热工具

记事本++7.3.1

好用且免费的代码编辑器

SublimeText3汉化版

中文版,非常好用

禅工作室 13.0.1

功能强大的PHP集成开发环境

Dreamweaver CS6

视觉化网页开发工具

SublimeText3 Mac版

神级代码编辑软件(SublimeText3)

如何用OPPO手机录制屏幕视频(简单操作)

May 07, 2024 pm 06:22 PM

如何用OPPO手机录制屏幕视频(简单操作)

May 07, 2024 pm 06:22 PM

游戏技巧或是进行教学演示,在日常生活中,我们经常需要用手机录制屏幕视频来展示一些操作步骤。其录制屏幕视频的功能也非常出色,而OPPO手机作为一款功能强大的智能手机。让您轻松快速地完成录制任务、本文将详细介绍如何使用OPPO手机来录制屏幕视频。准备工作——确定录制目标您需要明确自己的录制目标、在开始之前。是要录制一个操作步骤的演示视频?还是要录制一个游戏的精彩瞬间?或者是要录制一段教学视频?才能更好地安排录制过程、只有明确目标。打开OPPO手机的录屏功能在快捷面板中找到、录屏功能位于快捷面板中,在

全球最强开源 MoE 模型来了,中文能力比肩 GPT-4,价格仅为 GPT-4-Turbo 的近百分之一

May 07, 2024 pm 04:13 PM

全球最强开源 MoE 模型来了,中文能力比肩 GPT-4,价格仅为 GPT-4-Turbo 的近百分之一

May 07, 2024 pm 04:13 PM

想象一下,一个人工智能模型,不仅拥有超越传统计算的能力,还能以更低的成本实现更高效的性能。这不是科幻,DeepSeek-V2[1],全球最强开源MoE模型来了。DeepSeek-V2是一个强大的专家混合(MoE)语言模型,具有训练经济、推理高效的特点。它由236B个参数组成,其中21B个参数用于激活每个标记。与DeepSeek67B相比,DeepSeek-V2性能更强,同时节省了42.5%的训练成本,减少了93.3%的KV缓存,最大生成吞吐量提高到5.76倍。DeepSeek是一家探索通用人工智

替代MLP的KAN,被开源项目扩展到卷积了

Jun 01, 2024 pm 10:03 PM

替代MLP的KAN,被开源项目扩展到卷积了

Jun 01, 2024 pm 10:03 PM

本月初,来自MIT等机构的研究者提出了一种非常有潜力的MLP替代方法——KAN。KAN在准确性和可解释性方面表现优于MLP。而且它能以非常少的参数量胜过以更大参数量运行的MLP。比如,作者表示,他们用KAN以更小的网络和更高的自动化程度重现了DeepMind的结果。具体来说,DeepMind的MLP有大约300,000个参数,而KAN只有约200个参数。KAN与MLP一样具有强大的数学基础,MLP基于通用逼近定理,而KAN基于Kolmogorov-Arnold表示定理。如下图所示,KAN在边上具

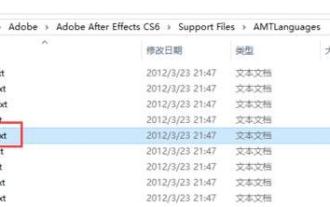

Adobe After Effects cs6(Ae cs6)怎么切换语言 Ae cs6中英文切换的详细步骤-ZOL下载

May 09, 2024 pm 02:00 PM

Adobe After Effects cs6(Ae cs6)怎么切换语言 Ae cs6中英文切换的详细步骤-ZOL下载

May 09, 2024 pm 02:00 PM

1、首先找到AMTLanguages这个文件夹。我们发现了在AMTLanguages文件夹中的一些文档。如果你安装的是简体中文,会有一个zh_CN.txt的文本文档(文本内容为:zh_CN)。如果你安装的是英文,会有一个en_US.txt的文本文档(文本内容为:en_US)。3、所以,如果我们要切换到中文,我们要在AdobeAfterEffectsCCSupportFilesAMTLanguages路径下,新建zh_CN.txt的文本文档(文本内容是:zh_CN)。4、相反如果我们要切换到英文,

抖音如何拍摄视频?拍摄视频麦克风怎么开?

May 09, 2024 pm 02:40 PM

抖音如何拍摄视频?拍摄视频麦克风怎么开?

May 09, 2024 pm 02:40 PM

抖音作为当今最受欢迎的短视频平台之一,其拍摄视频的质量和效果直接影响到用户的观看体验。那么,如何在抖音上拍摄出高质量的视频呢?一、抖音如何拍摄视频?1.打开抖音APP,点击底部中间的“+号”按钮,进入视频拍摄页面。2.抖音提供了多种拍摄模式,包括正常拍摄、慢动作、短视频等。根据需要选择合适的拍摄模式。3.在拍摄页面,点击屏幕下方的“滤镜”按钮,可以选择不同的滤镜效果,使视频更具个性。4.如果需要调整曝光度、对比度等参数,可以点击屏幕左下角的“参数”按钮进行设置。5.拍摄过程中,可以通过点击屏幕左

全面超越DPO:陈丹琦团队提出简单偏好优化SimPO,还炼出最强8B开源模型

Jun 01, 2024 pm 04:41 PM

全面超越DPO:陈丹琦团队提出简单偏好优化SimPO,还炼出最强8B开源模型

Jun 01, 2024 pm 04:41 PM

为了将大型语言模型(LLM)与人类的价值和意图对齐,学习人类反馈至关重要,这能确保它们是有用的、诚实的和无害的。在对齐LLM方面,一种有效的方法是根据人类反馈的强化学习(RLHF)。尽管RLHF方法的结果很出色,但其中涉及到了一些优化难题。其中涉及到训练一个奖励模型,然后优化一个策略模型来最大化该奖励。近段时间已有一些研究者探索了更简单的离线算法,其中之一便是直接偏好优化(DPO)。DPO是通过参数化RLHF中的奖励函数来直接根据偏好数据学习策略模型,这样就无需显示式的奖励模型了。该方法简单稳定

无需OpenAI数据,跻身代码大模型榜单!UIUC发布StarCoder-15B-Instruct

Jun 13, 2024 pm 01:59 PM

无需OpenAI数据,跻身代码大模型榜单!UIUC发布StarCoder-15B-Instruct

Jun 13, 2024 pm 01:59 PM

在软件技术的前沿,UIUC张令明组携手BigCode组织的研究者,近日公布了StarCoder2-15B-Instruct代码大模型。这一创新成果在代码生成任务取得了显着突破,成功超越CodeLlama-70B-Instruct,登上代码生成性能榜单之巅。 StarCoder2-15B-Instruct的独特之处在于其纯自对齐策略,整个训练流程公开透明,且完全自主可控。该模型通过StarCoder2-15B生成了数千个指令,响应对StarCoder-15B基座模型进行微调,无需依赖昂贵的人工标注数

LLM全搞定!OmniDrive:集3D感知、推理规划于一体(英伟达最新)

May 09, 2024 pm 04:55 PM

LLM全搞定!OmniDrive:集3D感知、推理规划于一体(英伟达最新)

May 09, 2024 pm 04:55 PM

写在前面&笔者的个人理解这篇论文致力于解决当前多模态大语言模型(MLLMs)在自动驾驶应用中存在的关键挑战,即将MLLMs从2D理解扩展到3D空间的问题。由于自动驾驶车辆(AVs)需要针对3D环境做出准确的决策,这一扩展显得尤为重要。3D空间理解对于AV来说至关重要,因为它直接影响车辆做出明智决策、预测未来状态以及与环境安全互动的能力。当前的多模态大语言模型(如LLaVA-1.5)通常仅能处理较低分辨率的图像输入(例如),这是由于视觉编码器的分辨率限制,LLM序列长度的限制。然而,自动驾驶应用需