智谱AI推出第三代基座大模型,适配国产芯片

·第三代基座大模型ChatGLM3瞄向视觉模态GPT-4V,提高中文图文理解能力,接入搜索增强,根据问题自动在互联网上查找相关资料并在回答时提供参考文献或文章链接。端测模型ChatGLM3-1.5B和ChatGLM3-3B支持vivo、小米、三星手机及车载平台。

10月27日,在2023中国计算机大会上,中文认知大模型企业北京智谱华章科技有限公司(下称“智谱AI”)推出第三代基座大模型ChatGLM3,采用多阶段增强预训练方法让训练更充分,并推出可部署在手机的ChatGLM3-1.5B和ChatGLM3-3B,支持vivo、小米、三星在内多款手机以及车载平台。

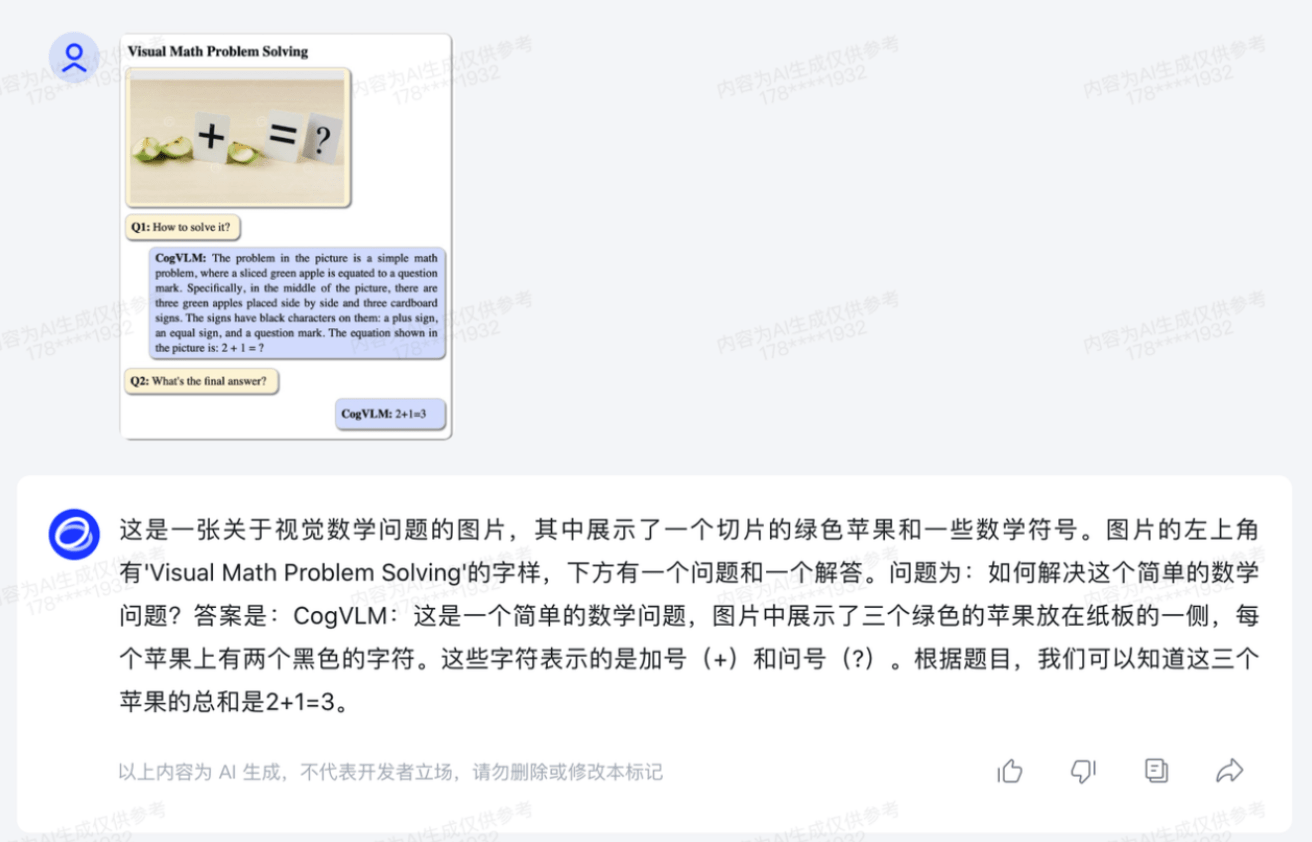

瞄向视觉模态GPT-4V,ChatGLM3实现了若干全新功能的迭代升级,包括多模态理解能力的CogVLM看图识语义在10余个国际标准图文评测数据集上取得SOTA(最佳性能,State-of-the-art)。CogVLM模型提高了中文图文理解能力,可完成复杂的目标检测,并打上标签完成自动数据标注。可根据食材照片给出食谱,根据对话者的口味调整食谱。

根据食材照片给出食谱。

智谱AI首席执行官张鹏对澎湃科技(www.thepaper.cn)表示,多模态大模型已经在语音、视觉、自然语言的交互感知方面有很多具体进展,未来多模态大模型会走向更重要的舞台,可能会融合更多模态的数据,多模态预训练也会导致大模型智能能力或认知能力进一步提升。

可分析图片内容。

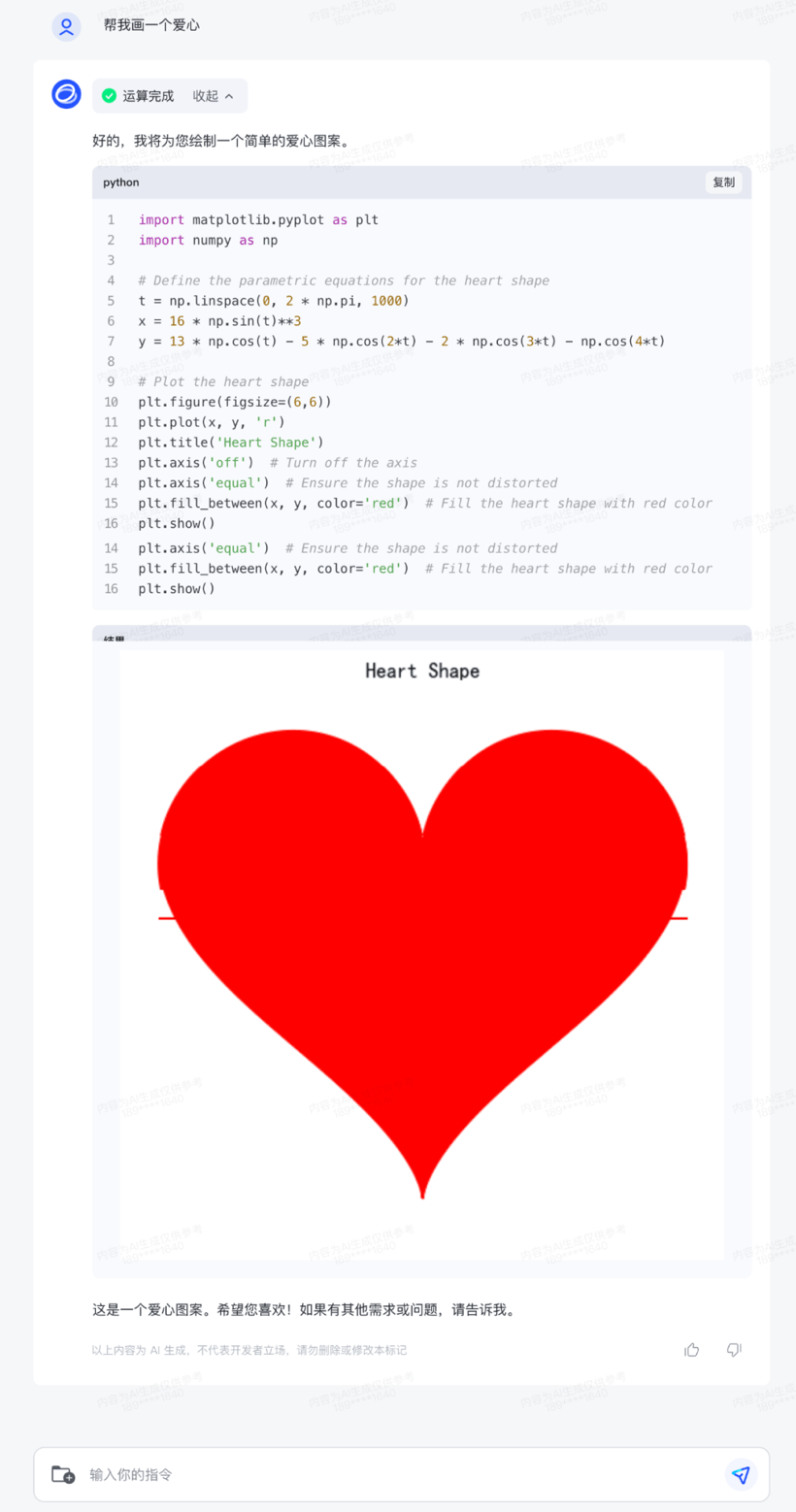

ChatGLM3的代码增强模块Code Interpreter根据用户需求生成代码并执行,自动完成数据分析、文件处理等复杂任务。“代码”功能目前已支持图像处理、数学计算、数据分析等使用场景。

根据用户需求生成代码并执行。

网络搜索增强WebGLM接入搜索增强,能自动根据问题在互联网上查找相关资料并在回答时提供参考文献或文章链接。

ChatGLM3集成了AgentTuning技术,激活了模型智能体能力,并开启了国产大模型原生支持工具调用、代码执行、游戏、数据库操作、知识图谱搜索与推理、操作系统等场景。

目前ChatGLM3推出了可手机部署的端测模型ChatGLM3-1.5B和ChatGLM3-3B,支持vivo、小米、三星在内多款手机以及车载平台,支持移动平台上CPU芯片的推理,速度为20 tokens/s。

端测模型ChatGLM3-1.5B和ChatGLM3-3B支持vivo、小米、三星手机及车载平台。

张鹏表示,自2022年初,智谱AI推出的GLM系列模型已支持在昇腾、神威超算、海光DCU架构上进行大规模预训练和推理。目前智谱AI的产品已支持10余种国产硬件生态,与国产芯片企业的联合创新有助于国产原生大模型与国产芯片的发展。

以上是智谱AI推出第三代基座大模型,适配国产芯片的详细内容。更多信息请关注PHP中文网其他相关文章!

热AI工具

Undresser.AI Undress

人工智能驱动的应用程序,用于创建逼真的裸体照片

AI Clothes Remover

用于从照片中去除衣服的在线人工智能工具。

Undress AI Tool

免费脱衣服图片

Clothoff.io

AI脱衣机

Video Face Swap

使用我们完全免费的人工智能换脸工具轻松在任何视频中换脸!

热门文章

热工具

记事本++7.3.1

好用且免费的代码编辑器

SublimeText3汉化版

中文版,非常好用

禅工作室 13.0.1

功能强大的PHP集成开发环境

Dreamweaver CS6

视觉化网页开发工具

SublimeText3 Mac版

神级代码编辑软件(SublimeText3)

大模型App腾讯元宝上线!混元再升级,打造可随身携带的全能AI助理

Jun 09, 2024 pm 10:38 PM

大模型App腾讯元宝上线!混元再升级,打造可随身携带的全能AI助理

Jun 09, 2024 pm 10:38 PM

5月30日,腾讯宣布旗下混元大模型全面升级,基于混元大模型的App“腾讯元宝”正式上线,苹果及安卓应用商店均可下载。相比此前测试阶段的混元小程序版本,面向工作效率场景,腾讯元宝提供了AI搜索、AI总结、AI写作等核心能力;面向日常生活场景,元宝的玩法也更加丰富,提供了多个特色AI应用,并新增了创建个人智能体等玩法。“腾讯做大模型不争一时之先。”腾讯云副总裁、腾讯混元大模型负责人刘煜宏表示:“过去的一年,我们持续推进腾讯混元大模型的能力爬坡,在丰富、海量的业务场景中打磨技术,同时洞察用户的真实需求

字节跳动豆包大模型发布,火山引擎全栈 AI 服务助力企业智能化转型

Jun 05, 2024 pm 07:59 PM

字节跳动豆包大模型发布,火山引擎全栈 AI 服务助力企业智能化转型

Jun 05, 2024 pm 07:59 PM

火山引擎总裁谭待企业要做好大模型落地,面临模型效果、推理成本、落地难度的三大关键挑战:既要有好的基础大模型做支撑,解决复杂难题,也要有低成本的推理服务让大模型被广泛应用,还要更多工具、平台和应用帮助企业做好场景落地。——谭待火山引擎总裁01.豆包大模型首次亮相大使用量打磨好模型模型效果是AI落地最关键的挑战。谭待指出,只有大的使用量,才能打磨出好模型。目前,豆包大模型日均处理1,200亿tokens文本、生成3,000万张图片。为助力企业做好大模型场景落地,字节跳动自主研发的豆包大模型将通过火山

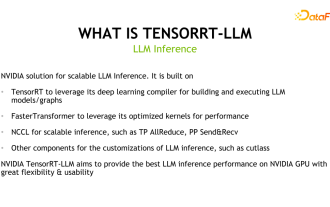

揭秘NVIDIA大模型推理框架:TensorRT-LLM

Feb 01, 2024 pm 05:24 PM

揭秘NVIDIA大模型推理框架:TensorRT-LLM

Feb 01, 2024 pm 05:24 PM

一、TensorRT-LLM的产品定位TensorRT-LLM是NVIDIA为大型语言模型(LLM)开发的可扩展推理方案。它基于TensorRT深度学习编译框架构建、编译和执行计算图,并借鉴了FastTransformer中高效的Kernels实现。此外,它还利用NCCL实现设备间的通信。开发者可以根据技术发展和需求差异,定制算子以满足特定需求,例如基于cutlass开发定制的GEMM。TensorRT-LLM是NVIDIA官方推理方案,致力于提供高性能并不断完善其实用性。TensorRT-LL

工业知识图谱进阶实战

Jun 13, 2024 am 11:59 AM

工业知识图谱进阶实战

Jun 13, 2024 am 11:59 AM

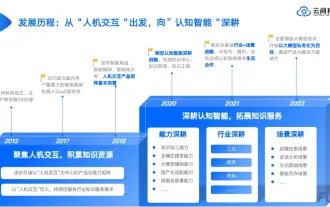

一、背景简介首先来介绍一下云问科技的发展历程。云问科技公...2023年,正是大模型盛行的时期,很多企业认为已经大模型之后图谱的重要性大大降低了,之前研究的预置的信息化系统也都不重要了。不过随着RAG的推广、数据治理的盛行,我们发现更高效的数据治理和高质量的数据是提升私有化大模型效果的重要前提,因此越来越多的企业开始重视知识建设的相关内容。这也推动了知识的构建和加工开始向更高水平发展,其中有很多技巧和方法可以挖掘。可见一个新技术的出现,并不是将所有的旧技术打败,也有可能将新技术和旧技术相互融合后

对标GPT-4!中国移动九天大模型通过双备案

Apr 04, 2024 am 09:31 AM

对标GPT-4!中国移动九天大模型通过双备案

Apr 04, 2024 am 09:31 AM

4月4日消息,日前,国家网信办公布已备案大模型清单,中国移动“九天自然语言交互大模型”名列其中,标志着中国移动九天AI大模型可正式对外提供生成式人工智能服务。中国移动表示,这是同时通过国家“生成式人工智能服务备案”和“境内深度合成服务算法备案”双备案的首个央企研发的大模型。据介绍,九天自然语言交互大模型具有行业能力增强、安全可信、支持全栈国产化等特点,已形成90亿、139亿、570亿、千亿等多种参数量版本,可灵活部署于云、边、端不同场

利用升腾AI技术,秦岭·秦川交通大模型助力西安打造智慧交通创新中心

Oct 15, 2023 am 08:17 AM

利用升腾AI技术,秦岭·秦川交通大模型助力西安打造智慧交通创新中心

Oct 15, 2023 am 08:17 AM

“高度复杂、碎片化程度高、跨领域”一直是交通行业数智化升级路上的首要痛点。近日,由中科视语、西安市雁塔区政府、西安未来人工智能计算中心联合打造的参数规模千亿级的“秦岭·秦川交通大模型”,面向智慧交通领域,为西安及其周边地区打造智慧交通创新支点。 “秦岭·秦川交通大模型”结合西安当地海量开放场景下的交通生态数据、中科视语自研的原创先进算法以及西安未来人工智能计算中心升腾AI的强大算力,为路网监测、应急指挥、养护管理、公众出行等智慧交通全场景带来数智化变革。交通管理在不同城市有不同的特点,不同道路的交

新测试基准发布,最强开源Llama 3尴尬了

Apr 23, 2024 pm 12:13 PM

新测试基准发布,最强开源Llama 3尴尬了

Apr 23, 2024 pm 12:13 PM

如果试题太简单,学霸和学渣都能考90分,拉不开差距……随着Claude3、Llama3甚至之后GPT-5等更强模型发布,业界急需一款更难、更有区分度的基准测试。大模型竞技场背后组织LMSYS推出下一代基准测试Arena-Hard,引起广泛关注。Llama3的两个指令微调版本实力到底如何,也有了最新参考。与之前大家分数都相近的MTBench相比,Arena-Hard区分度从22.6%提升到87.4%,孰强孰弱一目了然。Arena-Hard利用竞技场实时人类数据构建,与人类偏好一致率也高达89.1%

GPT Store都开不下去,这家国产平台怎么敢走这条路的??

Apr 19, 2024 pm 09:30 PM

GPT Store都开不下去,这家国产平台怎么敢走这条路的??

Apr 19, 2024 pm 09:30 PM

注意看,这个男人把超1000种大模型接入,让你可插拔无缝切换使用。最近还上线了可视化的AI工作流:给你一个直观的拖放界面,拖拖、拉拉、拽拽,就能在无限画布上编排自己个儿的Workflow。正所谓兵贵神速,量子位听说,这个AIWorkflow上线不到48小时,就已经有用户配出了100多个节点的个人工作流。不卖关子,今天要聊的就是LLMOps公司Dify,及其CEO张路宇。张路宇也是Dify的创始人。投身创业前,有11年的互联网从业经验。搞产品设计,懂项目管理,也对SaaS有点自己的独到见解。后来他