多模态版Llama2上线,Meta发布AnyMAL

在多个基准测试中均刷新了业界最好的 zero-shot 性能。

一个统一的模型,可以对不同模态输入内容(文本、图像、视频、音频、IMU 运动传感器数据)实现理解,并生成文本响应,技术基于 Llama 2,来自 Meta。

昨天,多模态大模型 AnyMAL 的研究吸引了 AI 研究社区的关注。

大型语言模型(LLM)以其巨大的规模和复杂性而闻名,它极大地增强了机器理解和表达人类语言的能力。 LLM 的进步使视觉语言领域有了显着进步,弥合了图像编码器和 LLM 之间的差距,将它们的推理能力结合起来。先前的多模态 LLM 研究集中在结合文本和另一种模态的模型上,如文本和图像模型,或者集中在非开源的专有语言模型上。

如果有一种更好的方法能够实现多模态功能,将各种模态能够嵌入在LLM中使用,这会给我们带来不同的体验吗?

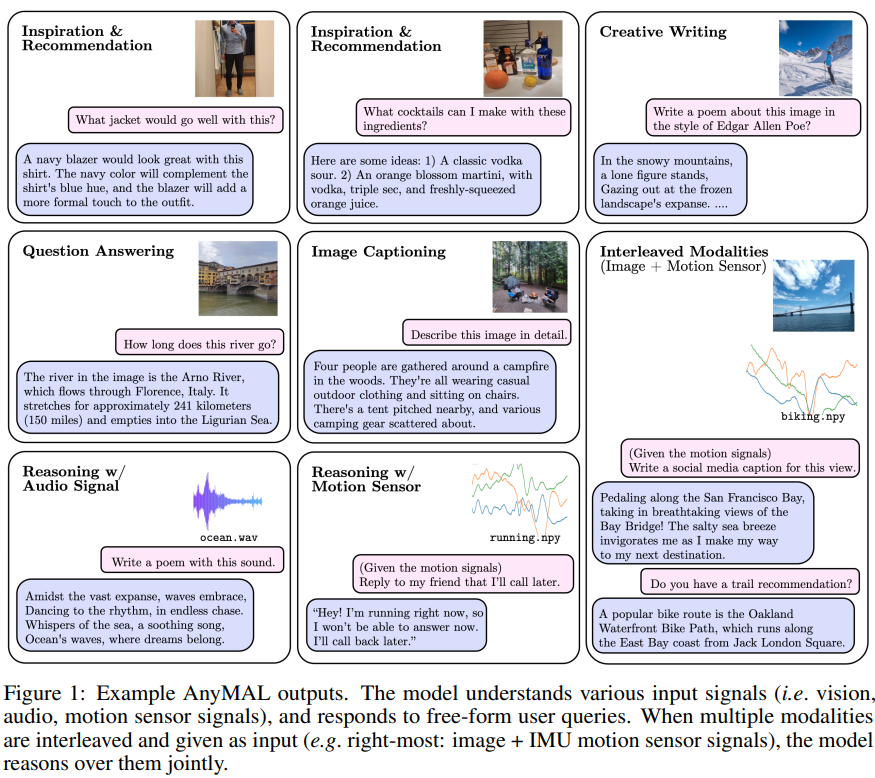

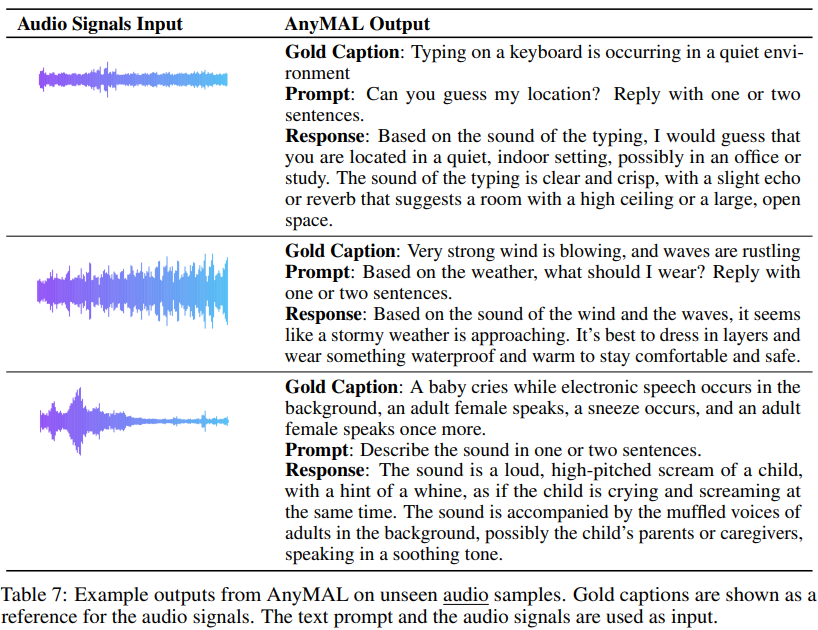

输出示例

为了解决这个问题,来自Meta的研究人员最近推出了AnyMAL(Any-Modality Augmented Language Model)。这是一个经过训练的多模态编码器集合,可以将来自各种模态(包括图像、视频、音频和IMU运动传感器数据)的数据转换为LLM的文本嵌入空间

论文地址: https://huggingface.co/papers/2309.16058

根据说明,该研究的主要贡献如下所示:

为构建多模态LLM 提出了一种高效、可扩展的解决方案。本文提供了在大型数据集上预先训练的投影层,这些数据集包含多种模态(例如,2 亿张图像、220 万段音频、50 万IMU 时间序列、2800 万段视频),所有数据集都与同一个大模型(LLaMA-2- 70B-chat)对齐,从而实现了交错式多模态上下文提示。

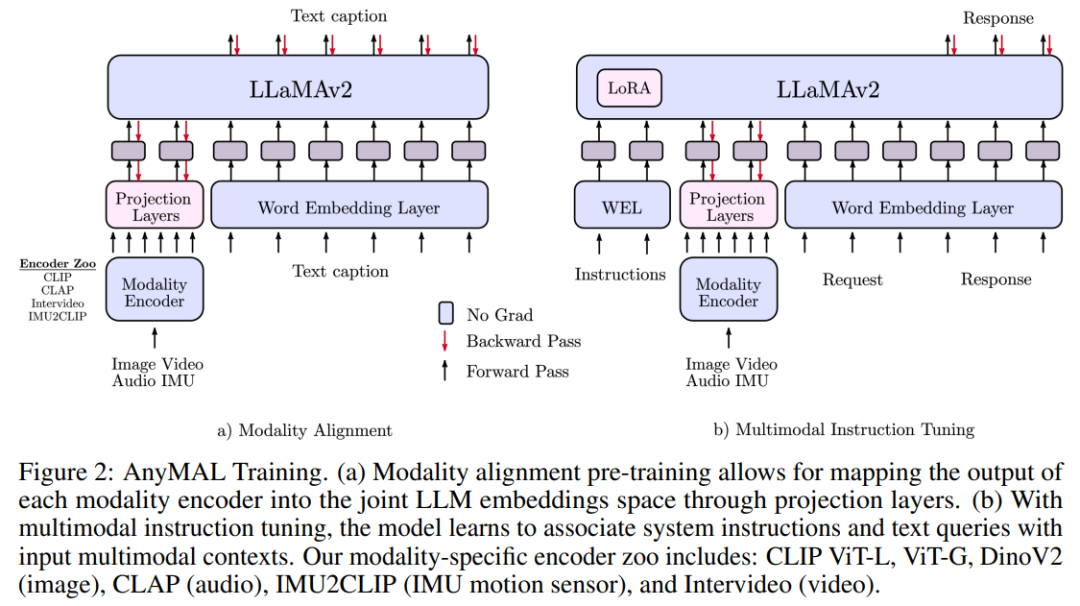

本研究使用跨三种模式(图像、视频和音频)的多模态指令集对模型进行了进一步微调,涵盖了简单问答(QA)领域以外的各种不受限制的任务。该数据集包含高质量的人工收集指令数据,因此本研究将其作为复杂多模态推理任务的基准

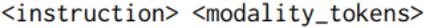

本文最佳模型在各种任务和模式的自动和人工评估中取得了很好的零误差性能,相较于现有文献中的模型,在VQAv2 上的相对准确率提高了7.0%,在零误差COCO 图像字幕上提高了8.4% 的CIDEr,在AudioCaps 上提高了14.5% 的CIDEr ,创造了新的SOTA

方法

方法概览

方法概览

预训练模态对齐的内容需要进行改写

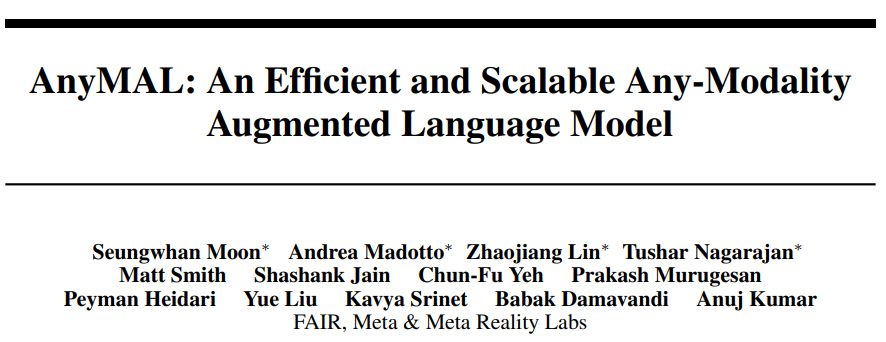

通过使用配对的多模态数据(包括特定的模态信号和文本叙述),本研究对LLM进行了预训练,以实现多模态理解能力,如图2所示。具体而言,我们为每个模态训练了一个轻量级适配器,将输入信号投射到特定LLM的文本标记嵌入空间中。这样,LLM的文本标记嵌入空间就变成了一个联合的标记嵌入空间,其中标记可以代表文本或其他模态

关于图像对齐的研究,我们使用了LAION-2B数据集的一个干净子集,并采用了CAT方法进行过滤,对任何可检测到的人脸进行了模糊处理。而对于音频对齐的研究,则使用了AudioSet(2.1M)、AudioCaps(46K)和CLOTHO(5K)数据集。此外,我们还使用了Ego4D数据集进行IMU和文本的对齐(528K)

对于大型数据集,要将预训练扩展到70B参数模型需要大量资源,通常需要使用FSDP封装器在多个GPU上对模型进行分片。为了有效地扩展训练规模,本文在多模态设置中实施了量化策略(4位和8位),其中冻结了模型的LLM部分,只有模态tokenizer是可训练的。这种方法将内存需求缩小了一个数量级。因此,70B AnyMAL能够在单个80GB VRAM GPU上就完成训练,batch size为4。与FSDP相比,本文提出的量化方法只使用了GPU资源的一半,却实现了相同的吞吐量

利用多模态指令数据集进行微调的意思是使用多种模态的指令数据集来进行微调

为了进一步提高模型对不同输入模态的指令跟随能力,研究利用多模态指令调整(MM-IT)数据集进行了额外的微调。具体来说,我们将输入连接为 [ ],这样响应目标就同时以文本指令和模态输入为基础。研究对以下两种情况进行消减:(1)在不改变 LLM 参数的情况下训练投影层;或(2)使用低级适应(Low-Rank Adaptation)进一步调整 LM 行为。研究同时使用人工收集的指令调整数据集和合成数据。

],这样响应目标就同时以文本指令和模态输入为基础。研究对以下两种情况进行消减:(1)在不改变 LLM 参数的情况下训练投影层;或(2)使用低级适应(Low-Rank Adaptation)进一步调整 LM 行为。研究同时使用人工收集的指令调整数据集和合成数据。

实验及结果

图像标题生成是一种人工智能技术,用于自动为图像生成相应的标题。这项技术结合了计算机视觉和自然语言处理的方法,通过分析图像的内容和特征,以及对语义和语法的理解,生成与图像相关的描述性标题。图像标题生成在许多领域有广泛的应用,包括图像搜索、图像标注、图像检索等。通过自动化生成标题,可以提高图像的可理解性和搜索引擎的准确性,为用户提供更好的图像检索和浏览体验

表 2 显示了在 COCO 和标有「详细描述」 任务(MM-IT-Cap)的 MM-IT 数据集子集上的零样本图像字幕生成性能。可以看出, AnyMAL 变体在这两个数据集上的表现都明显优于基线。值得注意的是,AnyMAL-13B 和 AnyMAL-70B 变体的性能没有明显差距。这一结果表明,底层 LLM 能力对图像标题生成是一种人工智能技术,用于自动为图像生成相应的标题。这项技术结合了计算机视觉和自然语言处理的方法,通过分析图像的内容和特征,以及对语义和语法的理解,生成与图像相关的描述性标题。图像标题生成在许多领域有广泛的应用,包括图像搜索、图像标注、图像检索等。通过自动化生成标题,可以提高图像的可理解性和搜索引擎的准确性,为用户提供更好的图像检索和浏览体验任务的影响较小,但在很大程度上取决于数据规模和配准方法。

需要进行的重写是:对多模态推理任务进行人工评估

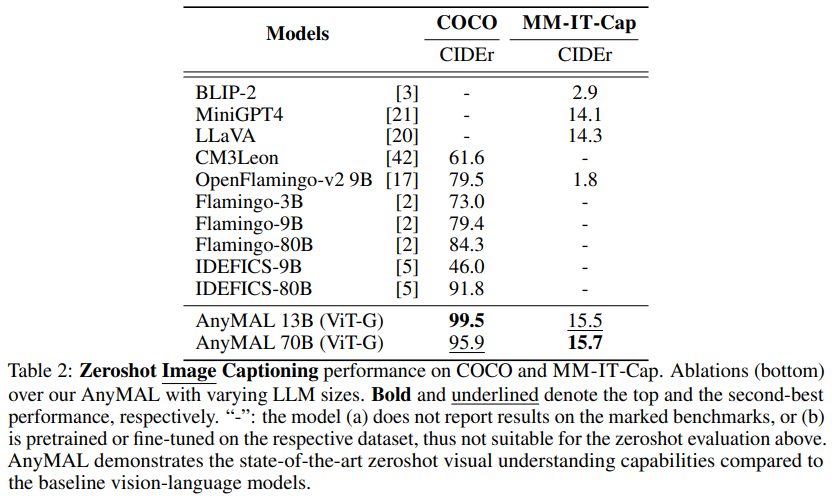

图 3 显示,与基线(LLaVA:34.4% 的胜率和 MiniGPT4:27.0% 的胜率)相比,AnyMAL 性能强劲,与人工标注的实际样本的差距较小(41.1% 的胜率)。值得注意的是,使用完整指令集微调的模型表现出最高的优先胜率,显示出与人类标注的响应相当的视觉理解和推理能力。还值得注意的是,BLIP-2 和 InstructBLIP 在这些开放式查询中表现不佳(分别为 4.1% 和 16.7% 的优先胜出率),尽管它们在公开的 VQA 基准测试中表现出色(见表 4)。

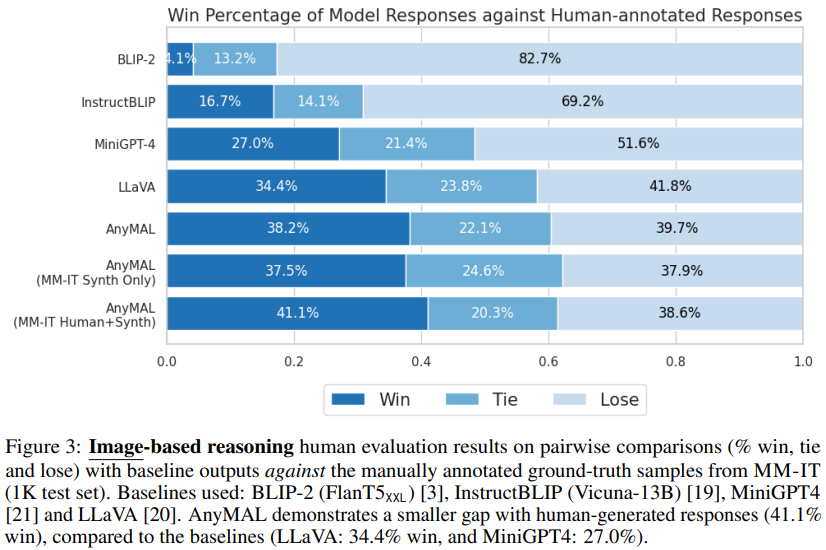

VQA 基准

在表4中,我们展示了在Hateful Meme数据集、VQAv2、TextVQA、ScienceQA、VizWiz和OKVQA上的零样本性能,并与文献中报告的各自基准上的零样本结果进行了比较。我们的研究重点放在零样本评估上,以便在推理时最准确地估计模型在开放式查询上的性能

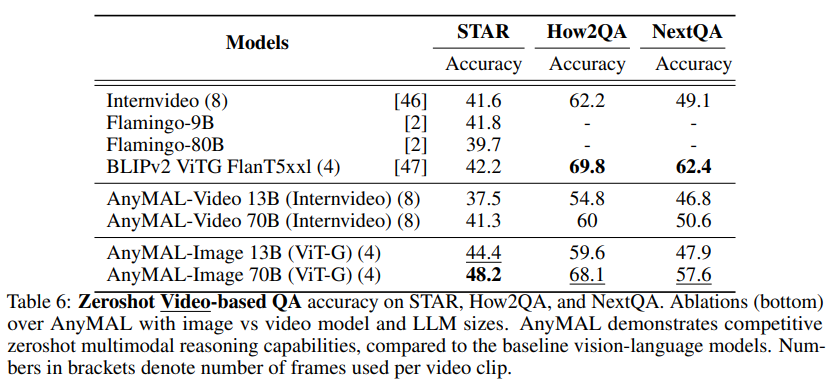

视频 QA 基准

如表 6 所示,研究在三个具有挑战性的视频 QA 基准上对模型进行了评估。

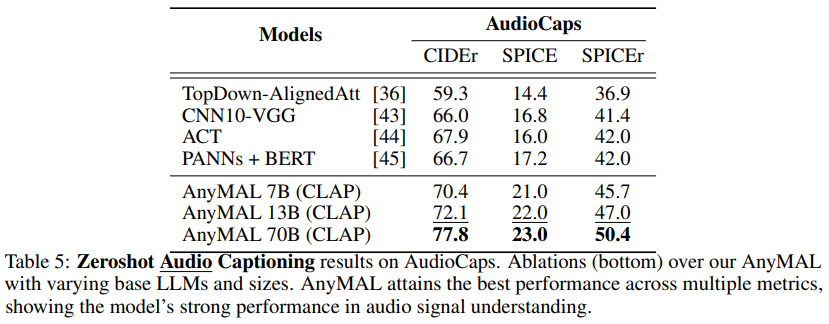

重新生成音频字幕

表 5 显示了 AudioCaps 基准数据集上的重新生成音频字幕结果。AnyMAL 的表现明显优于文献中其他最先进的音频字幕模型(例如,CIDEr +10.9pp,SPICE +5.8pp),这表明所提出的方法不仅适用于视觉,还适用于各种模态。与 7B 和 13B 变体相比,文本 70B 模型表现出了明显的优势。

有趣的是,根据从AnyMAL论文提交的方式、类型和时间推测,Meta似乎计划通过其新推出的混合现实/元宇宙头显来收集多模态数据。这些研究成果可能会被整合到Meta的元宇宙产品线中,或者很快应用于消费级应用中

更多详细内容请阅读原文。

以上是多模态版Llama2上线,Meta发布AnyMAL的详细内容。更多信息请关注PHP中文网其他相关文章!

热AI工具

Undresser.AI Undress

人工智能驱动的应用程序,用于创建逼真的裸体照片

AI Clothes Remover

用于从照片中去除衣服的在线人工智能工具。

Undress AI Tool

免费脱衣服图片

Clothoff.io

AI脱衣机

Video Face Swap

使用我们完全免费的人工智能换脸工具轻松在任何视频中换脸!

热门文章

热工具

记事本++7.3.1

好用且免费的代码编辑器

SublimeText3汉化版

中文版,非常好用

禅工作室 13.0.1

功能强大的PHP集成开发环境

Dreamweaver CS6

视觉化网页开发工具

SublimeText3 Mac版

神级代码编辑软件(SublimeText3)

ControlNet作者又出爆款!一张图生成绘画全过程,两天狂揽1.4k Star

Jul 17, 2024 am 01:56 AM

ControlNet作者又出爆款!一张图生成绘画全过程,两天狂揽1.4k Star

Jul 17, 2024 am 01:56 AM

同样是图生视频,PaintsUndo走出了不一样的路线。ControlNet作者LvminZhang又开始整活了!这次瞄准绘画领域。新项目PaintsUndo刚上线不久,就收获1.4kstar(还在疯狂涨)。项目地址:https://github.com/lllyasviel/Paints-UNDO通过该项目,用户输入一张静态图像,PaintsUndo就能自动帮你生成整个绘画的全过程视频,从线稿到成品都有迹可循。绘制过程,线条变化多端甚是神奇,最终视频结果和原图像非常相似:我们再来看一个完整的绘

登顶开源AI软件工程师榜首,UIUC无Agent方案轻松解决SWE-bench真实编程问题

Jul 17, 2024 pm 10:02 PM

登顶开源AI软件工程师榜首,UIUC无Agent方案轻松解决SWE-bench真实编程问题

Jul 17, 2024 pm 10:02 PM

AIxiv专栏是本站发布学术、技术内容的栏目。过去数年,本站AIxiv专栏接收报道了2000多篇内容,覆盖全球各大高校与企业的顶级实验室,有效促进了学术交流与传播。如果您有优秀的工作想要分享,欢迎投稿或者联系报道。投稿邮箱:liyazhou@jiqizhixin.com;zhaoyunfeng@jiqizhixin.com这篇论文的作者均来自伊利诺伊大学香槟分校(UIUC)张令明老师团队,包括:StevenXia,四年级博士生,研究方向是基于AI大模型的自动代码修复;邓茵琳,四年级博士生,研究方

OpenAI超级对齐团队遗作:两个大模型博弈一番,输出更好懂了

Jul 19, 2024 am 01:29 AM

OpenAI超级对齐团队遗作:两个大模型博弈一番,输出更好懂了

Jul 19, 2024 am 01:29 AM

如果AI模型给的答案一点也看不懂,你敢用吗?随着机器学习系统在更重要的领域得到应用,证明为什么我们可以信任它们的输出,并明确何时不应信任它们,变得越来越重要。获得对复杂系统输出结果信任的一个可行方法是,要求系统对其输出产生一种解释,这种解释对人类或另一个受信任的系统来说是可读的,即可以完全理解以至于任何可能的错误都可以被发现。例如,为了建立对司法系统的信任,我们要求法院提供清晰易读的书面意见,解释并支持其决策。对于大型语言模型来说,我们也可以采用类似的方法。不过,在采用这种方法时,确保语言模型生

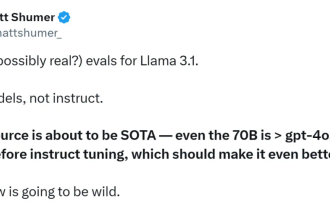

首个超越GPT4o级开源模型!Llama 3.1泄密:4050亿参数,下载链接、模型卡都有了

Jul 23, 2024 pm 08:51 PM

首个超越GPT4o级开源模型!Llama 3.1泄密:4050亿参数,下载链接、模型卡都有了

Jul 23, 2024 pm 08:51 PM

快准备好你的GPU!Llama3.1终于现身了,不过出处却不是Meta官方。今日,Reddit上新版Llama大模型泄露的消息遭到了疯传,除了基础模型,还包括8B、70B和最大参数的405B的基准测试结果。下图为Llama3.1各版本与OpenAIGPT-4o、Llama38B/70B的比较结果。可以看到,即使是70B的版本,也在多项基准上超过了GPT-4o。图源:https://x.com/mattshumer_/status/1815444612414087294显然,3.1版本的8B和70

新款经济实惠的 Meta Quest 3S VR 耳机出现在 FCC 上,暗示即将推出

Sep 04, 2024 am 06:51 AM

新款经济实惠的 Meta Quest 3S VR 耳机出现在 FCC 上,暗示即将推出

Sep 04, 2024 am 06:51 AM

Meta Connect 2024 活动定于 9 月 25 日至 26 日举行,在本次活动中,该公司预计将推出一款价格实惠的新型虚拟现实耳机。据传这款 VR 耳机是 Meta Quest 3S,它似乎已经出现在 FCC 清单上。这个建议

黎曼猜想显着突破!陶哲轩强推MIT、牛津新论文,37岁菲尔兹奖得主参与

Aug 05, 2024 pm 03:32 PM

黎曼猜想显着突破!陶哲轩强推MIT、牛津新论文,37岁菲尔兹奖得主参与

Aug 05, 2024 pm 03:32 PM

最近,被称为千禧年七大难题之一的黎曼猜想迎来了新突破。黎曼猜想是数学中一个非常重要的未解决问题,与素数分布的精确性质有关(素数是那些只能被1和自身整除的数字,它们在数论中扮演着基础性的角色)。在当今的数学文献中,已有超过一千条数学命题以黎曼猜想(或其推广形式)的成立为前提。也就是说,黎曼猜想及其推广形式一旦被证明,这一千多个命题将被确立为定理,对数学领域产生深远的影响;而如果黎曼猜想被证明是错误的,那么这些命题中的一部分也将随之失去其有效性。新的突破来自MIT数学教授LarryGuth和牛津大学

arXiv论文可以发「弹幕」了,斯坦福alphaXiv讨论平台上线,LeCun点赞

Aug 01, 2024 pm 05:18 PM

arXiv论文可以发「弹幕」了,斯坦福alphaXiv讨论平台上线,LeCun点赞

Aug 01, 2024 pm 05:18 PM

干杯!当论文讨论细致到词句,是什么体验?最近,斯坦福大学的学生针对arXiv论文创建了一个开放讨论论坛——alphaXiv,可以直接在任何arXiv论文之上发布问题和评论。网站链接:https://alphaxiv.org/其实不需要专门访问这个网站,只需将任何URL中的arXiv更改为alphaXiv就可以直接在alphaXiv论坛上打开相应论文:可以精准定位到论文中的段落、句子:右侧讨论区,用户可以发表问题询问作者论文思路、细节,例如:也可以针对论文内容发表评论,例如:「给出至

公理训练让LLM学会因果推理:6700万参数模型比肩万亿参数级GPT-4

Jul 17, 2024 am 10:14 AM

公理训练让LLM学会因果推理:6700万参数模型比肩万亿参数级GPT-4

Jul 17, 2024 am 10:14 AM

把因果链展示给LLM,它就能学会公理。AI已经在帮助数学家和科学家做研究了,比如著名数学家陶哲轩就曾多次分享自己借助GPT等AI工具研究探索的经历。AI要在这些领域大战拳脚,强大可靠的因果推理能力是必不可少的。本文要介绍的这项研究发现:在小图谱的因果传递性公理演示上训练的Transformer模型可以泛化用于大图谱的传递性公理。也就是说,如果让Transformer学会执行简单的因果推理,就可能将其用于更为复杂的因果推理。该团队提出的公理训练框架是一种基于被动数据来学习因果推理的新范式,只有演示