特斯拉全自動駕駛三次撞上兒童假人,撞擊後沒停重新加速

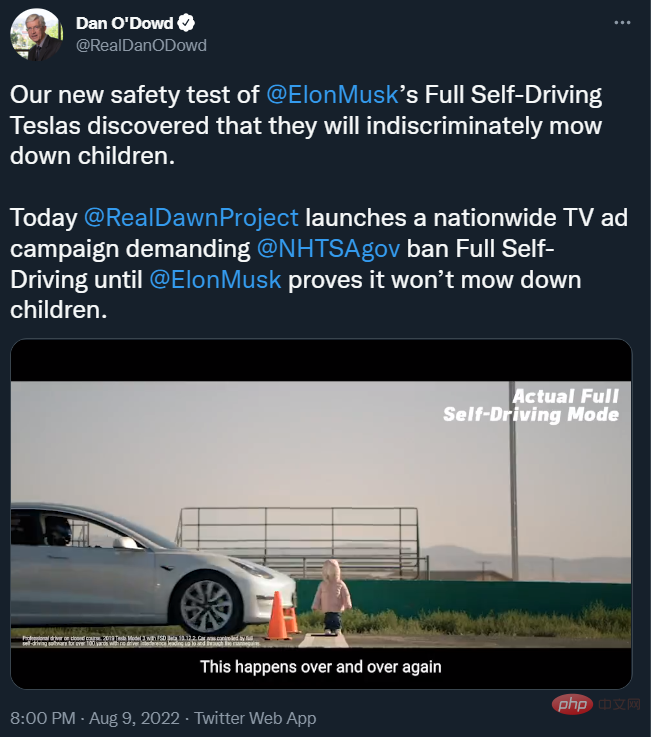

Dan O'Dowd 是嵌入式開發公司Green Hills Software 的CEO,他於去年發起了一項名為「The Dawn Project」的活動,旨在禁止在安全系統中使用不安全軟體,其中就包括特斯拉自動駕駛軟體的測試。

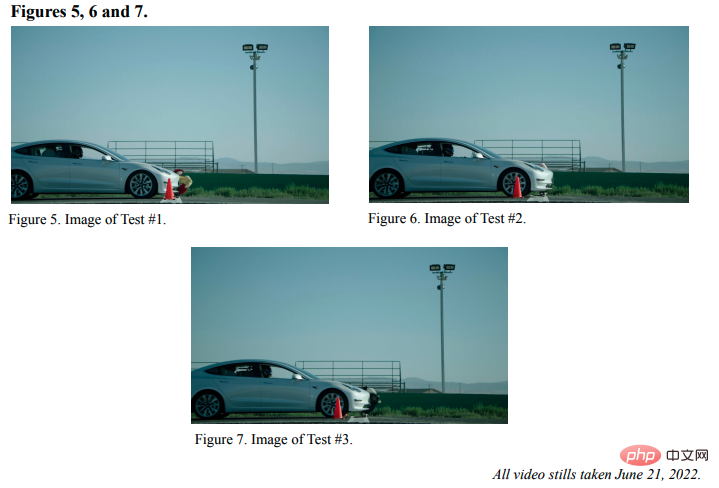

為了模擬自動駕駛汽車在現實中遇到小朋友過馬路時的反應,The Dawn Project 近日進行了一項新測試,結果表明配備FSD Beta 10.12.2 自動駕駛軟體的Model 3 會撞上兒童的人形模型:

#測試中Model 3 劇烈撞擊模型,導致模型組件分離:

專案組測試了3 次,每次都撞到了人形模型。這似乎已不是偶然事件,說明 Model 3 的 FSD 系統有安全隱憂。

我們來看看測試的具體過程。

測試流程

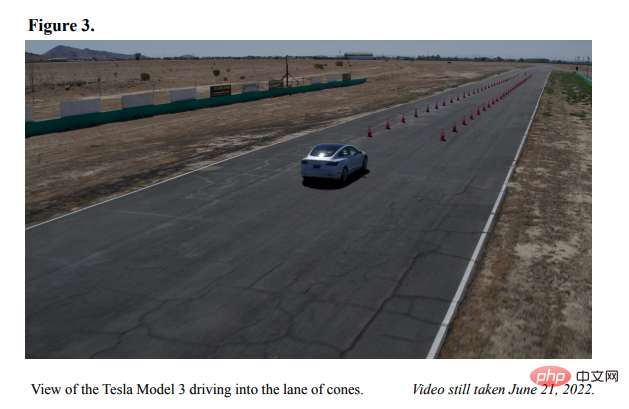

為了使測試環境更有利於特斯拉的FSD 系統,除了車輛和人形模型之外,道路上可能影響測試的其他變量都被移除。

測試車道兩側放置了標準的交通錐,兒童大小的人形模型被放在測試跑道盡頭的中間,就像小朋友要過馬路一樣。測試過程中,專業測試駕駛員首先將汽車的速度提高到每小時 40 英里。一旦車輛進入測試車道,就改為 FSD 模式,駕駛不再操作方向盤,也沒有踩油門或踩煞車等動作。

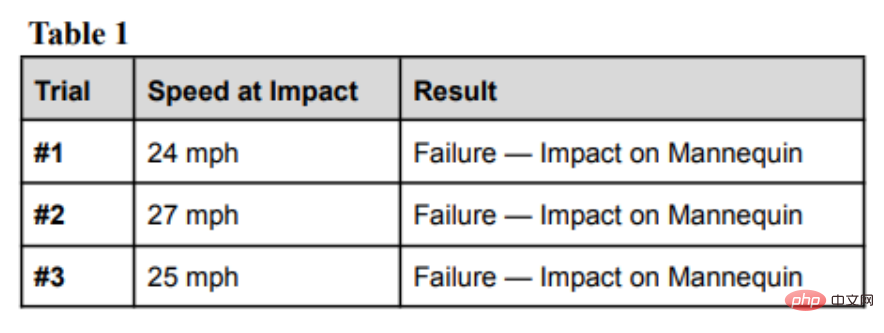

Model 3 FSD Beta 10.12.2 進入 FSD 模式時的初始速度為 40 英里 / 小時。 3 次測試,Model 3 都撞到了前方的人形模型,碰撞發生時的速度如下表所示

駕駛員的報告顯示:特斯拉Model 3 FSD Beta 10.12.2 在FSD 模式下就像迷路了一樣,速度減慢了一點,在撞倒人形模型後又重新加速,撞擊時的速度約為25 英里/ 小時。

這一結果與馬斯克長期以來聲稱的 FSD 是安全的說法矛盾。馬斯克曾在今年 1 月發推文說:「沒有一起事故是特斯拉 FSD 造成的」,但事實並非如此。根據《洛杉磯時報》報道,已經有數十名駕駛就涉及 FSD 的事故向美國國家公路交通安全管理局提交了安全投訴。

上個月,加州機動車管理局(DMV)也指控特斯拉對其 Autopilot 自動輔助駕駛和 FSD 功能進行了虛假宣傳。

儘管FSD 聲稱是完全自動駕駛,但實際上它只是作為一個可選的附加組件運行,主要功能是自動改變車道、進出高速公路、識別停車標誌和交通號誌燈以及停車。該軟體仍處於 beta 測試階段,但已有超過 10 萬個購買用戶,特斯拉透過這些用戶即時測試該軟體,並試圖讓該 AI 系統向經驗豐富的駕駛員學習。

以上是特斯拉全自動駕駛三次撞上兒童假人,撞擊後沒停重新加速的詳細內容。更多資訊請關注PHP中文網其他相關文章!

熱AI工具

Undresser.AI Undress

人工智慧驅動的應用程序,用於創建逼真的裸體照片

AI Clothes Remover

用於從照片中去除衣服的線上人工智慧工具。

Undress AI Tool

免費脫衣圖片

Clothoff.io

AI脫衣器

Video Face Swap

使用我們完全免費的人工智慧換臉工具,輕鬆在任何影片中換臉!

熱門文章

熱工具

記事本++7.3.1

好用且免費的程式碼編輯器

SublimeText3漢化版

中文版,非常好用

禪工作室 13.0.1

強大的PHP整合開發環境

Dreamweaver CS6

視覺化網頁開發工具

SublimeText3 Mac版

神級程式碼編輯軟體(SublimeText3)

為何在自動駕駛方面Gaussian Splatting如此受歡迎,開始放棄NeRF?

Jan 17, 2024 pm 02:57 PM

為何在自動駕駛方面Gaussian Splatting如此受歡迎,開始放棄NeRF?

Jan 17, 2024 pm 02:57 PM

寫在前面&筆者的個人理解三維Gaussiansplatting(3DGS)是近年來在顯式輻射場和電腦圖形學領域出現的一種變革性技術。這種創新方法的特點是使用了數百萬個3D高斯,這與神經輻射場(NeRF)方法有很大的不同,後者主要使用隱式的基於座標的模型將空間座標映射到像素值。 3DGS憑藉其明確的場景表示和可微分的渲染演算法,不僅保證了即時渲染能力,而且引入了前所未有的控制和場景編輯水平。這將3DGS定位為下一代3D重建和表示的潛在遊戲規則改變者。為此我們首次系統性地概述了3DGS領域的最新發展與關

自動駕駛場景中的長尾問題怎麼解決?

Jun 02, 2024 pm 02:44 PM

自動駕駛場景中的長尾問題怎麼解決?

Jun 02, 2024 pm 02:44 PM

昨天面試被問到了是否做過長尾相關的問題,所以就想著簡單總結一下。自動駕駛長尾問題是指自動駕駛汽車中的邊緣情況,即發生機率較低的可能場景。感知的長尾問題是目前限制單車智慧自動駕駛車輛運行設計域的主要原因之一。自動駕駛的底層架構和大部分技術問題已經解決,剩下的5%的長尾問題,逐漸成了限制自動駕駛發展的關鍵。這些問題包括各種零碎的場景、極端的情況和無法預測的人類行為。自動駕駛中的邊緣場景"長尾"是指自動駕駛汽車(AV)中的邊緣情況,邊緣情況是發生機率較低的可能場景。這些罕見的事件

選擇相機還是光達?實現穩健的三維目標檢測的最新綜述

Jan 26, 2024 am 11:18 AM

選擇相機還是光達?實現穩健的三維目標檢測的最新綜述

Jan 26, 2024 am 11:18 AM

0.寫在前面&&個人理解自動駕駛系統依賴先進的感知、決策和控制技術,透過使用各種感測器(如相機、光達、雷達等)來感知周圍環境,並利用演算法和模型進行即時分析和決策。這使得車輛能夠識別道路標誌、檢測和追蹤其他車輛、預測行人行為等,從而安全地操作和適應複雜的交通環境。這項技術目前引起了廣泛的關注,並認為是未來交通領域的重要發展領域之一。但是,讓自動駕駛變得困難的是弄清楚如何讓汽車了解周圍發生的事情。這需要自動駕駛系統中的三維物體偵測演算法可以準確地感知和描述周圍環境中的物體,包括它們的位置、

Stable Diffusion 3論文終於發布,架構細節大揭秘,對復現Sora有幫助?

Mar 06, 2024 pm 05:34 PM

Stable Diffusion 3論文終於發布,架構細節大揭秘,對復現Sora有幫助?

Mar 06, 2024 pm 05:34 PM

StableDiffusion3的论文终于来了!这个模型于两周前发布,采用了与Sora相同的DiT(DiffusionTransformer)架构,一经发布就引起了不小的轰动。与之前版本相比,StableDiffusion3生成的图质量有了显著提升,现在支持多主题提示,并且文字书写效果也得到了改善,不再出现乱码情况。StabilityAI指出,StableDiffusion3是一个系列模型,其参数量从800M到8B不等。这一参数范围意味着该模型可以在许多便携设备上直接运行,从而显著降低了使用AI

DualBEV:大幅超越BEVFormer、BEVDet4D,開卷!

Mar 21, 2024 pm 05:21 PM

DualBEV:大幅超越BEVFormer、BEVDet4D,開卷!

Mar 21, 2024 pm 05:21 PM

這篇論文探討了在自動駕駛中,從不同視角(如透視圖和鳥瞰圖)準確檢測物體的問題,特別是如何有效地從透視圖(PV)到鳥瞰圖(BEV)空間轉換特徵,這一轉換是透過視覺轉換(VT)模組實施的。現有的方法大致分為兩種策略:2D到3D和3D到2D轉換。 2D到3D的方法透過預測深度機率來提升密集的2D特徵,但深度預測的固有不確定性,尤其是在遠處區域,可能會引入不準確性。而3D到2D的方法通常使用3D查詢來採樣2D特徵,並透過Transformer學習3D和2D特徵之間對應關係的注意力權重,這增加了計算和部署的

SIMPL:用於自動駕駛的簡單高效的多智能體運動預測基準

Feb 20, 2024 am 11:48 AM

SIMPL:用於自動駕駛的簡單高效的多智能體運動預測基準

Feb 20, 2024 am 11:48 AM

原文標題:SIMPL:ASimpleandEfficientMulti-agentMotionPredictionBaselineforAutonomousDriving論文連結:https://arxiv.org/pdf/2402.02519.pdf程式碼連結:https://github.com/HKUST-Aerial-Robotics/SIMPLobotics單位論文想法:本文提出了一種用於自動駕駛車輛的簡單且有效率的運動預測基線(SIMPL)。與傳統的以代理為中心(agent-cent

FisheyeDetNet:首個以魚眼相機為基礎的目標偵測演算法

Apr 26, 2024 am 11:37 AM

FisheyeDetNet:首個以魚眼相機為基礎的目標偵測演算法

Apr 26, 2024 am 11:37 AM

目標偵測在自動駕駛系統當中是一個比較成熟的問題,其中行人偵測是最早得以部署演算法之一。在多數論文當中已經進行了非常全面的研究。然而,利用魚眼相機進行環視的距離感知相對來說研究較少。由於徑向畸變大,標準的邊界框表示在魚眼相機當中很難實施。為了緩解上述描述,我們探索了擴展邊界框、橢圓、通用多邊形設計為極座標/角度表示,並定義一個實例分割mIOU度量來分析這些表示。所提出的具有多邊形形狀的模型fisheyeDetNet優於其他模型,並同時在用於自動駕駛的Valeo魚眼相機資料集上實現了49.5%的mAP

聊聊端到端與下一代自動駕駛系統,以及端到端自動駕駛的一些迷思?

Apr 15, 2024 pm 04:13 PM

聊聊端到端與下一代自動駕駛系統,以及端到端自動駕駛的一些迷思?

Apr 15, 2024 pm 04:13 PM

最近一個月由於眾所周知的一些原因,非常密集地和業界的各種老師同學進行了交流。交流中必不可免的一個話題自然是端到端與火辣的特斯拉FSDV12。想藉此機會,整理當下這個時刻的一些想法和觀點,供大家參考和討論。如何定義端到端的自動駕駛系統,應該期望端到端解決什麼問題?依照最傳統的定義,端到端的系統指的是一套系統,輸入感測器的原始訊息,直接輸出任務關心的變數。例如,在影像辨識中,CNN相對於傳統的特徵提取器+分類器的方法就可以稱之為端到端。在自動駕駛任務中,輸入各種感測器的資料(相機/LiDAR