Peranti teknologi

Peranti teknologi

AI

AI

ChatGPT yang boleh memahami pertuturan ada di sini: 10 jam rakaman dilemparkan, tanya apa sahaja yang anda mahu

ChatGPT yang boleh memahami pertuturan ada di sini: 10 jam rakaman dilemparkan, tanya apa sahaja yang anda mahu

ChatGPT yang boleh memahami pertuturan ada di sini: 10 jam rakaman dilemparkan, tanya apa sahaja yang anda mahu

Model bahasa berskala besar (LLM) mengubah jangkaan pengguna dalam setiap industri. Walau bagaimanapun, membina produk AI generatif yang berpusat pada pertuturan manusia masih sukar kerana fail audio menimbulkan cabaran kepada model bahasa yang besar.

Cabaran utama dalam menggunakan LLM pada fail audio ialah LLM dihadkan oleh tetingkap konteksnya. Sebelum fail audio boleh dimasukkan ke dalam LLM, ia perlu ditukar kepada teks. Semakin panjang fail audio, semakin besar cabaran kejuruteraan untuk memintas had tetingkap konteks LLM. Tetapi dalam senario kerja, kami sering memerlukan LLM untuk membantu kami memproses fail suara yang sangat panjang, seperti mengekstrak kandungan teras daripada rakaman mesyuarat selama beberapa jam atau mencari jawapan kepada soalan tertentu daripada temu bual...

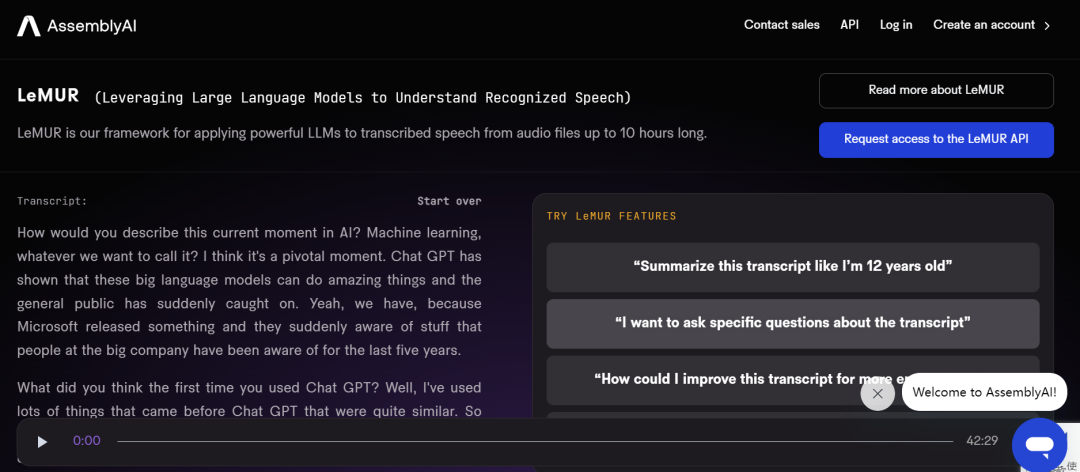

Baru-baru ini, syarikat AI pengecaman pertuturan AssemblyAI melancarkan model baharu yang dipanggil LeMUR. Sama seperti ChatGPT memproses berpuluh-puluh halaman teks PDF, LeMUR boleh menyalin dan memproses sehingga 10 jam rakaman, dan kemudian membantu pengguna meringkaskan kandungan teras ucapan dan menjawab soalan yang dimasukkan oleh pengguna.

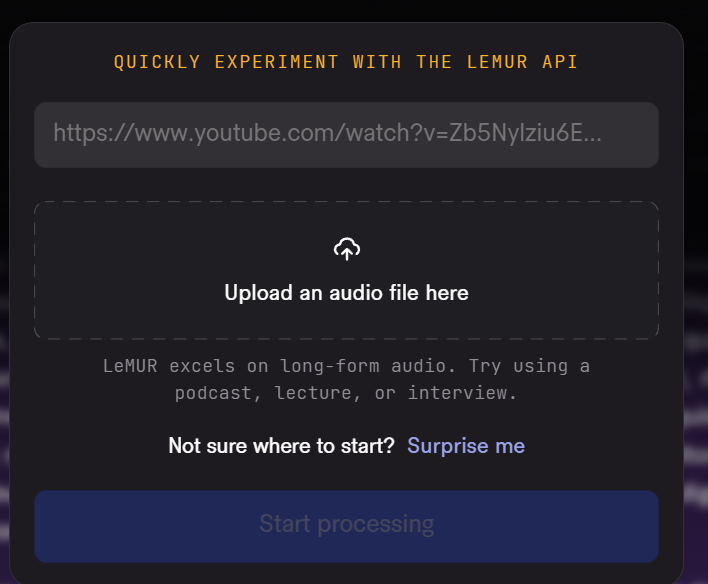

Alamat percubaan: https://www.assemblyai.com/playground/v2/source

LeMUR ialah singkatan daripada Memanfaatkan Model Bahasa Besar untuk Memahami Pertuturan yang Diiktiraf Ia merupakan rangka kerja baharu untuk menggunakan LLM yang berkuasa pada pertuturan yang ditranskripsi. Dengan hanya satu baris kod (melalui Python SDK AssemblyAI), LeMUR boleh memproses transkripsi kandungan audio sehingga 10 jam dengan cepat, dengan berkesan menukarkannya kepada kira-kira 150,000 token. Sebaliknya, LLM vanila di luar rak hanya boleh menampung sehingga 8K, atau kira-kira 45 minit audio yang ditranskripsi dalam kekangan tetingkap konteksnya.

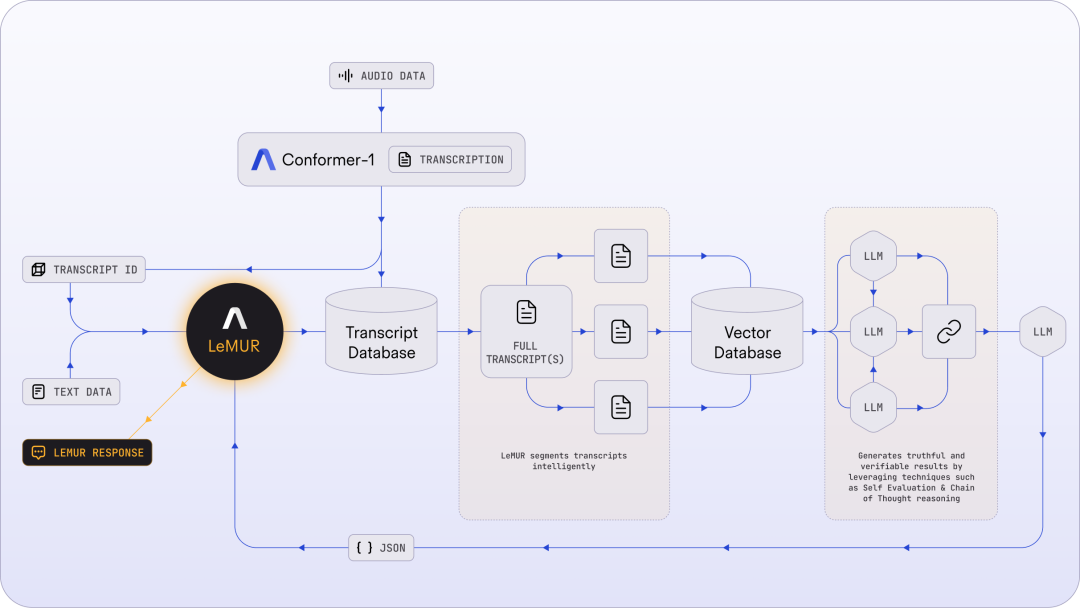

Untuk mengurangkan kerumitan penggunaan LLM pada fail audio yang ditranskripsi, saluran paip LeMUR terutamanya merangkumi segmentasi pintar, pangkalan data Vektor yang pantas dan beberapa langkah penaakulan (seperti gesaan rantaian pemikiran dan penilaian kendiri), seperti yang ditunjukkan di bawah:

Rajah 1: Seni bina LeMUR membolehkan pengguna menghantar fail transkrip audio yang panjang dan/atau berbilang ke LLM dengan satu panggilan API.

Pada masa hadapan, LeMUR dijangka akan digunakan secara meluas dalam perkhidmatan pelanggan dan bidang lain.

LeMUR membuka beberapa kemungkinan baharu yang menakjubkan yang saya tidak fikir mungkin berlaku hanya beberapa tahun yang lalu. Rasanya benar-benar menakjubkan untuk dapat dengan mudah mengeluarkan cerapan berharga seperti menentukan tindakan terbaik dan hasil panggilan yang arif seperti jualan, janji temu atau tujuan panggilan. —Ryan Johnson, ketua pegawai produk di CallRail, sebuah syarikat teknologi perkhidmatan penjejakan panggilan dan analitik

Apakah kemungkinan yang LeMUR buka kunci?

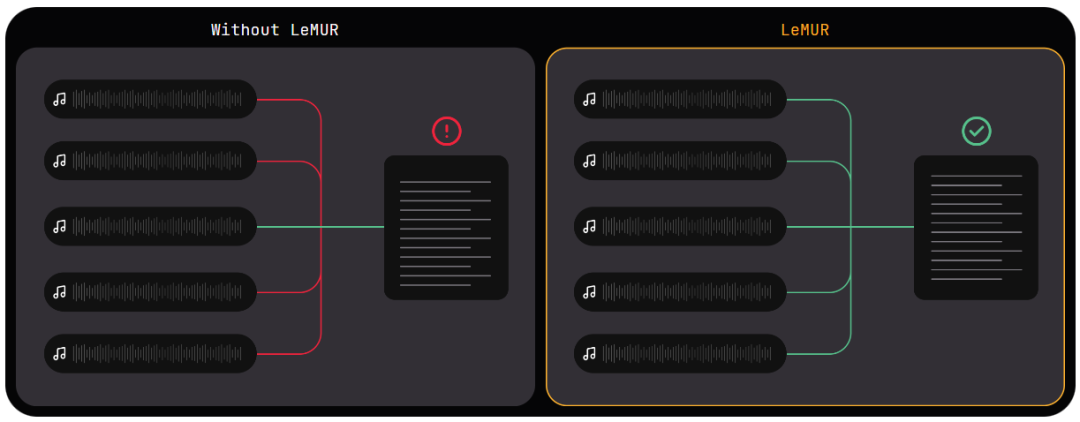

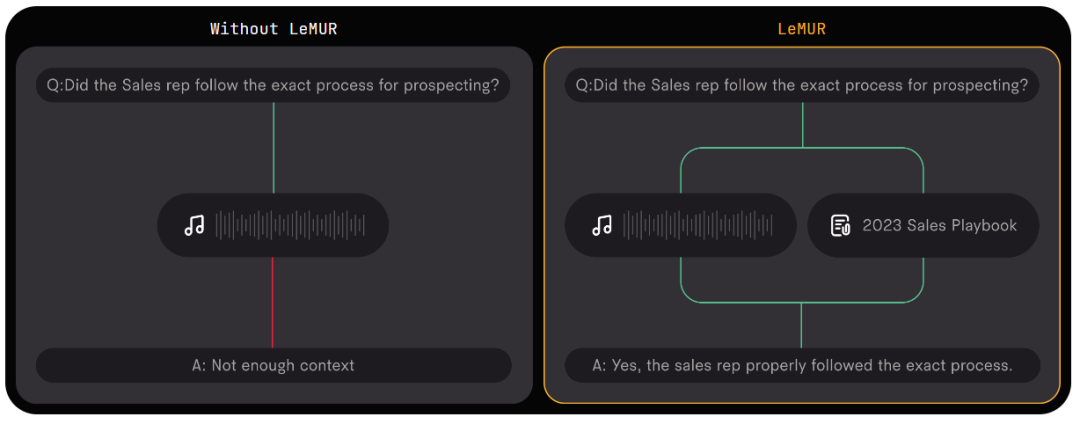

Gunakan LLM pada berbilang teks audio

LeMUR membenarkan pengguna mendapatkan pemprosesan LLM berbilang fail audio sekaligus Maklum balas dan ke atas hingga 10 jam hasil transkripsi suara, panjang token teks yang ditukar boleh mencapai 150K.

Keluaran yang boleh dipercayai dan selamat

Kerana LeMUR termasuk langkah keselamatan dan penapis kandungan, ia akan memberikan pengguna respons daripada LLM yang kurang berkemungkinan menjana bahasa yang berbahaya atau berat sebelah.

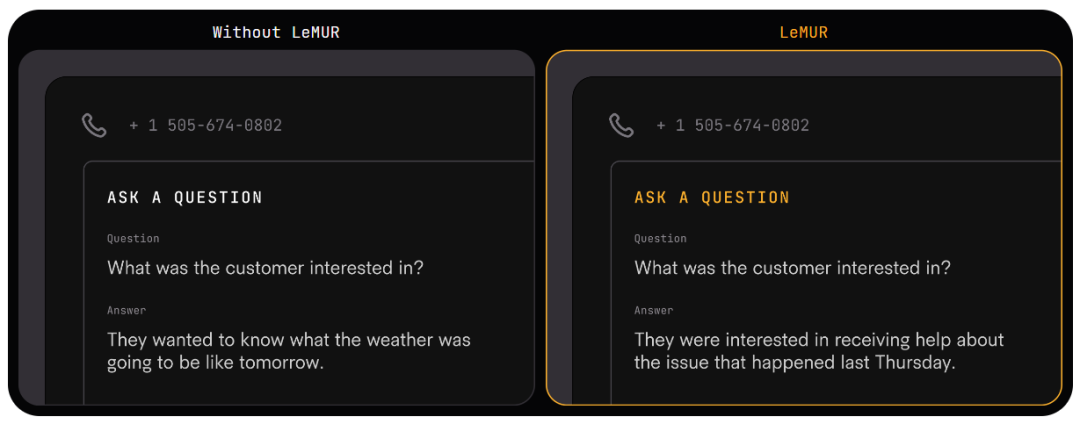

boleh menambah konteks

dalam penaakulan Apabila digunakan, ia membenarkan penggabungan maklumat kontekstual tambahan yang LLM boleh memanfaatkan untuk memberikan hasil yang diperibadikan dan lebih tepat apabila menjana output.

Modular, penyepaduan pantas

LeMUR sentiasa mengembalikan data berstruktur dalam bentuk JSON yang boleh diproses. Pengguna boleh menyesuaikan lagi format output LeMUR untuk memastikan bahawa respons yang diberikan oleh LLM adalah dalam format yang dijangkakan oleh bahagian logik perniagaan mereka yang seterusnya (cth. menukar jawapan kepada nilai Boolean). Dalam proses ini, pengguna tidak perlu lagi menulis kod khusus untuk memproses output LLM.

Keputusan percubaan

Menurut pautan ujian yang disediakan oleh AssemblyAI, Heart of the Machine menguji LeMUR.

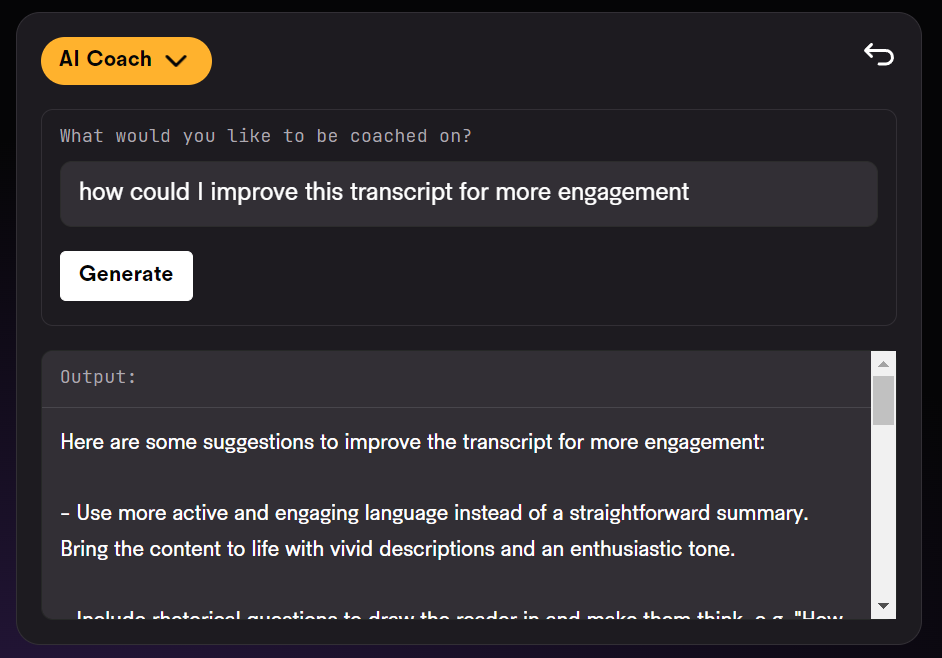

Antara muka LeMUR menyokong dua kaedah input fail: memuat naik fail audio dan video atau menampal pautan web.

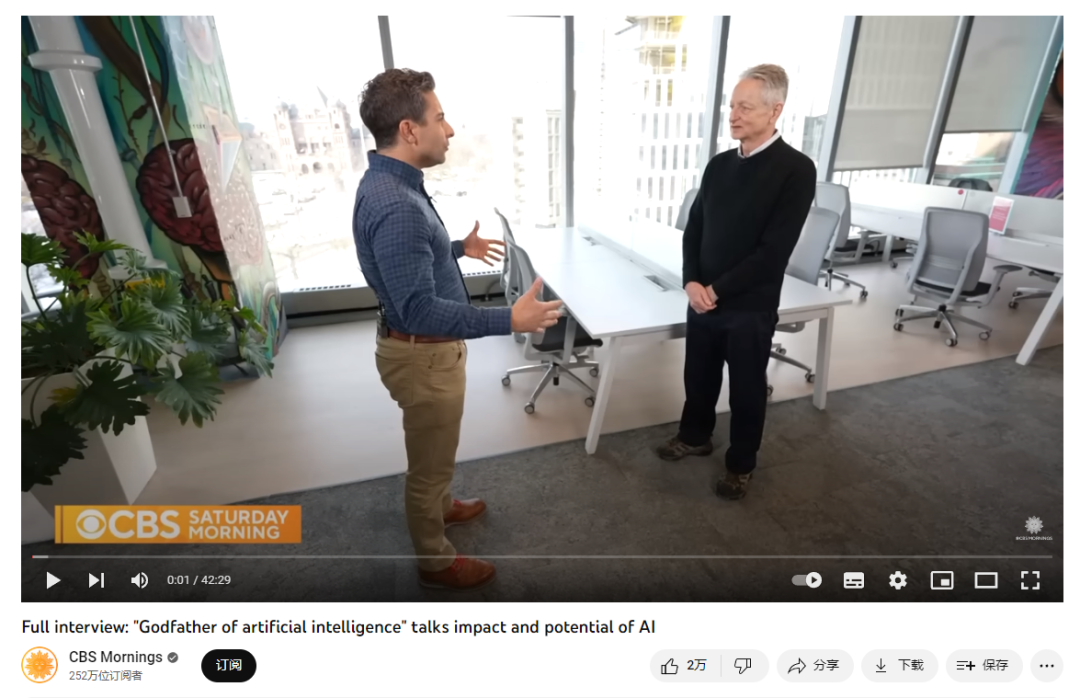

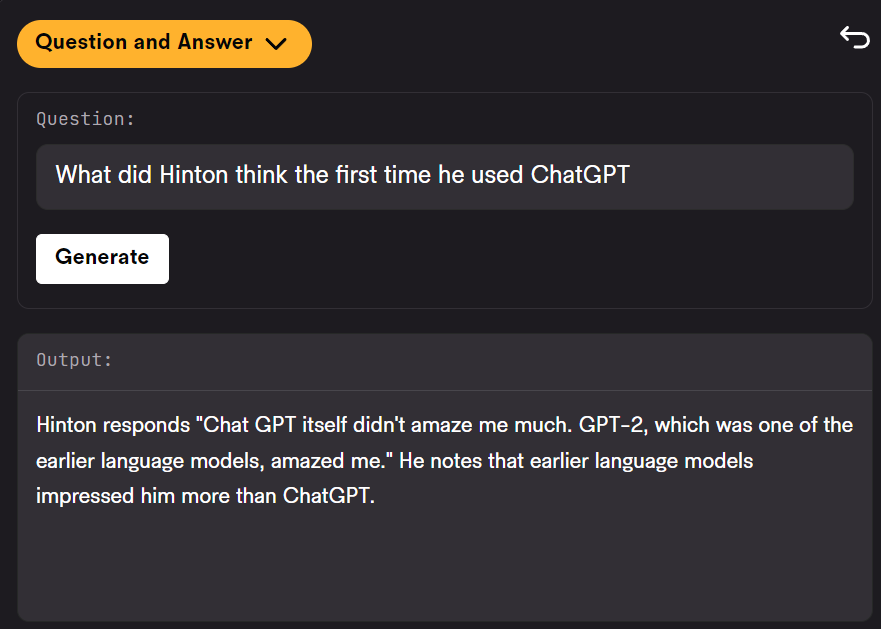

Kami menggunakan data temu bual terkini Hinton sebagai input untuk menguji prestasi LeMUR.

Selepas memuat naik, sistem menggesa kami untuk menunggu seketika kerana ia perlu menukar pertuturan kepada teks terlebih dahulu.

Antara muka selepas transkripsi adalah seperti berikut:

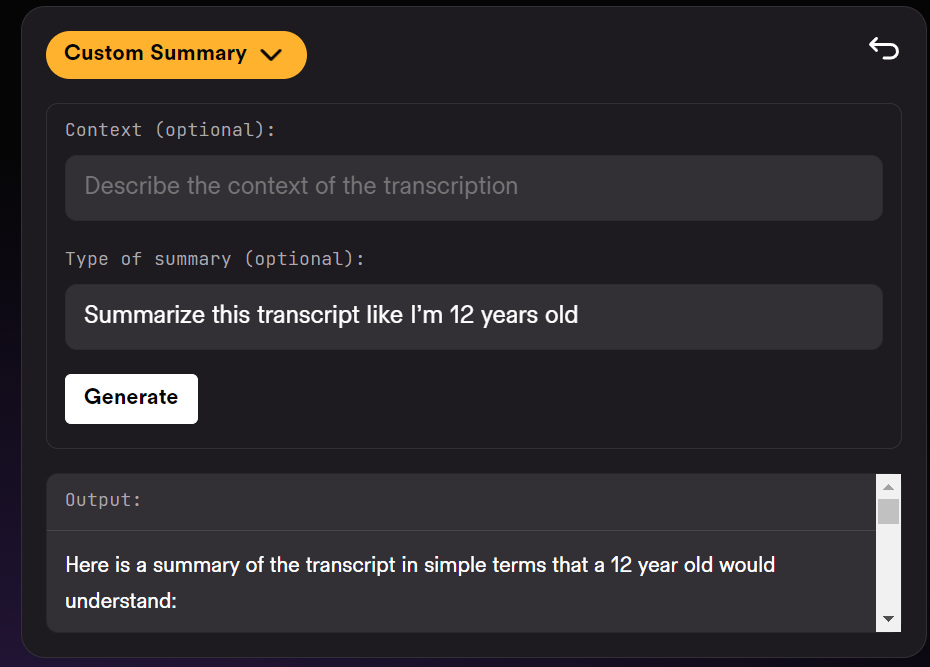

Di sebelah kanan halaman, kita boleh meminta LeMUR meringkaskan temu bual atau menjawab soalan. LeMUR pada asasnya menyelesaikan tugas dengan mudah:

Jika suara yang ingin anda proses ialah ucapan atau balasan perkhidmatan pelanggan, anda juga boleh meminta LeMUR untuk cadangan penambahbaikan.

Namun, LeMUR nampaknya masih belum menyokong bahasa Cina. Pembaca yang berminat boleh mencubanya.

Atas ialah kandungan terperinci ChatGPT yang boleh memahami pertuturan ada di sini: 10 jam rakaman dilemparkan, tanya apa sahaja yang anda mahu. Untuk maklumat lanjut, sila ikut artikel berkaitan lain di laman web China PHP!

Alat AI Hot

Undresser.AI Undress

Apl berkuasa AI untuk mencipta foto bogel yang realistik

AI Clothes Remover

Alat AI dalam talian untuk mengeluarkan pakaian daripada foto.

Undress AI Tool

Gambar buka pakaian secara percuma

Clothoff.io

Penyingkiran pakaian AI

Video Face Swap

Tukar muka dalam mana-mana video dengan mudah menggunakan alat tukar muka AI percuma kami!

Artikel Panas

Alat panas

Notepad++7.3.1

Editor kod yang mudah digunakan dan percuma

SublimeText3 versi Cina

Versi Cina, sangat mudah digunakan

Hantar Studio 13.0.1

Persekitaran pembangunan bersepadu PHP yang berkuasa

Dreamweaver CS6

Alat pembangunan web visual

SublimeText3 versi Mac

Perisian penyuntingan kod peringkat Tuhan (SublimeText3)

Topik panas

1677

1677

14

14

1430

1430

52

52

1333

1333

25

25

1278

1278

29

29

1257

1257

24

24

Model MoE sumber terbuka paling berkuasa di dunia ada di sini, dengan keupayaan bahasa Cina setanding dengan GPT-4, dan harganya hanya hampir satu peratus daripada GPT-4-Turbo

May 07, 2024 pm 04:13 PM

Model MoE sumber terbuka paling berkuasa di dunia ada di sini, dengan keupayaan bahasa Cina setanding dengan GPT-4, dan harganya hanya hampir satu peratus daripada GPT-4-Turbo

May 07, 2024 pm 04:13 PM

Bayangkan model kecerdasan buatan yang bukan sahaja mempunyai keupayaan untuk mengatasi pengkomputeran tradisional, tetapi juga mencapai prestasi yang lebih cekap pada kos yang lebih rendah. Ini bukan fiksyen sains, DeepSeek-V2[1], model MoE sumber terbuka paling berkuasa di dunia ada di sini. DeepSeek-V2 ialah gabungan model bahasa pakar (MoE) yang berkuasa dengan ciri-ciri latihan ekonomi dan inferens yang cekap. Ia terdiri daripada 236B parameter, 21B daripadanya digunakan untuk mengaktifkan setiap penanda. Berbanding dengan DeepSeek67B, DeepSeek-V2 mempunyai prestasi yang lebih kukuh, sambil menjimatkan 42.5% kos latihan, mengurangkan cache KV sebanyak 93.3% dan meningkatkan daya pemprosesan penjanaan maksimum kepada 5.76 kali. DeepSeek ialah sebuah syarikat yang meneroka kecerdasan buatan am

Apr 09, 2024 am 11:52 AM

Apr 09, 2024 am 11:52 AM

AI memang mengubah matematik. Baru-baru ini, Tao Zhexuan, yang telah mengambil perhatian terhadap isu ini, telah memajukan keluaran terbaru "Buletin Persatuan Matematik Amerika" (Buletin Persatuan Matematik Amerika). Memfokuskan pada topik "Adakah mesin akan mengubah matematik?", ramai ahli matematik menyatakan pendapat mereka Seluruh proses itu penuh dengan percikan api, tegar dan menarik. Penulis mempunyai barisan yang kuat, termasuk pemenang Fields Medal Akshay Venkatesh, ahli matematik China Zheng Lejun, saintis komputer NYU Ernest Davis dan ramai lagi sarjana terkenal dalam industri. Dunia AI telah berubah secara mendadak Anda tahu, banyak artikel ini telah dihantar setahun yang lalu.

Google gembira: prestasi JAX mengatasi Pytorch dan TensorFlow! Ia mungkin menjadi pilihan terpantas untuk latihan inferens GPU

Apr 01, 2024 pm 07:46 PM

Google gembira: prestasi JAX mengatasi Pytorch dan TensorFlow! Ia mungkin menjadi pilihan terpantas untuk latihan inferens GPU

Apr 01, 2024 pm 07:46 PM

Prestasi JAX, yang dipromosikan oleh Google, telah mengatasi Pytorch dan TensorFlow dalam ujian penanda aras baru-baru ini, menduduki tempat pertama dalam 7 penunjuk. Dan ujian tidak dilakukan pada TPU dengan prestasi JAX terbaik. Walaupun dalam kalangan pembangun, Pytorch masih lebih popular daripada Tensorflow. Tetapi pada masa hadapan, mungkin lebih banyak model besar akan dilatih dan dijalankan berdasarkan platform JAX. Model Baru-baru ini, pasukan Keras menanda aras tiga hujung belakang (TensorFlow, JAX, PyTorch) dengan pelaksanaan PyTorch asli dan Keras2 dengan TensorFlow. Pertama, mereka memilih satu set arus perdana

Hello, Atlas elektrik! Robot Boston Dynamics hidup semula, gerakan pelik 180 darjah menakutkan Musk

Apr 18, 2024 pm 07:58 PM

Hello, Atlas elektrik! Robot Boston Dynamics hidup semula, gerakan pelik 180 darjah menakutkan Musk

Apr 18, 2024 pm 07:58 PM

Boston Dynamics Atlas secara rasmi memasuki era robot elektrik! Semalam, Atlas hidraulik hanya "menangis" menarik diri daripada peringkat sejarah Hari ini, Boston Dynamics mengumumkan bahawa Atlas elektrik sedang berfungsi. Nampaknya dalam bidang robot humanoid komersial, Boston Dynamics berazam untuk bersaing dengan Tesla. Selepas video baharu itu dikeluarkan, ia telah pun ditonton oleh lebih sejuta orang dalam masa sepuluh jam sahaja. Orang lama pergi dan peranan baru muncul. Ini adalah keperluan sejarah. Tidak dinafikan bahawa tahun ini adalah tahun letupan robot humanoid. Netizen mengulas: Kemajuan robot telah menjadikan majlis pembukaan tahun ini kelihatan seperti manusia, dan tahap kebebasan adalah jauh lebih besar daripada manusia Tetapi adakah ini benar-benar bukan filem seram? Pada permulaan video, Atlas berbaring dengan tenang di atas tanah, seolah-olah terlentang. Apa yang berikut adalah rahang-jatuh

KAN, yang menggantikan MLP, telah diperluaskan kepada konvolusi oleh projek sumber terbuka

Jun 01, 2024 pm 10:03 PM

KAN, yang menggantikan MLP, telah diperluaskan kepada konvolusi oleh projek sumber terbuka

Jun 01, 2024 pm 10:03 PM

Awal bulan ini, penyelidik dari MIT dan institusi lain mencadangkan alternatif yang sangat menjanjikan kepada MLP - KAN. KAN mengatasi MLP dari segi ketepatan dan kebolehtafsiran. Dan ia boleh mengatasi prestasi MLP berjalan dengan bilangan parameter yang lebih besar dengan bilangan parameter yang sangat kecil. Sebagai contoh, penulis menyatakan bahawa mereka menggunakan KAN untuk menghasilkan semula keputusan DeepMind dengan rangkaian yang lebih kecil dan tahap automasi yang lebih tinggi. Khususnya, MLP DeepMind mempunyai kira-kira 300,000 parameter, manakala KAN hanya mempunyai kira-kira 200 parameter. KAN mempunyai asas matematik yang kukuh seperti MLP berdasarkan teorem penghampiran universal, manakala KAN berdasarkan teorem perwakilan Kolmogorov-Arnold. Seperti yang ditunjukkan dalam rajah di bawah, KAN telah

Kerja baharu pada ramalan siri masa + model besar NLP: secara automatik menjana gesaan tersirat untuk ramalan siri masa

Mar 18, 2024 am 09:20 AM

Kerja baharu pada ramalan siri masa + model besar NLP: secara automatik menjana gesaan tersirat untuk ramalan siri masa

Mar 18, 2024 am 09:20 AM

Hari ini saya ingin berkongsi kerja penyelidikan terbaru dari University of Connecticut yang mencadangkan kaedah untuk menyelaraskan data siri masa dengan model pemprosesan bahasa semula jadi (NLP) yang besar pada ruang terpendam untuk meningkatkan prestasi peramalan siri masa. Kunci kepada kaedah ini ialah menggunakan petunjuk spatial terpendam (prompt) untuk meningkatkan ketepatan ramalan siri masa. Tajuk kertas: S2IP-LLM: SemanticSpaceInformedPromptLearningwithLLMforTimeSeriesForecasting Alamat muat turun: https://arxiv.org/pdf/2403.05798v1.pdf 1. Model latar belakang masalah besar

Robot Tesla bekerja di kilang, Musk: Tahap kebebasan tangan akan mencapai 22 tahun ini!

May 06, 2024 pm 04:13 PM

Robot Tesla bekerja di kilang, Musk: Tahap kebebasan tangan akan mencapai 22 tahun ini!

May 06, 2024 pm 04:13 PM

Video terbaru robot Tesla Optimus dikeluarkan, dan ia sudah boleh berfungsi di kilang. Pada kelajuan biasa, ia mengisih bateri (bateri 4680 Tesla) seperti ini: Pegawai itu juga mengeluarkan rupanya pada kelajuan 20x - pada "stesen kerja" kecil, memilih dan memilih dan memilih: Kali ini ia dikeluarkan Salah satu sorotan video itu ialah Optimus menyelesaikan kerja ini di kilang, sepenuhnya secara autonomi, tanpa campur tangan manusia sepanjang proses. Dan dari perspektif Optimus, ia juga boleh mengambil dan meletakkan bateri yang bengkok, memfokuskan pada pembetulan ralat automatik: Berkenaan tangan Optimus, saintis NVIDIA Jim Fan memberikan penilaian yang tinggi: Tangan Optimus adalah robot lima jari di dunia paling cerdik. Tangannya bukan sahaja boleh disentuh

DualBEV: mengatasi BEVFormer dan BEVDet4D dengan ketara, buka buku!

Mar 21, 2024 pm 05:21 PM

DualBEV: mengatasi BEVFormer dan BEVDet4D dengan ketara, buka buku!

Mar 21, 2024 pm 05:21 PM

Kertas kerja ini meneroka masalah mengesan objek dengan tepat dari sudut pandangan yang berbeza (seperti perspektif dan pandangan mata burung) dalam pemanduan autonomi, terutamanya cara mengubah ciri dari perspektif (PV) kepada ruang pandangan mata burung (BEV) dengan berkesan dilaksanakan melalui modul Transformasi Visual (VT). Kaedah sedia ada secara amnya dibahagikan kepada dua strategi: penukaran 2D kepada 3D dan 3D kepada 2D. Kaedah 2D-ke-3D meningkatkan ciri 2D yang padat dengan meramalkan kebarangkalian kedalaman, tetapi ketidakpastian yang wujud dalam ramalan kedalaman, terutamanya di kawasan yang jauh, mungkin menimbulkan ketidaktepatan. Manakala kaedah 3D ke 2D biasanya menggunakan pertanyaan 3D untuk mencuba ciri 2D dan mempelajari berat perhatian bagi kesesuaian antara ciri 3D dan 2D melalui Transformer, yang meningkatkan masa pengiraan dan penggunaan.