Memperkasakan AI dengan Deria: Perjalanan ke LLM Multimodal Bahagian 1

model bahasa besar multimodal (LLMS): merapatkan jurang antara teks dan penglihatan

Dunia kita berpengalaman melalui pelbagai deria - bahasa, penglihatan, bau, dan sentuhan - membolehkan kita memahami persekitaran kita. Manusia sangat mahir dalam penalaran linguistik dan memori visual. Sebagai model generatif AI (genai), penyelidik memberi tumpuan kepada menggabungkan multimodaliti untuk mengembangkan keupayaan mereka. Model bahasa besar tradisional (LLM) terhad kepada input dan output teks, mengabaikan modaliti lain seperti imej, video, atau audio. Walaupun LLMS cemerlang dalam tugas -tugas seperti menjawab soalan, ringkasan, terjemahan, dan penjanaan kod, mengintegrasikan modaliti lain (mewujudkan LLM multimodal) membuka potensi yang besar. Sebagai contoh, menggabungkan data teks dan imej membolehkan aplikasi seperti menjawab soalan visual, segmentasi imej, dan pengesanan objek. Menambah video meningkatkan keupayaan untuk analisis media canggih.

Jadual Kandungan

- Pengenalan kepada Multimodal LLMS

- dataset dan preprocessing

- Aplikasi Multimodal LLMS

- Captioning Image

- Pengekstrakan maklumat

- Tafsiran Visual dan Penalaran

- Pengiktirafan Watak Optik (OCR)

- Pengesanan dan Segmentasi Objek

- Senibina model bahasa penglihatan yang besar (LVLMS)

- dua menara VLMS

- Dua kaki VLMS

- vlms dengan pengekod imej, pengekod teks & decoder

- VLMS dengan arsitektur pengekod-decoder

- Kesimpulan

Pengenalan kepada Multimodal LLMS

Genai merangkumi model pembelajaran mesin yang mampu menghasilkan kandungan baru. Model teks-ke-teks, sebagai contoh, menjana teks dari input teks. Walau bagaimanapun, memperluaskan LLM dengan modaliti lain membuka pintu kepada teks-ke-ke-video, teks-video, teks-ke-ucapan, imej-ke-imej, dan aplikasi imej-ke-video. Ini dikenali sebagai model multimodal besar (LLM multimodal). Latihan model ini melibatkan dataset besar yang mengandungi teks dan modaliti lain, membolehkan algoritma mempelajari hubungan antara semua jenis input. Secara asasnya, model -model ini tidak terhad kepada jenis input/output tunggal; Mereka menyesuaikan diri dengan pelbagai modaliti. Ini menyediakan sistem dengan pemahaman yang lebih kaya tentang input deria.

Artikel ini dibahagikan kepada dua bahagian: yang pertama meneroka aplikasi dan seni bina LLM multimodal, sementara yang kedua (tidak termasuk di sini) memperincikan latihan model penglihatan yang lebih kecil.

dataset dan preprocessing

Menggabungkan jenis data yang berbeza untuk membuat LLM multimodal memberikan cabaran, terutamanya apabila mengendalikan data 1D, 2D, dan 3D secara serentak. Ini memerlukan pendekatan berturut-turut, langkah demi langkah dengan kurasi data yang teliti untuk mengoptimumkan prestasi model.

Perbincangan ini memberi tumpuan kepada teks dan imej. Imej dan video, tidak seperti teks, bervariasi dalam saiz dan resolusi, yang memerlukan pra -proses yang mantap untuk menyeragamkan input. Imej, video, arahan, dan metadata mesti bersedia untuk memudahkan proses pemikiran yang koheren dan konsistensi logik semasa kesimpulan. Model yang dilatih dalam teks, imej, dan data video dipanggil model bahasa penglihatan yang besar (LVLMS).

Aplikasi Multimodal LLMS

Imej berikut (dari kertas QWEN2-VL) menggambarkan model penglihatan berdasarkan QWEN2 LLM, mampu mengendalikan pelbagai tugas visual.

Bahagian berikut terperinci aplikasi khusus (contoh kod yang ditinggalkan untuk keringkasan):

Bahagian berikut terperinci aplikasi khusus (contoh kod yang ditinggalkan untuk keringkasan):

1. Tajuk Imej: Menjana Penerangan Teks Imej.

2. Pengekstrakan maklumat: Mendapatkan ciri khusus atau titik data dari imej (mis., Warna objek, teks).

3. Tafsiran & Penalaran Visual: Menganalisis imej dan melaksanakan tugas penalaran berdasarkan maklumat visual.

4. Pengiktirafan watak optik (OCR): Mengekstrak teks dari imej.

5. Pengesanan & Segmentasi Objek: Mengenalpasti dan mengklasifikasikan objek dalam imej, berpotensi membahagikannya ke kawasan yang berbeza.

Senibina model bahasa penglihatan yang besar (LVLMS)

Matlamat LVLMS adalah untuk menyatukan ciri dari imej, video, dan teks. Beberapa seni bina sedang diterokai untuk pra-latihan:

1. Dua menara VLM: Imej dan teks dikodkan secara berasingan dan dilatih dengan objektif bersama untuk menyelaraskan maklumat dari kedua-dua modaliti.

2. VLM dua kaki: Sama seperti dua menara, tetapi termasuk lapisan gabungan untuk menggabungkan ciri-ciri imej dan teks sebelum objektif bersama.

4. VLMS dengan arsitektur pengekod-decoder: Imej diproses oleh pengekod, teks oleh penyahkod, dengan ciri-ciri yang digabungkan (melalui concatenation atau silang) sebelum penyahkodan.

LLM multimodal, terutamanya VLM, dilatih pada dataset teks imej untuk merapatkan jurang antara data visual dan teks. Mereka cemerlang dalam tugas visual, tetapi mencapai prestasi tinggi memerlukan dataset yang besar dan sumber pengiraan. Walaupun mampu banyak tugas visual, batasan kekal dalam penalaran kompleks dan pengekstrakan data. Penyelidikan dan pembangunan lebih lanjut adalah penting untuk mengatasi batasan -batasan ini dan membuka kunci potensi penuh LLM multimodal.

rujukan (senarai yang disediakan dalam teks asal)

Atas ialah kandungan terperinci Memperkasakan AI dengan Deria: Perjalanan ke LLM Multimodal Bahagian 1. Untuk maklumat lanjut, sila ikut artikel berkaitan lain di laman web China PHP!

Alat AI Hot

Undresser.AI Undress

Apl berkuasa AI untuk mencipta foto bogel yang realistik

AI Clothes Remover

Alat AI dalam talian untuk mengeluarkan pakaian daripada foto.

Undress AI Tool

Gambar buka pakaian secara percuma

Clothoff.io

Penyingkiran pakaian AI

Video Face Swap

Tukar muka dalam mana-mana video dengan mudah menggunakan alat tukar muka AI percuma kami!

Artikel Panas

Alat panas

Notepad++7.3.1

Editor kod yang mudah digunakan dan percuma

SublimeText3 versi Cina

Versi Cina, sangat mudah digunakan

Hantar Studio 13.0.1

Persekitaran pembangunan bersepadu PHP yang berkuasa

Dreamweaver CS6

Alat pembangunan web visual

SublimeText3 versi Mac

Perisian penyuntingan kod peringkat Tuhan (SublimeText3)

Topik panas

1673

1673

14

14

1429

1429

52

52

1333

1333

25

25

1278

1278

29

29

1257

1257

24

24

Bagaimana Membina Ejen AI Multimodal Menggunakan Rangka Kerja AGNO?

Apr 23, 2025 am 11:30 AM

Bagaimana Membina Ejen AI Multimodal Menggunakan Rangka Kerja AGNO?

Apr 23, 2025 am 11:30 AM

Semasa bekerja pada AIS AI, pemaju sering mendapati diri mereka menavigasi perdagangan antara kelajuan, fleksibiliti, dan kecekapan sumber. Saya telah meneroka rangka kerja AI yang agentik dan menjumpai Agno (sebelum ini adalah Phi-

Bagaimana untuk menambah lajur dalam SQL? - Analytics Vidhya

Apr 17, 2025 am 11:43 AM

Bagaimana untuk menambah lajur dalam SQL? - Analytics Vidhya

Apr 17, 2025 am 11:43 AM

Pernyataan Jadual Alter SQL: Menambah lajur secara dinamik ke pangkalan data anda Dalam pengurusan data, kebolehsuaian SQL adalah penting. Perlu menyesuaikan struktur pangkalan data anda dengan cepat? Pernyataan Jadual ALTER adalah penyelesaian anda. Butiran panduan ini menambah colu

Terbuka beralih fokus dengan GPT-4.1, mengutamakan pengekodan dan kecekapan kos

Apr 16, 2025 am 11:37 AM

Terbuka beralih fokus dengan GPT-4.1, mengutamakan pengekodan dan kecekapan kos

Apr 16, 2025 am 11:37 AM

Pelepasan ini termasuk tiga model yang berbeza, GPT-4.1, GPT-4.1 Mini dan GPT-4.1 Nano, menandakan langkah ke arah pengoptimuman khusus tugas dalam landskap model bahasa yang besar. Model-model ini tidak segera menggantikan antara muka yang dihadapi pengguna seperti

Kursus Pendek Baru mengenai Model Embedding oleh Andrew Ng

Apr 15, 2025 am 11:32 AM

Kursus Pendek Baru mengenai Model Embedding oleh Andrew Ng

Apr 15, 2025 am 11:32 AM

Buka kunci kekuatan model embedding: menyelam jauh ke kursus baru Andrew Ng Bayangkan masa depan di mana mesin memahami dan menjawab soalan anda dengan ketepatan yang sempurna. Ini bukan fiksyen sains; Terima kasih kepada kemajuan dalam AI, ia menjadi R

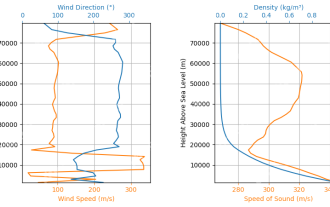

Simulasi dan analisis pelancaran roket menggunakan Rocketpy - Analytics Vidhya

Apr 19, 2025 am 11:12 AM

Simulasi dan analisis pelancaran roket menggunakan Rocketpy - Analytics Vidhya

Apr 19, 2025 am 11:12 AM

Simulasi Rocket dilancarkan dengan Rocketpy: Panduan Komprehensif Artikel ini membimbing anda melalui mensimulasikan pelancaran roket kuasa tinggi menggunakan Rocketpy, perpustakaan Python yang kuat. Kami akan merangkumi segala -galanya daripada menentukan komponen roket untuk menganalisis simula

Google melancarkan strategi ejen yang paling komprehensif di Cloud Seterusnya 2025

Apr 15, 2025 am 11:14 AM

Google melancarkan strategi ejen yang paling komprehensif di Cloud Seterusnya 2025

Apr 15, 2025 am 11:14 AM

Gemini sebagai asas strategi AI Google Gemini adalah asas kepada strategi ejen AI Google, memanfaatkan keupayaan multimodalnya untuk memproses dan menjana respons di seluruh teks, imej, audio, video dan kod. Dibangunkan oleh DeepM

Robot Humanoid Sumber Terbuka yang Anda Boleh Mencetak Diri 3D: Memeluk Wajah Membeli Robotik Debunga

Apr 15, 2025 am 11:25 AM

Robot Humanoid Sumber Terbuka yang Anda Boleh Mencetak Diri 3D: Memeluk Wajah Membeli Robotik Debunga

Apr 15, 2025 am 11:25 AM

"Super gembira untuk mengumumkan bahawa kami memperoleh robotik debunga untuk membawa robot sumber terbuka ke dunia," kata Hugging Face pada X. "Sejak Remi Cadene menyertai kami dari Tesla, kami telah menjadi platform perisian yang paling banyak digunakan untuk robot terbuka terima kasih

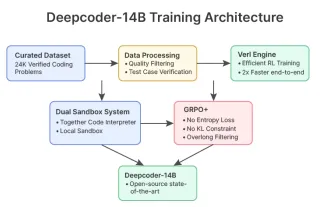

DeepCoder-14b: Pertandingan sumber terbuka untuk O3-Mini dan O1

Apr 26, 2025 am 09:07 AM

DeepCoder-14b: Pertandingan sumber terbuka untuk O3-Mini dan O1

Apr 26, 2025 am 09:07 AM

Dalam perkembangan penting bagi komuniti AI, Agentica dan bersama-sama AI telah mengeluarkan model pengekodan AI sumber terbuka bernama DeepCoder-14b. Menawarkan keupayaan penjanaan kod setanding dengan pesaing sumber tertutup seperti OpenAI