Peranti teknologi

Peranti teknologi

AI

AI

Panduan Komprehensif untuk Zephyr-7b: Ciri, Penggunaan, dan Penalaan Halus

Panduan Komprehensif untuk Zephyr-7b: Ciri, Penggunaan, dan Penalaan Halus

Panduan Komprehensif untuk Zephyr-7b: Ciri, Penggunaan, dan Penalaan Halus

meneroka zephyr-7b: llm sumber terbuka yang kuat

Leaderboard Openai LLM berdengung dengan model sumber terbuka baru yang bertujuan untuk menyaingi GPT-4, dan Zephyr-7b adalah pesaing yang menonjol. Tutorial ini meneroka model bahasa canggih ini dari Webpilot.ai, menunjukkan penggunaannya dengan saluran paip Transformers dan penalaan halus pada dataset agen-instruksi. Baru ke AI? Trek Kemahiran Asas AI adalah titik permulaan yang hebat.

Memahami Zephyr-7b

Zephyr-7b, sebahagian daripada siri Zephyr, dilatih berfungsi sebagai pembantu yang membantu. Kekuatannya terletak pada menghasilkan teks yang koheren, menterjemahkan bahasa, meringkaskan maklumat, analisis sentimen, dan menjawab soalan konteks.

zephyr-7b-β: keajaiban yang halus

Zephyr-7B-β, model kedua dalam siri ini, adalah model Mistral-7B yang disesuaikan dengan baik. Dilatih menggunakan Pengoptimuman Keutamaan Langsung (DPO) pada campuran dataset awam dan sintetik, ia cemerlang dalam menafsirkan pertanyaan kompleks dan meringkaskan teks yang panjang. Pada pembebasannya, ia memegang tempat teratas di kalangan model sembang 7B pada penanda aras MT-Bench dan Alpacaeval. Uji kemampuannya dengan demo percuma pada sembang zephyr.

imej dari Zephyr Chat

mengakses Zephyr-7b dengan memeluk Transformers FaceTutorial ini menggunakan Transformers Face Hugging untuk akses mudah. (Jika anda menghadapi masalah memuatkan, rujuk buku nota Kaggle Inference.)

- Pasang perpustakaan: Pastikan anda mempunyai versi terkini:

!pip install -q -U transformers !pip install -q -U accelerate !pip install -q -U bitsandbytes

- Perpustakaan import:

import torch from transformers import pipeline

- Buat saluran paip: menggunakan pelbagai GPU untuk generasi yang lebih cepat.

device_map="auto"menawarkan pengiraan yang lebih cepat dan mengurangkan penggunaan memori (tetapi dengan ketepatan yang sedikit lebih rendah).torch.bfloat16

model_name = "HuggingFaceH4/zephyr-7b-beta"

pipe = pipeline(

"text-generation",

model=model_name,

torch_dtype=torch.bfloat16,

device_map="auto",

)- menghasilkan teks: Contoh di bawah menunjukkan penjanaan kod python.

prompt = "Write a Python function that can clean the HTML tags from the file:"

outputs = pipe(

prompt,

max_new_tokens=300,

do_sample=True,

temperature=0.7,

top_k=50,

top_p=0.95,

)

print(outputs[0]["generated_text"])

- Sistem arahan:

- Sesuaikan respons dengan sistem gaya Zephyr-7b yang diminta:

messages = [

{

"role": "system",

"content": "You are a skilled software engineer who consistently produces high-quality Python code.",

},

{

"role": "user",

"content": "Write a Python code to display text in a star pattern.",

},

]

prompt = pipe.tokenizer.apply_chat_template(

messages, tokenize=False, add_generation_prompt=True

)

outputs = pipe(

prompt,

max_new_tokens=300,

do_sample=True,

temperature=0.7,

top_k=50,

top_p=0.95,

)

print(outputs[0]["generated_text"]) zephyr-7b penalaan halus pada dataset tersuai

menyediakan dan menyediakan persekitaran

- Pasang perpustakaan:

!pip install -q -U transformers

!pip install -q -U accelerate

!pip install -q -U bitsandbytes

Salin selepas log masukSalin selepas log masuk

- Modul import:

import torch

from transformers import pipeline

Salin selepas log masukSalin selepas log masuk

-

Kaggle Secrets (untuk buku nota Kaggle): Ambil muka dan berat badan API memeluk.

-

memeluk muka dan berat & berat badan log masuk:

model_name = "HuggingFaceH4/zephyr-7b-beta"

pipe = pipeline(

"text-generation",

model=model_name,

torch_dtype=torch.bfloat16,

device_map="auto",

)Salin selepas log masukSalin selepas log masuk

!pip install -q -U transformers !pip install -q -U accelerate !pip install -q -U bitsandbytes

import torch from transformers import pipeline

Kaggle Secrets (untuk buku nota Kaggle): Ambil muka dan berat badan API memeluk.

memeluk muka dan berat & berat badan log masuk:

model_name = "HuggingFaceH4/zephyr-7b-beta"

pipe = pipeline(

"text-generation",

model=model_name,

torch_dtype=torch.bfloat16,

device_map="auto",

)

- Tentukan Model dan Nama Dataset:

prompt = "Write a Python function that can clean the HTML tags from the file:"

outputs = pipe(

prompt,

max_new_tokens=300,

do_sample=True,

temperature=0.7,

top_k=50,

top_p=0.95,

)

print(outputs[0]["generated_text"])fungsi

menyesuaikan dataset ke gaya cepat Zephyr-7b. format_prompt

messages = [

{

"role": "system",

"content": "You are a skilled software engineer who consistently produces high-quality Python code.",

},

{

"role": "user",

"content": "Write a Python code to display text in a star pattern.",

},

]

prompt = pipe.tokenizer.apply_chat_template(

messages, tokenize=False, add_generation_prompt=True

)

outputs = pipe(

prompt,

max_new_tokens=300,

do_sample=True,

temperature=0.7,

top_k=50,

top_p=0.95,

)

print(outputs[0]["generated_text"])

Memuat dan menyediakan model

Memuat dan menyediakan model

- Model beban dengan ketepatan 4-bit:

- Ini penting untuk latihan yang cekap pada GPU dengan VRAM terhad.

%%capture %pip install -U bitsandbytes %pip install -U transformers %pip install -U peft %pip install -U accelerate %pip install -U trl

- beban tokenizer:

# ... (Import statements as in original tutorial) ...

- Tambah lapisan penyesuai (PEFT):

- Ini membolehkan penalaan halus dengan hanya mengemas kini parameter dalam lapisan penyesuai.

!huggingface-cli login --token $secret_hf # ... (wandb login as in original tutorial) ...

- Argumen Latihan:

- Konfigurasi HyperParameters (rujuk tutorial Llama 2 yang baik untuk butiran).

base_model = "HuggingFaceH4/zephyr-7b-beta" dataset_name = "THUDM/AgentInstruct" new_model = "zephyr-7b-beta-Agent-Instruct"

- pelatih sft:

- Gunakan perpustakaan TRL memeluk Face untuk membuat jurulatih.

# ... (format_prompt function and dataset loading as in original tutorial) ...

- Latihan Mula:

# ... (bnb_config and model loading as in original tutorial) ...

menjimatkan dan menggunakan model yang halus

menjimatkan dan menggunakan model yang halus

- Simpan model:

# ... (tokenizer loading and configuration as in original tutorial) ...

- tolak untuk memeluk hub muka:

# ... (peft_config and model preparation as in original tutorial) ...

menguji model yang disesuaikan dengan baik

menguji model yang disesuaikan dengan baik

Uji prestasi model dengan pelbagai arahan. Contoh disediakan dalam tutorial asal.

Kesimpulan

Zephyr-7b-beta menunjukkan keupayaan yang mengagumkan. Tutorial ini menyediakan panduan yang komprehensif untuk menggunakan dan menyempurnakan LLM yang kuat ini, walaupun pada GPU yang dikendalikan oleh sumber. Pertimbangkan kursus konsep Model Bahasa Besar (LLMS) untuk pengetahuan LLM yang lebih mendalam.

Atas ialah kandungan terperinci Panduan Komprehensif untuk Zephyr-7b: Ciri, Penggunaan, dan Penalaan Halus. Untuk maklumat lanjut, sila ikut artikel berkaitan lain di laman web China PHP!

Alat AI Hot

Undresser.AI Undress

Apl berkuasa AI untuk mencipta foto bogel yang realistik

AI Clothes Remover

Alat AI dalam talian untuk mengeluarkan pakaian daripada foto.

Undress AI Tool

Gambar buka pakaian secara percuma

Clothoff.io

Penyingkiran pakaian AI

Video Face Swap

Tukar muka dalam mana-mana video dengan mudah menggunakan alat tukar muka AI percuma kami!

Artikel Panas

Alat panas

Notepad++7.3.1

Editor kod yang mudah digunakan dan percuma

SublimeText3 versi Cina

Versi Cina, sangat mudah digunakan

Hantar Studio 13.0.1

Persekitaran pembangunan bersepadu PHP yang berkuasa

Dreamweaver CS6

Alat pembangunan web visual

SublimeText3 versi Mac

Perisian penyuntingan kod peringkat Tuhan (SublimeText3)

Topik panas

1674

1674

14

14

1429

1429

52

52

1333

1333

25

25

1278

1278

29

29

1257

1257

24

24

Bagaimana Membina Ejen AI Multimodal Menggunakan Rangka Kerja AGNO?

Apr 23, 2025 am 11:30 AM

Bagaimana Membina Ejen AI Multimodal Menggunakan Rangka Kerja AGNO?

Apr 23, 2025 am 11:30 AM

Semasa bekerja pada AIS AI, pemaju sering mendapati diri mereka menavigasi perdagangan antara kelajuan, fleksibiliti, dan kecekapan sumber. Saya telah meneroka rangka kerja AI yang agentik dan menjumpai Agno (sebelum ini adalah Phi-

Terbuka beralih fokus dengan GPT-4.1, mengutamakan pengekodan dan kecekapan kos

Apr 16, 2025 am 11:37 AM

Terbuka beralih fokus dengan GPT-4.1, mengutamakan pengekodan dan kecekapan kos

Apr 16, 2025 am 11:37 AM

Pelepasan ini termasuk tiga model yang berbeza, GPT-4.1, GPT-4.1 Mini dan GPT-4.1 Nano, menandakan langkah ke arah pengoptimuman khusus tugas dalam landskap model bahasa yang besar. Model-model ini tidak segera menggantikan antara muka yang dihadapi pengguna seperti

Bagaimana untuk menambah lajur dalam SQL? - Analytics Vidhya

Apr 17, 2025 am 11:43 AM

Bagaimana untuk menambah lajur dalam SQL? - Analytics Vidhya

Apr 17, 2025 am 11:43 AM

Pernyataan Jadual Alter SQL: Menambah lajur secara dinamik ke pangkalan data anda Dalam pengurusan data, kebolehsuaian SQL adalah penting. Perlu menyesuaikan struktur pangkalan data anda dengan cepat? Pernyataan Jadual ALTER adalah penyelesaian anda. Butiran panduan ini menambah colu

Kursus Pendek Baru mengenai Model Embedding oleh Andrew Ng

Apr 15, 2025 am 11:32 AM

Kursus Pendek Baru mengenai Model Embedding oleh Andrew Ng

Apr 15, 2025 am 11:32 AM

Buka kunci kekuatan model embedding: menyelam jauh ke kursus baru Andrew Ng Bayangkan masa depan di mana mesin memahami dan menjawab soalan anda dengan ketepatan yang sempurna. Ini bukan fiksyen sains; Terima kasih kepada kemajuan dalam AI, ia menjadi R

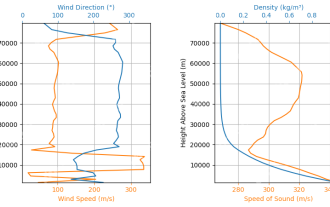

Simulasi dan analisis pelancaran roket menggunakan Rocketpy - Analytics Vidhya

Apr 19, 2025 am 11:12 AM

Simulasi dan analisis pelancaran roket menggunakan Rocketpy - Analytics Vidhya

Apr 19, 2025 am 11:12 AM

Simulasi Rocket dilancarkan dengan Rocketpy: Panduan Komprehensif Artikel ini membimbing anda melalui mensimulasikan pelancaran roket kuasa tinggi menggunakan Rocketpy, perpustakaan Python yang kuat. Kami akan merangkumi segala -galanya daripada menentukan komponen roket untuk menganalisis simula

Google melancarkan strategi ejen yang paling komprehensif di Cloud Seterusnya 2025

Apr 15, 2025 am 11:14 AM

Google melancarkan strategi ejen yang paling komprehensif di Cloud Seterusnya 2025

Apr 15, 2025 am 11:14 AM

Gemini sebagai asas strategi AI Google Gemini adalah asas kepada strategi ejen AI Google, memanfaatkan keupayaan multimodalnya untuk memproses dan menjana respons di seluruh teks, imej, audio, video dan kod. Dibangunkan oleh DeepM

Robot Humanoid Sumber Terbuka yang Anda Boleh Mencetak Diri 3D: Memeluk Wajah Membeli Robotik Debunga

Apr 15, 2025 am 11:25 AM

Robot Humanoid Sumber Terbuka yang Anda Boleh Mencetak Diri 3D: Memeluk Wajah Membeli Robotik Debunga

Apr 15, 2025 am 11:25 AM

"Super gembira untuk mengumumkan bahawa kami memperoleh robotik debunga untuk membawa robot sumber terbuka ke dunia," kata Hugging Face pada X. "Sejak Remi Cadene menyertai kami dari Tesla, kami telah menjadi platform perisian yang paling banyak digunakan untuk robot terbuka terima kasih

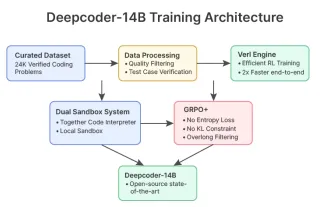

DeepCoder-14b: Pertandingan sumber terbuka untuk O3-Mini dan O1

Apr 26, 2025 am 09:07 AM

DeepCoder-14b: Pertandingan sumber terbuka untuk O3-Mini dan O1

Apr 26, 2025 am 09:07 AM

Dalam perkembangan penting bagi komuniti AI, Agentica dan bersama-sama AI telah mengeluarkan model pengekodan AI sumber terbuka bernama DeepCoder-14b. Menawarkan keupayaan penjanaan kod setanding dengan pesaing sumber tertutup seperti OpenAI