효율적인 네트워크 구조: EfficientNet

EfficientNet은 자동 모델 크기 조정 기능을 갖춘 효율적이고 확장 가능한 컨벌루션 신경망 구조입니다. 핵심 아이디어는 효율적인 기본 네트워크 구조를 기반으로 네트워크의 깊이, 너비, 해상도를 높여 모델의 성능을 향상시키는 것입니다. 네트워크 구조를 수동으로 조정하는 지루한 프로세스에 비해 이 방법은 모델의 효율성과 정확성을 향상시킬 뿐만 아니라 불필요한 작업을 방지합니다. 자동 모델 확장 방법을 통해 EfficientNet은 작업 요구 사항에 따라 네트워크 크기를 자동으로 조정할 수 있으므로 모델은 다양한 시나리오에서 더 나은 결과를 얻을 수 있습니다. 이는 EfficientNet을 컴퓨터 비전 분야의 다양한 작업에 널리 사용할 수 있는 매우 실용적인 신경망 구조로 만듭니다.

EfficientNet의 모델 구조는 깊이, 너비, 해상도의 세 가지 주요 구성 요소를 기반으로 합니다. 깊이는 네트워크의 레이어 수를 나타내고 너비는 각 레이어의 채널 수를 나타냅니다. 해상도는 입력 이미지의 크기를 나타냅니다. 이 세 가지 구성 요소의 균형을 유지함으로써 효율적이고 정확한 모델을 얻을 수 있습니다.

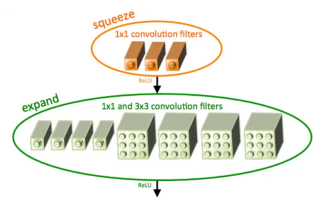

EfficientNet은 MBConv 블록이라는 경량 컨볼루션 블록을 기본 네트워크 구조로 채택합니다. MBConv 블록은 1x1 컨볼루션, 확장 가능한 깊이별 분리 가능 컨볼루션, 1x1 컨볼루션의 세 부분으로 구성됩니다. 1x1 컨볼루션은 주로 채널 수를 조정하는 데 사용되며 깊이 분리형 컨볼루션은 계산량과 매개 변수 수를 줄이기 위해 사용됩니다. 여러 개의 MBConv 블록을 쌓아서 효율적인 기본 네트워크 구조를 구축할 수 있습니다. 이 설계를 통해 EfficientNet은 고성능을 유지하면서 더 작은 모델 크기와 계산 복잡성을 가질 수 있습니다.

EfficientNet에서 모델 스케일링 방법은 두 가지 주요 단계로 나눌 수 있습니다. 첫째, 네트워크의 깊이, 너비, 해상도를 증가시켜 기본 네트워크 구조를 개선합니다. 둘째, 복합 배율 인수를 사용하여 세 가지 구성 요소의 균형을 맞춥니다. 이러한 복합 스케일링 인자에는 깊이 스케일링 인자, 너비 스케일링 인자 및 해상도 스케일링 인자가 포함됩니다. 이러한 스케일링 계수는 복합 함수를 통해 결합되어 모델 구조를 조정하는 데 사용되는 최종 스케일링 계수를 얻습니다. 이러한 방식으로 EfficientNet은 모델 성능을 유지하면서 모델 효율성과 정확성을 향상시킬 수 있습니다.

EfficientNet 모델은 크기에 따라 EfficientNetB{N}으로 표현될 수 있습니다. 여기서 N은 모델의 규모를 나타내는 데 사용되는 정수입니다. 모델 크기와 성능 사이에는 양의 상관관계가 있습니다. 즉, 모델이 클수록 성능이 더 좋습니다. 그러나 모델 크기가 증가함에 따라 계산 및 저장 비용도 그에 따라 증가합니다. 현재 EfficientNet은 B0에서 B7까지 다양한 크기의 7가지 모델을 제공합니다. 사용자는 특정 작업 요구 사항에 따라 적절한 모델 크기를 선택할 수 있습니다.

EfficientNet은 기본 네트워크 구조 외에도 모델 성능을 향상시키기 위해 몇 가지 다른 기술을 사용합니다. 그 중 가장 중요한 것은 일반적으로 사용되는 ReLU 활성화 함수보다 성능이 더 좋은 Swish 활성화 함수입니다. 또한 EfficientNet은 DropConnect 기술을 사용하여 과적합을 방지하고 표준화 기술을 사용하여 모델의 안정성을 향상시킵니다.

위 내용은 효율적인 네트워크 구조: EfficientNet의 상세 내용입니다. 자세한 내용은 PHP 중국어 웹사이트의 기타 관련 기사를 참조하세요!

핫 AI 도구

Undresser.AI Undress

사실적인 누드 사진을 만들기 위한 AI 기반 앱

AI Clothes Remover

사진에서 옷을 제거하는 온라인 AI 도구입니다.

Undress AI Tool

무료로 이미지를 벗다

Clothoff.io

AI 옷 제거제

Video Face Swap

완전히 무료인 AI 얼굴 교환 도구를 사용하여 모든 비디오의 얼굴을 쉽게 바꾸세요!

인기 기사

뜨거운 도구

메모장++7.3.1

사용하기 쉬운 무료 코드 편집기

SublimeText3 중국어 버전

중국어 버전, 사용하기 매우 쉽습니다.

스튜디오 13.0.1 보내기

강력한 PHP 통합 개발 환경

드림위버 CS6

시각적 웹 개발 도구

SublimeText3 Mac 버전

신 수준의 코드 편집 소프트웨어(SublimeText3)

RNN, LSTM 및 GRU의 개념, 차이점, 장점 및 단점을 살펴보세요.

Jan 22, 2024 pm 07:51 PM

RNN, LSTM 및 GRU의 개념, 차이점, 장점 및 단점을 살펴보세요.

Jan 22, 2024 pm 07:51 PM

시계열 데이터에서는 관측값 간에 종속성이 있으므로 서로 독립적이지 않습니다. 그러나 기존 신경망은 각 관측값을 독립적인 것으로 취급하므로 시계열 데이터를 모델링하는 모델의 기능이 제한됩니다. 이 문제를 해결하기 위해 네트워크의 데이터 포인트 간의 종속성을 설정하여 시계열 데이터의 동적 특성을 캡처하는 메모리 개념을 도입한 RNN(Recurrent Neural Network)이 도입되었습니다. RNN은 반복 연결을 통해 이전 정보를 현재 관찰에 전달하여 미래 값을 더 잘 예측할 수 있습니다. 이는 RNN을 시계열 데이터와 관련된 작업을 위한 강력한 도구로 만듭니다. 그러나 RNN은 어떻게 이런 종류의 메모리를 달성합니까? RNN은 신경망의 피드백 루프를 통해 메모리를 구현합니다. 이것이 RNN과 기존 신경망의 차이점입니다.

신경망의 FLOPS(부동 소수점 피연산자) 계산

Jan 22, 2024 pm 07:21 PM

신경망의 FLOPS(부동 소수점 피연산자) 계산

Jan 22, 2024 pm 07:21 PM

FLOPS는 컴퓨터 성능 평가 표준 중 하나로 초당 부동 소수점 연산 횟수를 측정하는 데 사용됩니다. 신경망에서 FLOPS는 모델의 계산 복잡성과 컴퓨팅 리소스 활용도를 평가하는 데 자주 사용됩니다. 컴퓨터의 컴퓨팅 성능과 효율성을 측정하는 데 사용되는 중요한 지표입니다. 신경망은 데이터 분류, 회귀, 클러스터링과 같은 작업을 수행하는 데 사용되는 여러 계층의 뉴런으로 구성된 복잡한 모델입니다. 신경망의 훈련 및 추론에는 수많은 행렬 곱셈, 컨볼루션 및 기타 계산 작업이 필요하므로 계산 복잡성이 매우 높습니다. FLOPS(FloatingPointOperationsperSecond)는 신경망의 계산 복잡성을 측정하여 모델의 계산 리소스 사용 효율성을 평가하는 데 사용할 수 있습니다. 실패

텍스트 분류를 위한 양방향 LSTM 모델 사용 사례 연구

Jan 24, 2024 am 10:36 AM

텍스트 분류를 위한 양방향 LSTM 모델 사용 사례 연구

Jan 24, 2024 am 10:36 AM

양방향 LSTM 모델은 텍스트 분류에 사용되는 신경망입니다. 다음은 텍스트 분류 작업에 양방향 LSTM을 사용하는 방법을 보여주는 간단한 예입니다. 먼저 필요한 라이브러리와 모듈을 가져와야 합니다. importosimportnumpyasnpfromkeras.preprocessing.textimportTokenizerfromkeras.preprocessing.sequenceimportpad_sequencesfromkeras.modelsimportSequentialfromkeras.layersimportDense,Em

SqueezeNet 소개 및 특징

Jan 22, 2024 pm 07:15 PM

SqueezeNet 소개 및 특징

Jan 22, 2024 pm 07:15 PM

SqueezeNet은 높은 정확도와 낮은 복잡성 사이의 적절한 균형을 유지하는 작고 정밀한 알고리즘으로, 리소스가 제한된 모바일 및 임베디드 시스템에 이상적입니다. 2016년 DeepScale, University of California, Berkeley 및 Stanford University의 연구원들은 작고 효율적인 CNN(컨볼루션 신경망)인 SqueezeNet을 제안했습니다. 최근 몇 년 동안 연구원들은 SqueezeNetv1.1 및 SqueezeNetv2.0을 포함하여 SqueezeNet에 대한 몇 가지 개선 사항을 적용했습니다. 두 버전 모두의 개선으로 정확도가 향상될 뿐만 아니라 계산 비용도 절감됩니다. ImageNet 데이터 세트에서 SqueezeNetv1.1의 정확도

확장된 컨볼루션과 아트러스 컨볼루션의 유사점, 차이점 및 관계를 비교합니다.

Jan 22, 2024 pm 10:27 PM

확장된 컨볼루션과 아트러스 컨볼루션의 유사점, 차이점 및 관계를 비교합니다.

Jan 22, 2024 pm 10:27 PM

Dilated Convolution과 Dilated Convolution은 Convolutional Neural Network에서 일반적으로 사용되는 작업입니다. 이 기사에서는 차이점과 관계를 자세히 소개합니다. 1. 확장 컨볼루션 확장 컨볼루션 또는 확장 컨볼루션이라고도 알려진 확장 컨볼루션은 컨볼루션 신경망의 작업입니다. 전통적인 컨볼루션 연산을 기반으로 한 확장으로 컨볼루션 커널에 홀을 삽입하여 컨볼루션 커널의 수용 필드를 늘립니다. 이러한 방식으로 네트워크는 더 넓은 범위의 기능을 더 잘 포착할 수 있습니다. Dilated Convolution은 이미지 처리 분야에서 널리 사용되며 매개변수 수와 계산량을 늘리지 않고도 네트워크 성능을 향상시킬 수 있습니다. 확장된 컨볼루션은 컨볼루션 커널의 수용 필드를 확장함으로써 이미지의 전역 정보를 더 잘 처리할 수 있으므로 특징 추출 효과가 향상됩니다. 확장 컨볼루션의 주요 아이디어는 다음과 같은 몇 가지를 도입하는 것입니다.

트윈 신경망: 원리 및 응용 분석

Jan 24, 2024 pm 04:18 PM

트윈 신경망: 원리 및 응용 분석

Jan 24, 2024 pm 04:18 PM

Siamese Neural Network는 독특한 인공 신경망 구조입니다. 이는 동일한 매개변수와 가중치를 공유하는 두 개의 동일한 신경망으로 구성됩니다. 동시에 두 네트워크는 동일한 입력 데이터도 공유합니다. 이 디자인은 두 개의 신경망이 구조적으로 동일하기 때문에 쌍둥이에서 영감을 받았습니다. 샴 신경망의 원리는 두 입력 데이터 간의 유사성이나 거리를 비교하여 이미지 매칭, 텍스트 매칭, 얼굴 인식 등의 특정 작업을 완료하는 것입니다. 훈련 중에 네트워크는 유사한 데이터를 인접한 지역에 매핑하고 서로 다른 데이터를 먼 지역에 매핑하려고 시도합니다. 이러한 방식으로 네트워크는 서로 다른 데이터를 분류하거나 일치시키는 방법을 학습하여 해당 데이터를 달성할 수 있습니다.

컨벌루션 신경망을 사용한 이미지 노이즈 제거

Jan 23, 2024 pm 11:48 PM

컨벌루션 신경망을 사용한 이미지 노이즈 제거

Jan 23, 2024 pm 11:48 PM

컨벌루션 신경망은 이미지 노이즈 제거 작업에서 좋은 성능을 발휘합니다. 학습된 필터를 활용하여 노이즈를 필터링하고 원본 이미지를 복원합니다. 본 논문에서는 컨볼루셔널 신경망을 기반으로 한 이미지 노이즈 제거 방법을 자세히 소개합니다. 1. 합성곱 신경망 개요 합성곱 신경망은 다중 합성곱 레이어, 풀링 레이어 및 완전 연결 레이어의 조합을 사용하여 이미지 특징을 학습하고 분류하는 딥러닝 알고리즘입니다. 컨볼루션 레이어에서는 컨볼루션 연산을 통해 이미지의 국소적 특징을 추출하여 이미지의 공간적 상관관계를 포착합니다. 풀링 레이어는 특징 차원을 줄여 계산량을 줄이고 주요 특징을 유지합니다. 완전 연결 계층은 학습된 특징과 레이블을 매핑하여 이미지 분류 또는 기타 작업을 구현하는 역할을 합니다. 이 네트워크 구조의 설계는 컨볼루션 신경망을 이미지 처리 및 인식에 유용하게 만듭니다.

인과 컨벌루션 신경망

Jan 24, 2024 pm 12:42 PM

인과 컨벌루션 신경망

Jan 24, 2024 pm 12:42 PM

인과 컨벌루션 신경망(Causal Convolutional Neural Network)은 시계열 데이터의 인과성 문제를 위해 설계된 특수 컨벌루션 신경망입니다. 기존 합성곱 신경망과 비교하여 인과 합성곱 신경망은 시계열의 인과 관계를 유지하는 데 고유한 장점이 있으며 시계열 데이터의 예측 및 분석에 널리 사용됩니다. 인과 컨볼루션 신경망의 핵심 아이디어는 컨볼루션 연산에 인과성을 도입하는 것입니다. 기존 컨벌루션 신경망은 현재 시점 이전과 이후의 데이터를 동시에 인식할 수 있지만, 시계열 예측에서는 이로 인해 정보 유출 문제가 발생할 수 있습니다. 왜냐하면 현재 시점의 예측 결과는 미래 시점의 데이터에 의해 영향을 받기 때문입니다. 인과 컨벌루션 신경망은 이 문제를 해결합니다. 현재 시점과 이전 데이터만 인식할 수 있지만 미래 데이터는 인식할 수 없습니다.