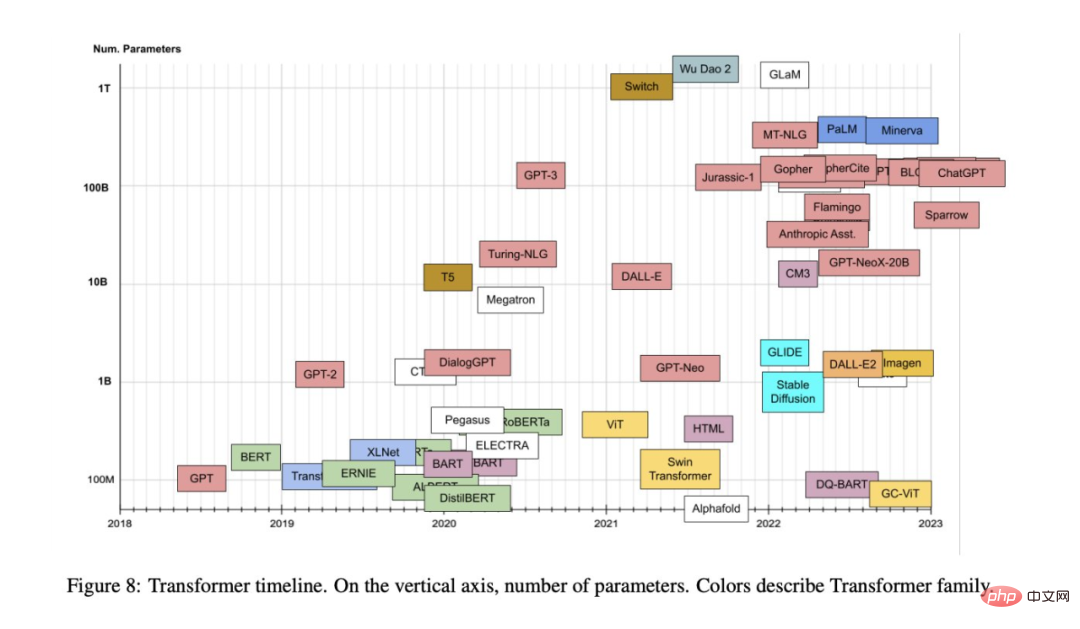

5 年間で 38,000 回引用され、トランスフォーマー ユニバースはこのように発展しました

2017 年に提案されて以来、Transformer モデルは、自然言語処理やコンピューター ビジョンなどの他の分野で前例のない強みを示し、ChatGPT などの技術的ブレークスルーを引き起こしました。人々はまた、さまざまなオリジナル ベースのバリアントも提案してきました。モデル。

学術界と産業界が Transformer の注目メカニズムに基づいた新しいモデルを提案し続ける中、この方向性を要約することが難しい場合があります。最近、LinkedIn の AI 製品戦略責任者である Xavier Amatriain による包括的な記事が、この問題の解決に役立つ可能性があります。

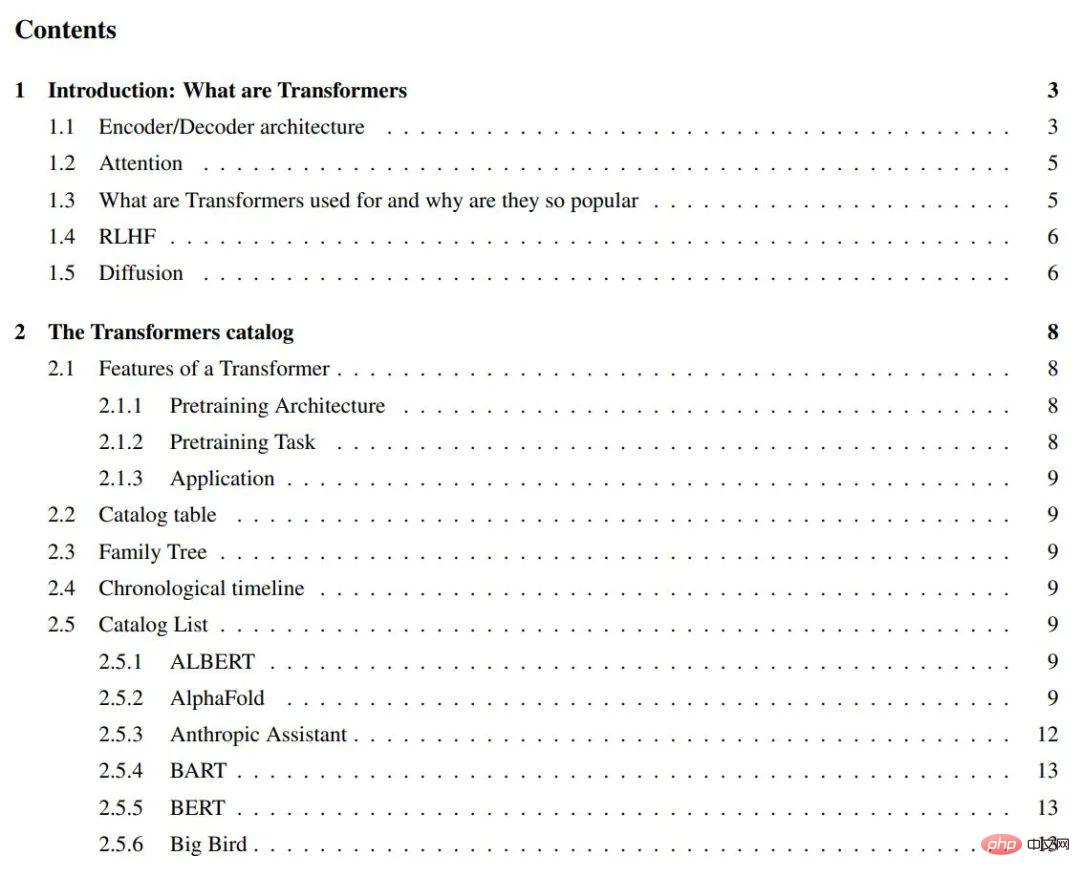

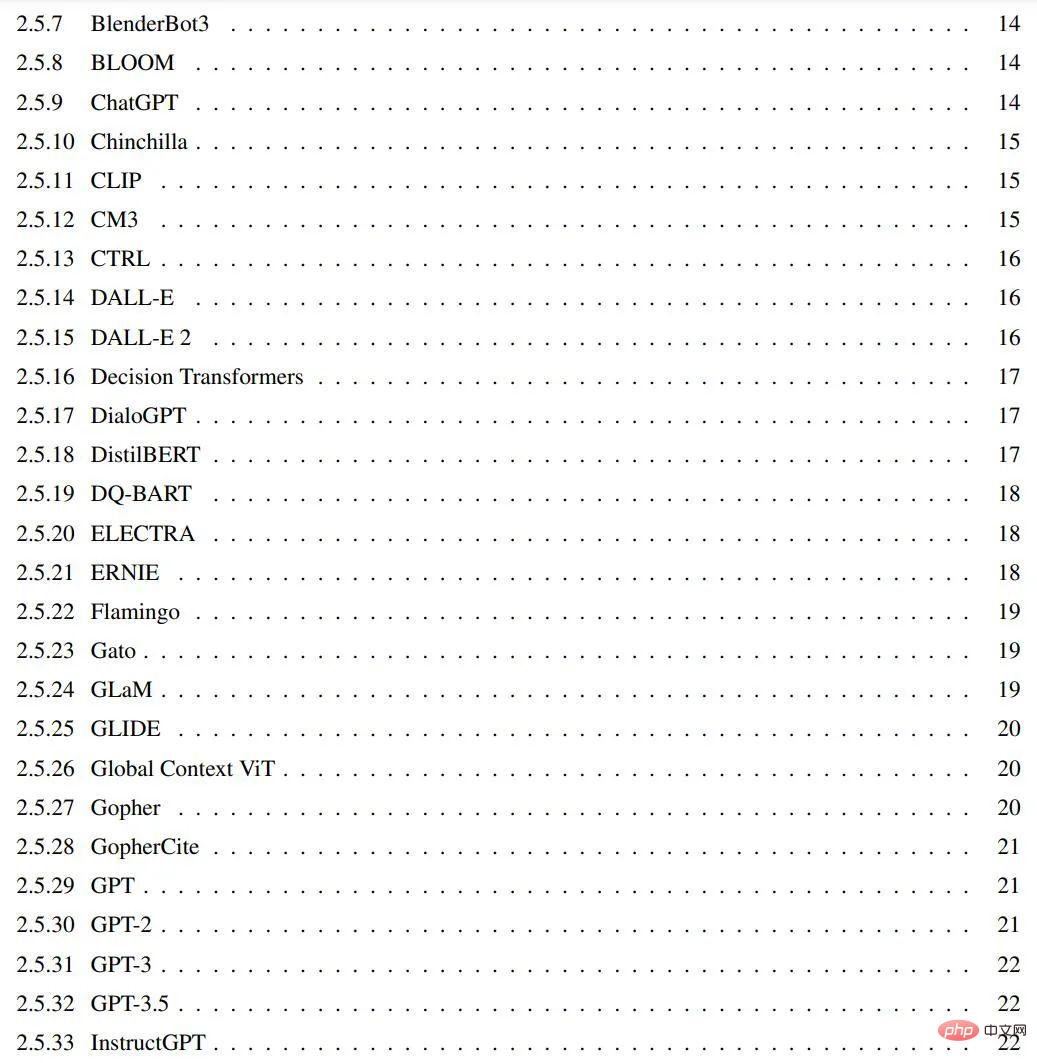

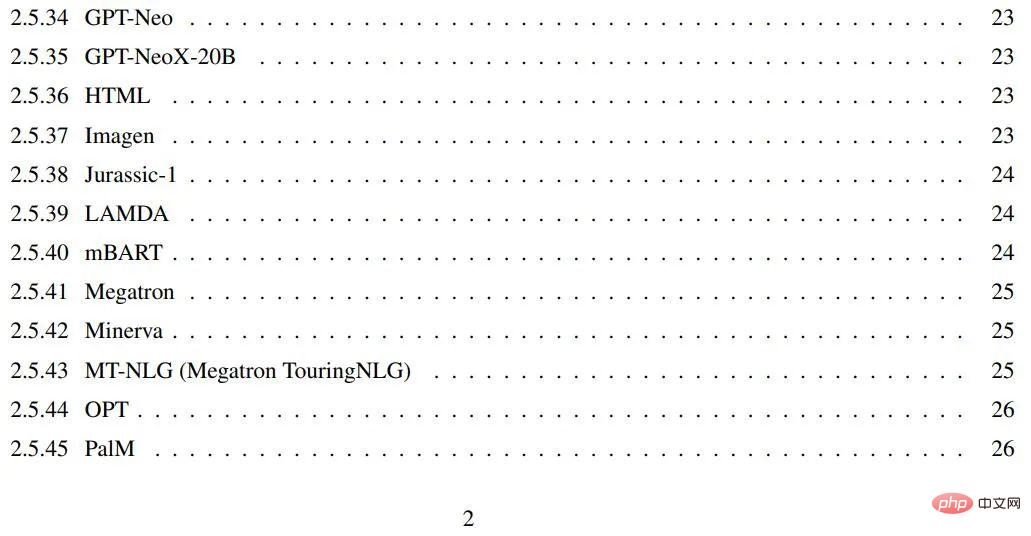

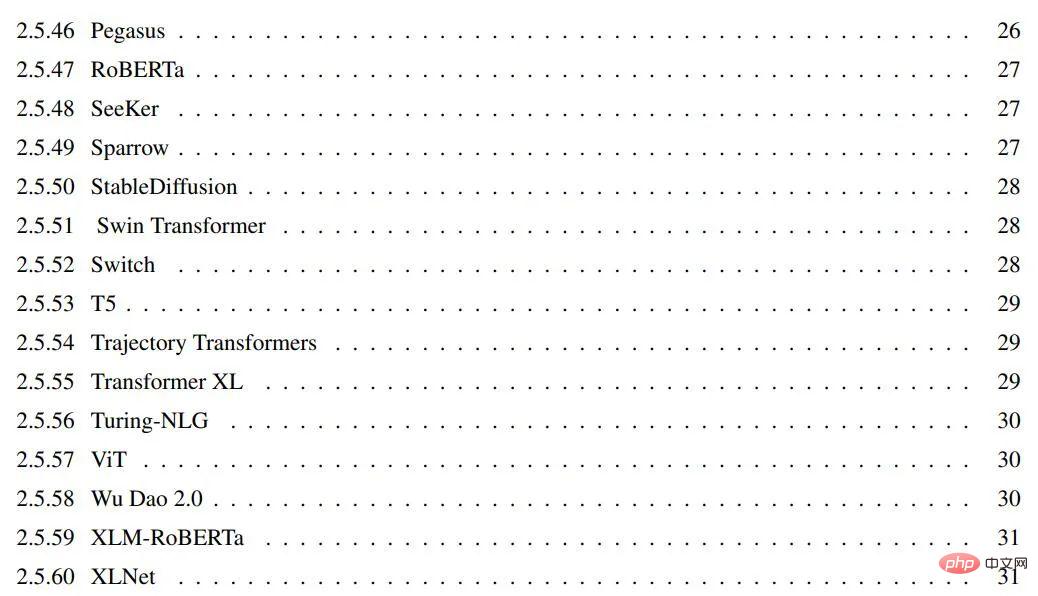

#ここ数年、次々とTransformer ファミリーには多数のモデルがあり、すべて興味深くわかりやすい名前が付けられています。この記事の目的は、最も人気のある Transformer モデルの包括的かつシンプルなカタログと分類を提供することです。さらに、この記事では、Transformer モデルの最も重要な側面と革新についても紹介します。

#論文「変圧器モデル: 概要とカタログ」:

##紙のリンク:

## https://arxiv.org/abs/2302.07730#GitHub: https://github.com/xamat/TransformerCatalog

はじめに: Transformer とは

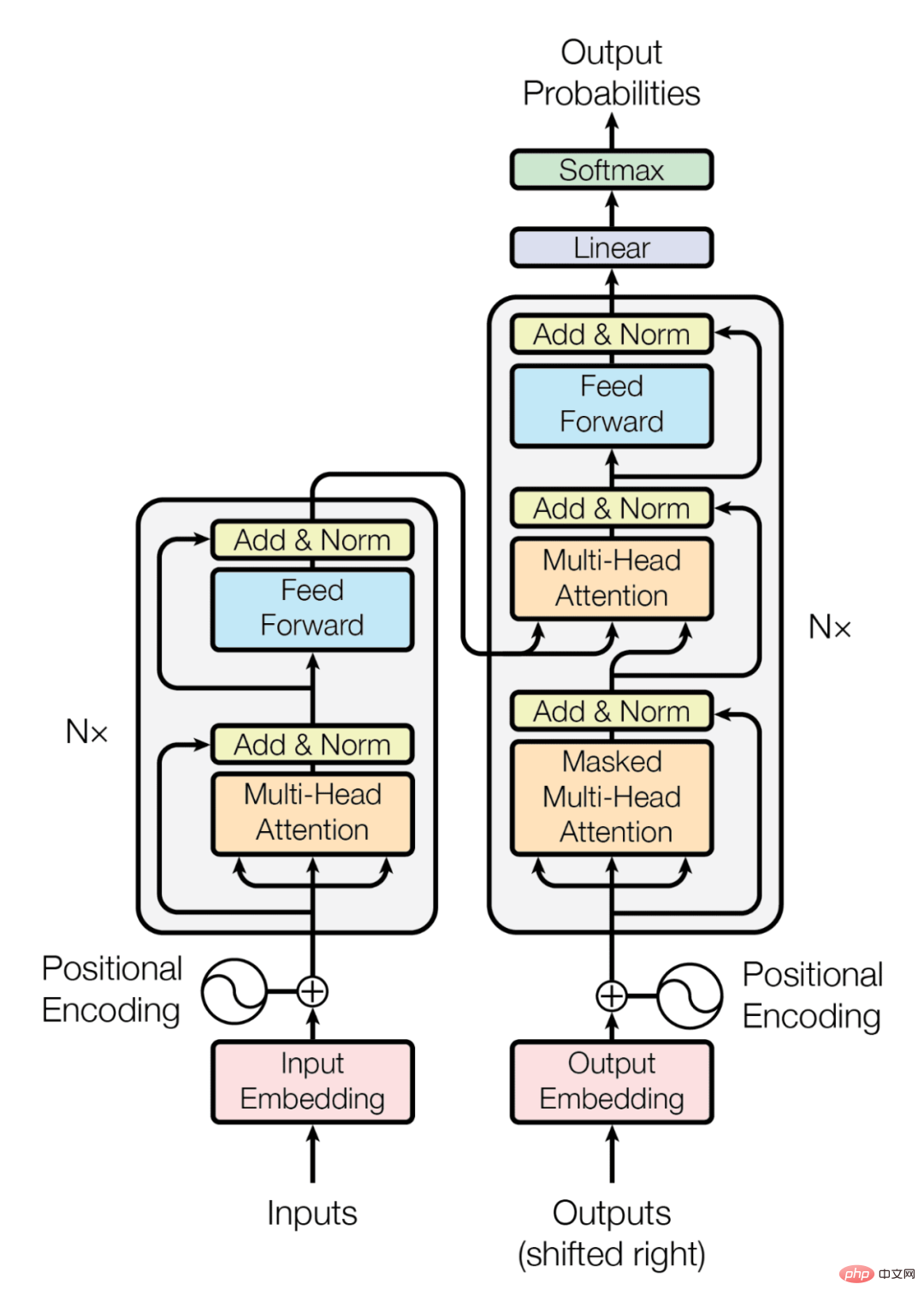

Transformer は、次のもので構成されるクラスです。アーキテクチャ上の特徴によって定義される深層学習モデル。最初に登場したのは、2017 年に Google 研究者によって発表された有名な論文「Attending is All you Need」(この論文はわずか 5 年間で 38,000 回以上引用されています)および関連するブログ投稿です。 Transformer アーキテクチャは、2 ~ 3 年前に普及したエンコーダ/デコーダ モデル [2] の特定のインスタンスです。しかし、それまでは、主に LSTM (Long Short-Term Memory) [3] やその他の RNN (Recurrent Neural Network) [4] の亜種に基づいたこれらのモデルで使用されるメカニズムの 1 つだけが注目されていました。 Transformers の論文の重要な洞察は、タイトルが示すように、入力と出力の間の依存関係を導き出す唯一のメカニズムとして注意を使用できるということです。 Transformer アーキテクチャの詳細をすべて説明することは、このブログの範囲を超えています。この目的のために、この記事では上記の元の論文またはトランスフォーマーの投稿を参照することをお勧めします。どちらも非常に興味深いものです。そうは言っても、この記事では最も重要な点について簡単に説明し、以下の目次にも記載します。この記事では、元の論文の基本的なアーキテクチャ図から始めて、関連する内容を展開していきます。エンコーダ/デコーダ アーキテクチャ

ユニバーサル エンコーダ/デコーダ アーキテクチャ (図 1 を参照) 2 つのモデルで構成されます。エンコーダーは入力を受け取り、それを固定長ベクトルにエンコードします。デコーダはこのベクトルを受け取り、出力シーケンスにデコードします。エンコーダーとデコーダーは、条件付き対数尤度を最小化するように共同でトレーニングされます。トレーニングが完了すると、エンコーダー/デコーダーは入力シーケンスを指定して出力を生成したり、入力/出力シーケンスをスコアリングしたりできます。オリジナルの Transformer アーキテクチャでは、エンコーダーとデコーダーの両方に 6 つの同一のレイヤーがありました。これら 6 つのレイヤーの各エンコーダーには、マルチヘッド アテンション レイヤーと単純なフィードフォワード ネットワークという 2 つのサブレイヤーがあります。各サブレイヤーには残留接続とレイヤー正規化があります。エンコーダーの出力サイズは 512 です。デコーダは、エンコーダ出力上の別のマルチヘッド アテンション レイヤである 3 番目のサブレイヤを追加します。さらに、デコーダ内の別のマルチヘッド層がマスクされます。

#図 2: アテンションのメカニズム

##アテンション

上記の説明から、モデル アーキテクチャの唯一の特別な要素はマルチヘッド アテンションであることは明らかですが、前述したように、ここにモデルの最大の力があります。では、注意とは具体的に何でしょうか?アテンション関数は、クエリと一連のキーと値のペア間の出力へのマッピングです。出力は値の重み付き合計として計算されます。各値に割り当てられた重みは、対応するキーとのクエリの互換性関数によって計算されます。トランスフォーマーは、スケーリングされたドット積アテンションと呼ばれる特定のアテンション関数の並列計算であるマルチヘッド アテンションを使用します。アテンション メカニズムがどのように機能するかについて詳しくは、この記事でも「The Illustrated Transformer」の記事を参照し、主な概念を理解するために元の論文の図を図 2 に再掲します。アテンション層には、リカレント ネットワークや畳み込みネットワークに比べていくつかの利点があります。最も重要な 2 つは、計算の複雑さが低いことと接続性が高いことであり、シーケンス内の長期的な依存関係を学習するのに特に役立ちます。

Transformer の用途と人気の理由

元の Transformer は言語翻訳用に設計されました。特に英語からドイツ語まで。ただし、元の研究論文からわかるように、このアーキテクチャは他の言語タスクにもよく一般化します。この特定の傾向はすぐに研究コミュニティの注目を集めました。その後の数か月間で、ほとんどの言語関連の ML タスクのランキングは、Transformer アーキテクチャの一部のバージョンによって完全に独占されました (たとえば、有名な SQUAD ランキングでは、すべての上位モデルが Transformer のコレクションになっています)。 Transformers がほとんどの NLP ランキングを急速に独占した主な理由の 1 つは、トランスフォーマーが他のタスクに素早く適応する能力 (別名転移学習) です。事前トレーニング済みの Transformer モデルは、トレーニングされていないタスクに非常に簡単かつ迅速に適応させることができ、これには大きな利点があります。 ML 実践者は、巨大なデータセットで大規模なモデルをトレーニングする必要がなくなりました。必要なのは、事前トレーニングされたモデルをタスクで再利用することだけです。場合によっては、はるかに小さいデータセットを使用してわずかに調整するだけです。事前トレーニングされたモデルをさまざまなタスクに適応させるために使用される特定の手法の 1 つは、微調整と呼ばれます。トランスフォーマーは他のタスクにも適応できることが証明されたため、元々は言語関連のタスク用に開発されましたが、ビジュアル、オーディオ、音楽アプリケーションに至るまで、他のタスクにもすぐに採用されました。チェスをしたり、数学をしたりする方法。

もちろん、誰でも簡単に数行のコードを記述できる無数のツールがなければ、これらのアプリケーションはいずれも実現できません。 Transformer は、主要な人工知能フレームワーク (Pytorch8 や TF9 など) に迅速に統合できるだけでなく、企業全体をこれに基づいて構築することもできます。これまでに 6,000 万ドル以上を調達したスタートアップ企業、Huggingface は、オープンソースの Transformer ライブラリを商用化するというアイデアをほぼ全面的に中心に構築されました。

最後に、人気の初期段階における Transformer に対する GPT-3 の影響について話す必要があります。 GPT-3 は、2020 年 5 月に OpenAI によって発売された Transformer モデルであり、以前の GPT および GPT-2 のフォローアップです。同社はこのモデルをプレプリントで紹介することで多くの話題を呼びましたが、そのモデルは非常に強力であるため世界にリリースできないと主張していました。それ以来、このモデルはリリースされただけでなく、OpenAI と Microsoft との大規模なコラボレーションを通じて商品化されました。 GPT-3 は 300 以上の異なるアプリケーションをサポートしており、OpenAI のビジネス戦略の基礎となっています (これは 10 億ドルを超える資金を調達した企業にとって当然のことです)。

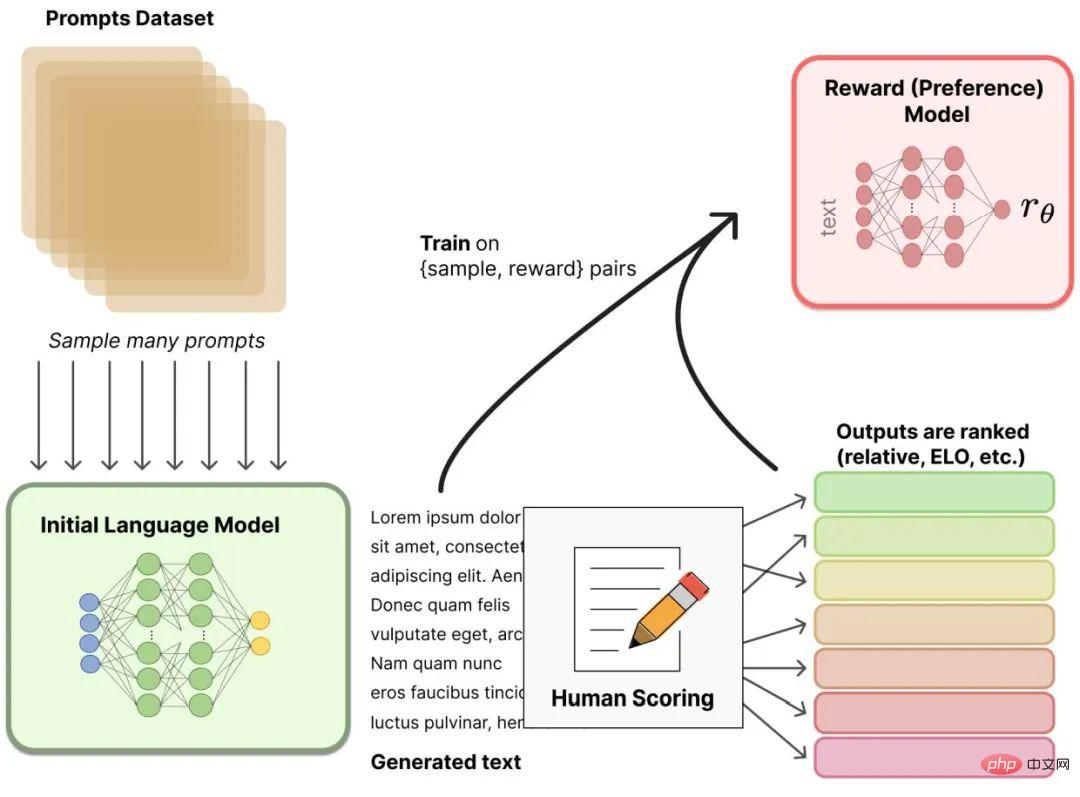

RLHF

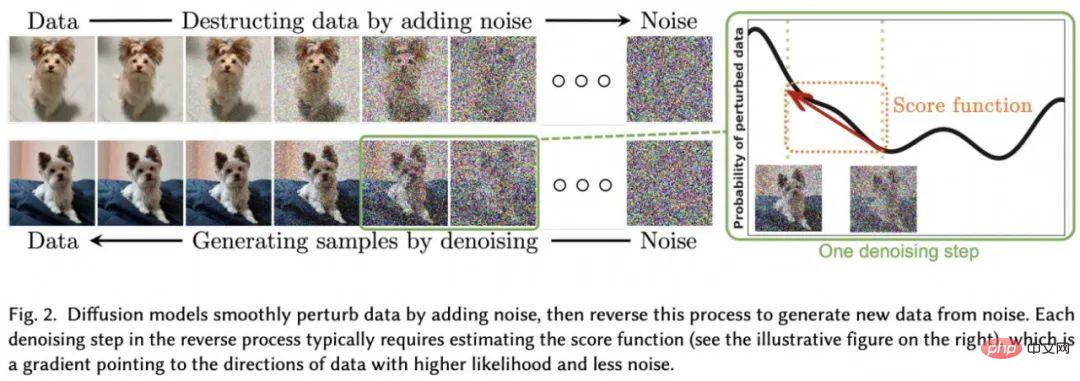

最近、人間のフィードバック (または好み) からの強化学習 (RLHF (RLHP とも呼ばれる)) ) は、人工知能ツールキットへの大きな追加となっています。この概念は、2017 年の論文「人間の好みからの深層強化学習」ですでに提案されています。さらに最近では、ChatGPT や、BlenderBot や Sparrow などの同様の会話型エージェントに適用されています。アイデアは単純です: 言語モデルが事前にトレーニングされると、ユーザーは会話に対してさまざまな応答を生成し、その結果を人間がランク付けできます。強化学習環境でこれらのランキング (別名好みまたはフィードバック) を使用して、報酬をトレーニングできます (図 3 を参照) )。###############拡散#########拡散モデルは画像生成における新しい SOTA となり、明らかに GAN (敵対的生成ネットワーク) などの以前の方法を押しのけています。普及モデルとは何ですか?これらは、変分推論でトレーニングされた潜在変数モデルのクラスです。この方法でトレーニングされたネットワークは、実際にこれらの画像によって表される潜在空間を学習します (図 4 を参照)。

拡散モデルは、有名な [敵対的生成ネットワーク (GAN)] 16 などの他の生成モデルに関連しており、多くのアプリケーション、特に (ノイズ除去) オートエンコーダーで置き換えられています。著者の中には、拡散モデルはオートエンコーダの特定のインスタンスにすぎないとさえ言う人もいます。しかし、彼らはまた、小さな違いによって、その応用がオートコンダーの基礎的な表現から拡散モデルの純粋に生成的な性質に変わることも認めています。

# 図 3: 人間のフィードバックによる強化学習。

図 4: 「拡散モデル」から抜粋した確率的拡散モデルのアーキテクチャ" : メソッドとアプリケーションの包括的な調査》

この記事で紹介されているモデルは次のとおりです:

以上が5 年間で 38,000 回引用され、トランスフォーマー ユニバースはこのように発展しましたの詳細内容です。詳細については、PHP 中国語 Web サイトの他の関連記事を参照してください。

ホットAIツール

Undresser.AI Undress

リアルなヌード写真を作成する AI 搭載アプリ

AI Clothes Remover

写真から衣服を削除するオンライン AI ツール。

Undress AI Tool

脱衣画像を無料で

Clothoff.io

AI衣類リムーバー

Video Face Swap

完全無料の AI 顔交換ツールを使用して、あらゆるビデオの顔を簡単に交換できます。

人気の記事

ホットツール

メモ帳++7.3.1

使いやすく無料のコードエディター

SublimeText3 中国語版

中国語版、とても使いやすい

ゼンドスタジオ 13.0.1

強力な PHP 統合開発環境

ドリームウィーバー CS6

ビジュアル Web 開発ツール

SublimeText3 Mac版

神レベルのコード編集ソフト(SublimeText3)

ホットトピック

1664

1664

14

14

1421

1421

52

52

1315

1315

25

25

1266

1266

29

29

1239

1239

24

24

世界で最も強力なオープンソース MoE モデルが登場。GPT-4 に匹敵する中国語機能を備え、価格は GPT-4-Turbo のわずか 1% 近くです

May 07, 2024 pm 04:13 PM

世界で最も強力なオープンソース MoE モデルが登場。GPT-4 に匹敵する中国語機能を備え、価格は GPT-4-Turbo のわずか 1% 近くです

May 07, 2024 pm 04:13 PM

従来のコンピューティングを超える能力を備えているだけでなく、より低コストでより効率的なパフォーマンスを実現する人工知能モデルを想像してみてください。これは SF ではありません。世界で最も強力なオープンソース MoE モデルである DeepSeek-V2[1] が登場しました。 DeepSeek-V2 は、経済的なトレーニングと効率的な推論の特徴を備えた強力な専門家混合 (MoE) 言語モデルです。これは 236B のパラメータで構成されており、そのうち 21B は各マーカーをアクティブにするために使用されます。 DeepSeek67B と比較して、DeepSeek-V2 はパフォーマンスが優れていると同時に、トレーニング コストを 42.5% 節約し、KV キャッシュを 93.3% 削減し、最大生成スループットを 5.76 倍に高めます。 DeepSeek は一般的な人工知能を研究する会社です

AI が数学研究を破壊する!フィールズ賞受賞者で中国系アメリカ人の数学者が上位 11 件の論文を主導 | テレンス・タオが「いいね!」しました

Apr 09, 2024 am 11:52 AM

AI が数学研究を破壊する!フィールズ賞受賞者で中国系アメリカ人の数学者が上位 11 件の論文を主導 | テレンス・タオが「いいね!」しました

Apr 09, 2024 am 11:52 AM

AI は確かに数学を変えつつあります。最近、この問題に細心の注意を払っている陶哲軒氏が『米国数学協会会報』(米国数学協会会報)の最新号を送ってくれた。 「機械は数学を変えるのか?」というテーマを中心に、多くの数学者が意見を述べ、そのプロセス全体は火花に満ち、ハードコアで刺激的でした。著者には、フィールズ賞受賞者のアクシャイ・ベンカテシュ氏、中国の数学者鄭楽軍氏、ニューヨーク大学のコンピューター科学者アーネスト・デイビス氏、その他業界で著名な学者を含む強力な顔ぶれが揃っている。 AI の世界は劇的に変化しています。これらの記事の多くは 1 年前に投稿されたものです。

Google は大喜び: JAX のパフォーマンスが Pytorch や TensorFlow を上回りました! GPU 推論トレーニングの最速の選択肢となる可能性があります

Apr 01, 2024 pm 07:46 PM

Google は大喜び: JAX のパフォーマンスが Pytorch や TensorFlow を上回りました! GPU 推論トレーニングの最速の選択肢となる可能性があります

Apr 01, 2024 pm 07:46 PM

Google が推進する JAX のパフォーマンスは、最近のベンチマーク テストで Pytorch や TensorFlow のパフォーマンスを上回り、7 つの指標で 1 位にランクされました。また、テストは最高の JAX パフォーマンスを備えた TPU では行われませんでした。ただし、開発者の間では、依然として Tensorflow よりも Pytorch の方が人気があります。しかし、将来的には、おそらくより大規模なモデルが JAX プラットフォームに基づいてトレーニングされ、実行されるようになるでしょう。モデル 最近、Keras チームは、ネイティブ PyTorch 実装を使用して 3 つのバックエンド (TensorFlow、JAX、PyTorch) をベンチマークし、TensorFlow を使用して Keras2 をベンチマークしました。まず、主流のセットを選択します

こんにちは、電気アトラスです!ボストン・ダイナミクスのロボットが復活、180度の奇妙な動きにマスク氏も恐怖

Apr 18, 2024 pm 07:58 PM

こんにちは、電気アトラスです!ボストン・ダイナミクスのロボットが復活、180度の奇妙な動きにマスク氏も恐怖

Apr 18, 2024 pm 07:58 PM

Boston Dynamics Atlas は正式に電動ロボットの時代に突入します!昨日、油圧式アトラスが歴史の舞台から「涙ながらに」撤退したばかりですが、今日、ボストン・ダイナミクスは電動式アトラスが稼働することを発表しました。ボストン・ダイナミクス社は商用人型ロボットの分野でテスラ社と競争する決意を持っているようだ。新しいビデオが公開されてから、わずか 10 時間ですでに 100 万人以上が視聴しました。古い人が去り、新しい役割が現れるのは歴史的な必然です。今年が人型ロボットの爆発的な年であることは間違いありません。ネットユーザーは「ロボットの進歩により、今年の開会式は人間のように見え、人間よりもはるかに自由度が高い。しかし、これは本当にホラー映画ではないのか?」とコメントした。ビデオの冒頭では、アトラスは仰向けに見えるように地面に静かに横たわっています。次に続くのは驚くべきことです

MLP に代わる KAN は、オープンソース プロジェクトによって畳み込みまで拡張されました

Jun 01, 2024 pm 10:03 PM

MLP に代わる KAN は、オープンソース プロジェクトによって畳み込みまで拡張されました

Jun 01, 2024 pm 10:03 PM

今月初め、MIT やその他の機関の研究者らは、MLP に代わる非常に有望な代替案である KAN を提案しました。 KAN は、精度と解釈可能性の点で MLP よりも優れています。また、非常に少数のパラメーターを使用して、多数のパラメーターを使用して実行する MLP よりも優れたパフォーマンスを発揮できます。たとえば、著者らは、KAN を使用して、より小規模なネットワークと高度な自動化で DeepMind の結果を再現したと述べています。具体的には、DeepMind の MLP には約 300,000 個のパラメーターがありますが、KAN には約 200 個のパラメーターしかありません。 KAN は、MLP が普遍近似定理に基づいているのに対し、KAN はコルモゴロフ-アーノルド表現定理に基づいているのと同様に、強力な数学的基礎を持っています。以下の図に示すように、KAN は

テスラのロボットは工場で働く、マスク氏:手の自由度は今年22に達する!

May 06, 2024 pm 04:13 PM

テスラのロボットは工場で働く、マスク氏:手の自由度は今年22に達する!

May 06, 2024 pm 04:13 PM

テスラのロボット「オプティマス」の最新映像が公開され、すでに工場内で稼働可能となっている。通常の速度では、バッテリー(テスラの4680バッテリー)を次のように分類します:公式は、20倍の速度でどのように見えるかも公開しました - 小さな「ワークステーション」上で、ピッキング、ピッキング、ピッキング:今回は、それがリリースされたハイライトの1つビデオの内容は、オプティマスが工場内でこの作業を完全に自律的に行い、プロセス全体を通じて人間の介入なしに完了するというものです。そして、オプティマスの観点から見ると、自動エラー修正に重点を置いて、曲がったバッテリーを拾い上げたり配置したりすることもできます。オプティマスのハンドについては、NVIDIA の科学者ジム ファン氏が高く評価しました。オプティマスのハンドは、世界の 5 本指ロボットの 1 つです。最も器用。その手は触覚だけではありません

オックスフォード大学の最新情報!ミッキー:2D画像を3D SOTAでマッチング! (CVPR\'24)

Apr 23, 2024 pm 01:20 PM

オックスフォード大学の最新情報!ミッキー:2D画像を3D SOTAでマッチング! (CVPR\'24)

Apr 23, 2024 pm 01:20 PM

前に書かれたプロジェクトのリンク: https://nianticlabs.github.io/mickey/ 2 枚の写真が与えられた場合、それらの写真間の対応関係を確立することで、それらの間のカメラのポーズを推定できます。通常、これらの対応は 2D 対 2D であり、推定されたポーズはスケール不定です。いつでもどこでもインスタント拡張現実などの一部のアプリケーションでは、スケール メトリクスの姿勢推定が必要なため、スケールを回復するために外部深度推定器に依存します。この論文では、3D カメラ空間でのメトリックの対応を予測できるキーポイント マッチング プロセスである MicKey を提案します。画像全体の 3D 座標マッチングを学習することで、相対的なメトリックを推測できるようになります。

FisheyeDetNet: 魚眼カメラに基づいた最初のターゲット検出アルゴリズム

Apr 26, 2024 am 11:37 AM

FisheyeDetNet: 魚眼カメラに基づいた最初のターゲット検出アルゴリズム

Apr 26, 2024 am 11:37 AM

目標検出は自動運転システムにおいて比較的成熟した問題であり、その中でも歩行者検出は最も初期に導入されたアルゴリズムの 1 つです。ほとんどの論文では非常に包括的な研究が行われています。ただし、サラウンドビューに魚眼カメラを使用した距離認識については、あまり研究されていません。放射状の歪みが大きいため、標準のバウンディング ボックス表現を魚眼カメラに実装するのは困難です。上記の説明を軽減するために、拡張バウンディング ボックス、楕円、および一般的な多角形の設計を極/角度表現に探索し、これらの表現を分析するためのインスタンス セグメンテーション mIOU メトリックを定義します。提案された多角形モデルの FisheyeDetNet は、他のモデルよりも優れたパフォーマンスを示し、同時に自動運転用の Valeo 魚眼カメラ データセットで 49.5% の mAP を達成しました。