ルカン氏の論文は「ウォッシング」で告発された? LSTM の父は怒って、「私の作品をコピーしてオリジナルとしてマークしてください」と書きました。

チューリング賞受賞者のヤン・レクン氏は、AI分野の三大巨人の一人として、彼の発表した論文は当然「バイブル」として研究されています。

しかし、最近、突然誰かが飛び出してきて、ルカンの「地べたに座っている」ことを批判しました。「それは私の中心的な視点を言い換えているだけです。」

#もしかして...

シュミットフーバーはこの長い記事の中で、読者が原論文を研究し、これらのコメントの科学的内容を自分で判断してほしいと述べ、また、彼の研究が評価され評価されることを望んでいると述べた。

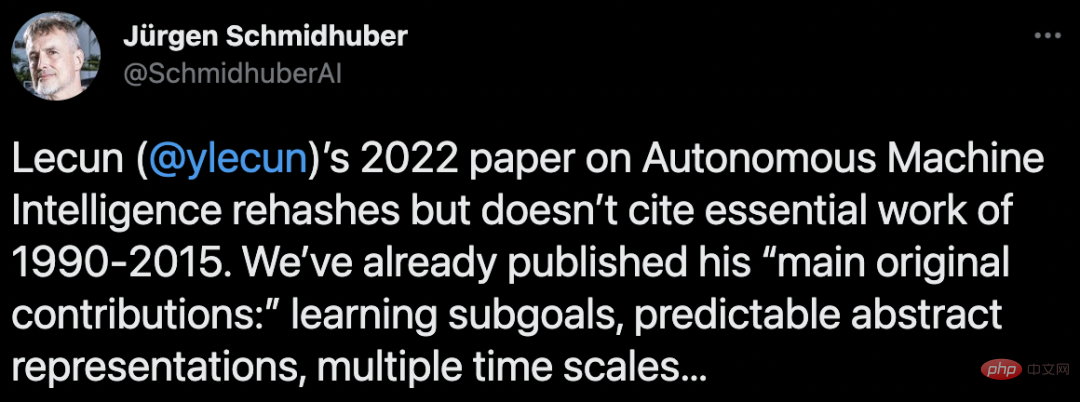

LeCun は論文の冒頭で、この論文で説明されているアイデアの多くは (ほぼすべて) 多くの著者によってさまざまな文脈とさまざまな形で提示されたものであると述べましたが、シュミットフーバーは、残念ながら論文のほとんどは、内容は1990年以降の私たちの論文と「類似」しており、引用マークはありません。

まずは今回のルカン攻撃の証拠(一部)を見てみましょう。

証拠 1:

LeCun: 今日の人工知能研究では、次の 3 つの主要な課題を解決する必要があります: (1) 機械はどのようにして世界を表現することを学習できるか? 、主に観察を通じて予測することを学び、行動することを学ぶ (2) 機械が勾配ベースの学習と互換性のある方法でどのように推論し計画を立てることができるか (3) 機械が階層的な方法で、複数の抽象化レベルでどのようにそれを行うことができるか認識 (3a) と行動計画 (3b) の表現を大規模に学習

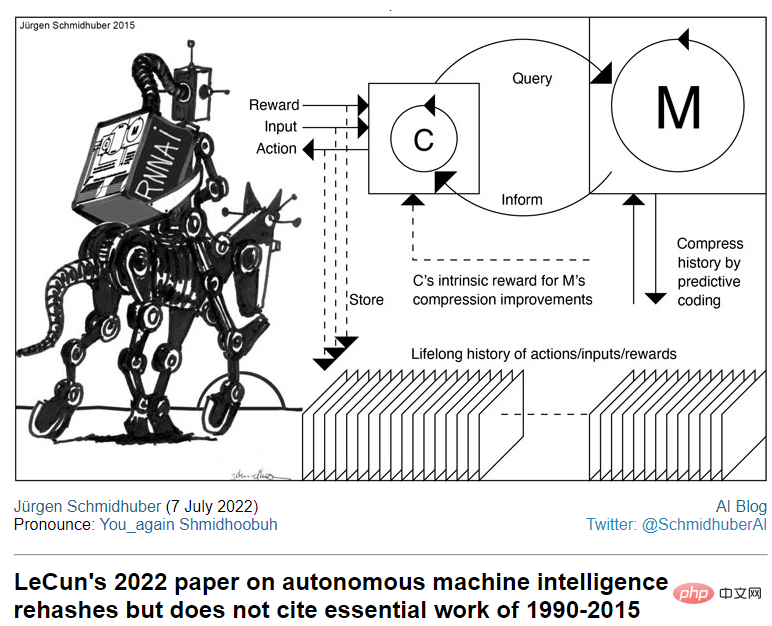

シュミットフーバー: これらの問題は、1990 年、1991 年、1997 年、2015 年に出版された一連の論文で詳しく取り上げられています。

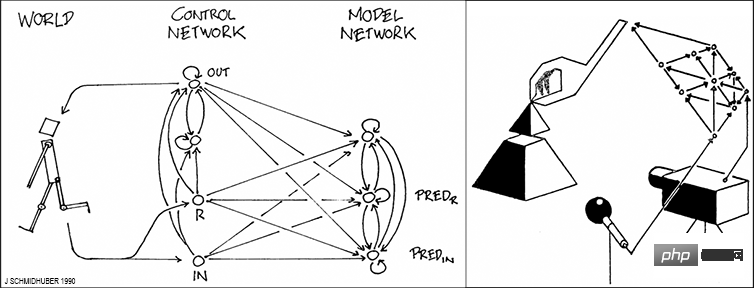

1990 年に、長期計画と強化学習 (RL) および人工好奇心による探索のための勾配ベースの人工ニューラル ネットワーク (NN) に関する最初の研究が発表されました。

これは、コントローラーとワールド モデルと呼ばれる 2 つのリカレント ニューラル ネットワーク (RNN、最も強力な NNN) の組み合わせについて説明します。

その中で、ワールド モデルはコントローラーのアクションの結果を予測することを学習します。コントローラーはワールド モデルを使用して、事前にいくつかのタイム ステップを計画し、予測された報酬を最大化するアクション シーケンスを選択できます。

ニューラル ネットワークに基づく階層的知覚に対する答え (3a) に関して、この質問は少なくとも部分的には、私の 1991 年の出版物「最初の深層学習マシン - ニューラル シーケンス」からインスピレーションを受けています。アナライザー「ブロッカー」ソリューション。

リカレント ニューラル ネットワーク (RNN) の深い階層で教師なし学習と予測コーディングを使用して、「長いデータ シーケンスの内部表現」を見つけます。

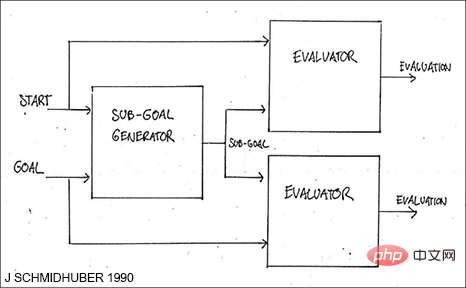

ニューラル ネットワークに基づく階層的行動計画 (3b) に対する答えは、1990 年に階層強化学習 (HRL) に関する私の論文によって少なくとも部分的に解決され、この問題は解決されました。

証拠 2:

LeCun: コスト モジュールの両方のサブモジュールは微分可能であるため、そのため、エネルギー勾配は他のモジュール、特にワールド モジュール、パフォーマンス モジュール、知覚モジュールを通じて逆伝播できます。

シュミットフーバー: これはまさに私が 1980 年に発表した「フィードフォワード ニューラル ネットワークによるシステム識別」論文を引用して 1990 年に発表したものです。

2000 年、私の元博士研究員 Marcus Hutter は、ワールド モデルとコントローラーを学習するための、理論的に最適で一般的な微分不可能な方法を発表しました。 (ゲーデル マシンと呼ばれる数学的に最適な自己参照 AGI も参照)

証拠 3:

LeCun: 短期記憶モジュールアーキテクチャは、キーと値のメモリ ネットワークに似ている可能性があります。

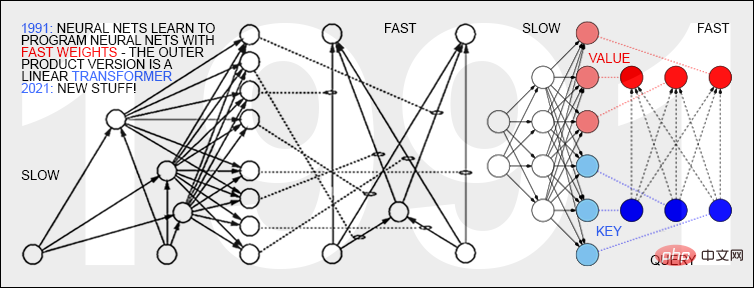

シュミットフーバー: しかし、彼は、私が 1991 年にシーケンス処理「高速ウェイト コントローラー」または高速ウェイト プログラマー (FWP) について説明したときに、そのような「キーと値のメモリ ネットワーク」を最初に公開したことについて言及しませんでした。 FWP には、バックプロパゲーションを通じて学習し、別のニューラル ネットワークの高速な重みを迅速に変更する低速ニューラル ネットワークがあります。

証拠 4:

LeCun: この論文の主な独自性(I) すべてのモジュールが微分可能であり、その多くがトレーニング可能な全体的な認知アーキテクチャ。 (II) H-JEPA: 複数の抽象レベルと複数の時間スケールで表現を学習する世界の非生成階層アーキテクチャを予測するモデル。 (III) 有益かつ予測可能な表現を生成する一連の非対照的な自己教師あり学習パラダイム。 (IV) 不確実性の下での階層計画のための予測世界モデルの基礎として H-JEPA を使用します。

この点に関して、シュミットフーバー氏もルクン氏が挙げた4つのモジュールを一つ一つ校正し、論文と重複する点を挙げた。

記事の最後で、彼は、この記事の焦点は、出版された論文やその著者によって反映されたアイデアを攻撃することではないと述べました。重要な点は、これらのアイデアはルカンの本に書かれているほど「オリジナル」ではないということです。紙。

彼は、これらのアイデアの多くは私と私の同僚の努力によって提案されたと述べました。ルカンが現在提案している彼の「主な独自の貢献」は、実際には私の数十年にわたる研究貢献と切り離せないものです。私のコメントの妥当性を自分で判断してください。

LSTM の父から...

実は、この叔父が自分の結果が他人に盗用されたと主張したのはこれが初めてではありません。

すでに昨年 9 月の時点で、彼は自身のブログに、最も引用されているニューラル ネットワークの論文結果は私の研究室で完了した研究に基づいていると投稿しました:

「言うまでもなく、LSTM、そしてResNet、AlexNet、GAN、Transformer など、今日有名な他の先駆的な作品はすべて私の作品に関連しています。一部の作品の最初のバージョンは私によって作成されましたが、今ではこれらの人々はそうではありません。武道倫理の強調と不規則な引用により、叔父はとても怒っていますが、ユルゲン・シュミットフーバーはここ数年、確かに少々不幸だったと言わざるを得ません。彼らは両方とも AI 分野の上級人物であり、多くの画期的な成果を上げていますが、彼らが受けている評判と認識は常に期待をはるかに下回っているようです。

特に 2018 年に、深層学習の 3 人の巨人、ヨシュア ベンジオ、ジェフリー ヒントン、ヤン ルカンがチューリング賞を受賞したとき、多くのネチズンは、なぜ LSTM にチューリング賞が授与されなかったのか疑問に思いました。彼はディープラーニングの分野の達人でもあります。

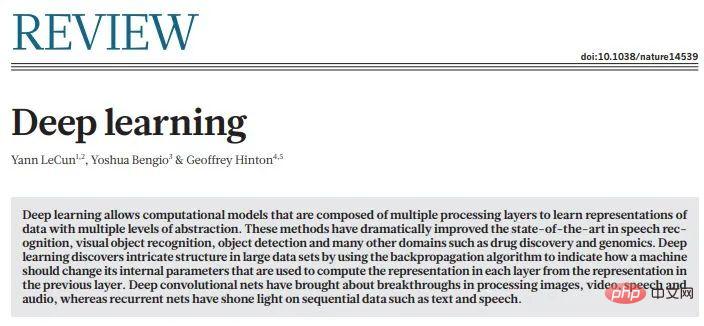

2015 年に、Bengio、Hinton、LeCun という 3 人の偉大な頭脳が共同で Nature にレビューを投稿し、そのタイトルはそのまま「ディープ ラーニング」と呼ばれていました。

この記事は、従来の機械学習テクノロジーから始まり、最新の機械学習の主なアーキテクチャと手法を要約し、多層ネットワーク アーキテクチャをトレーニングするためのバックプロパゲーション アルゴリズムと、畳み込みニューラル ネットワーク、分散表現、および言語の誕生について説明します。処理、リカレント ニューラル ネットワークとそのアプリケーションなど。

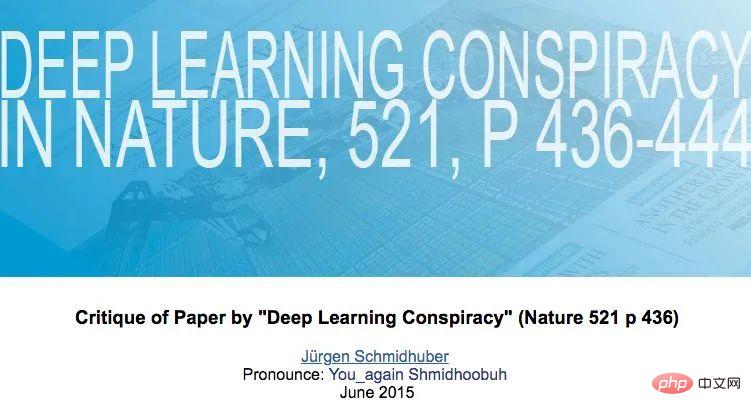

それから 1 か月も経たないうちに、シュミットフーバーは自身のブログに批判を投稿しました。

シュミットフーバー氏は、他の先駆者が深層学習について以前から見解を持っていたのに、記事全体で 3 人の著者自身の研究結果が何度も引用されているため、この記事には非常に不満を感じたと述べました。は全く言及されていない。

彼は、チューリング賞を受賞した「深層学習の 3 人の巨人」は、他人の名誉を貪り、私利私欲を考える泥棒になったと信じています。彼らは、世界における地位を利用して互いに媚び合っています。そして彼らの上級学者を抑圧します。

2016年、ユルゲン・シュミットフーバーはNIPSカンファレンスのチュートリアルで「GANの父」イアン・グッドフェローと真っ向から対決しました。

その時、グッドフェローが GAN と他のモデルの比較について話していると、シュミットフーバーが立ち上がって質問を遮りました。

シュミットフーバー氏の質問は約 2 分間と非常に長く、主な内容は彼が 1992 年に PM を提案したことを強調し、その後それについて多くを語った。 、実装プロセスなど、最後の図は次のことを示しています: あなたの GAN と私の PM の間に類似点があるかどうか教えていただけますか?

グッドフェローは弱みを見せませんでした: あなたが言及した問題については、これまで何度も電子メールで伝えてきましたし、私もかなり前に公の場で返答しました。この件で視聴者の忍耐を無駄にしたくありません。機会。

待て、待て...

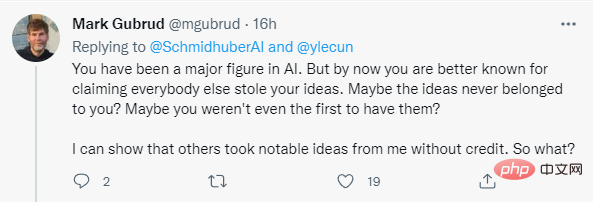

おそらく、シュミットフーバーのこれらの「ハニー作戦」は、ルクンからのメールで説明できるだろう:

「ユルゲンはみんなに、自分は執着しすぎていると言った」認められて、自分に値するものはあまり受け取っていないと常に言います。ほぼ習慣的に、彼は他の人のスピーチの最後に必ず立ち上がって、今提示された結果に対して責任があると言います。一般的に言えば、この行動それは無理です。」

以上がルカン氏の論文は「ウォッシング」で告発された? LSTM の父は怒って、「私の作品をコピーしてオリジナルとしてマークしてください」と書きました。の詳細内容です。詳細については、PHP 中国語 Web サイトの他の関連記事を参照してください。

ホットAIツール

Undresser.AI Undress

リアルなヌード写真を作成する AI 搭載アプリ

AI Clothes Remover

写真から衣服を削除するオンライン AI ツール。

Undress AI Tool

脱衣画像を無料で

Clothoff.io

AI衣類リムーバー

Video Face Swap

完全無料の AI 顔交換ツールを使用して、あらゆるビデオの顔を簡単に交換できます。

人気の記事

ホットツール

メモ帳++7.3.1

使いやすく無料のコードエディター

SublimeText3 中国語版

中国語版、とても使いやすい

ゼンドスタジオ 13.0.1

強力な PHP 統合開発環境

ドリームウィーバー CS6

ビジュアル Web 開発ツール

SublimeText3 Mac版

神レベルのコード編集ソフト(SublimeText3)

ホットトピック

1666

1666

14

14

1425

1425

52

52

1325

1325

25

25

1273

1273

29

29

1252

1252

24

24

Stable Diffusion 3 の論文がついに公開され、アーキテクチャの詳細が明らかになりましたが、Sora の再現に役立つでしょうか?

Mar 06, 2024 pm 05:34 PM

Stable Diffusion 3 の論文がついに公開され、アーキテクチャの詳細が明らかになりましたが、Sora の再現に役立つでしょうか?

Mar 06, 2024 pm 05:34 PM

StableDiffusion3 の論文がついに登場しました!このモデルは2週間前にリリースされ、Soraと同じDiT(DiffusionTransformer)アーキテクチャを採用しており、リリースされると大きな話題を呼びました。前バージョンと比較して、StableDiffusion3で生成される画像の品質が大幅に向上し、マルチテーマプロンプトに対応したほか、テキスト書き込み効果も向上し、文字化けが発生しなくなりました。 StabilityAI は、StableDiffusion3 はパラメータ サイズが 800M から 8B までの一連のモデルであると指摘しました。このパラメーター範囲は、モデルを多くのポータブル デバイス上で直接実行できることを意味し、AI の使用を大幅に削減します。

ICCV'23論文賞「Fighting of Gods」! Meta Divide Everything と ControlNet が共同で選ばれました、審査員を驚かせた記事がもう 1 つありました

Oct 04, 2023 pm 08:37 PM

ICCV'23論文賞「Fighting of Gods」! Meta Divide Everything と ControlNet が共同で選ばれました、審査員を驚かせた記事がもう 1 つありました

Oct 04, 2023 pm 08:37 PM

フランスのパリで開催されたコンピュータービジョンのトップカンファレンス「ICCV2023」が閉幕しました。今年の論文賞はまさに「神と神の戦い」です。たとえば、最優秀論文賞を受賞した 2 つの論文には、ヴィンセント グラフ AI の分野を覆す研究である ControlNet が含まれていました。 ControlNet はオープンソース化されて以来、GitHub で 24,000 個のスターを獲得しています。拡散モデルであれ、コンピュータ ビジョンの全分野であれ、この論文の賞は当然のことです。最優秀論文賞の佳作は、同じく有名なもう 1 つの論文、Meta の「Separate Everything」「Model SAM」に授与されました。 「Segment Everything」は、発売以来、後発のものも含め、さまざまな画像セグメンテーション AI モデルの「ベンチマーク」となっています。

Luo Yonghao氏はHonor Anygate社のSmartphone One Stepの模倣に疑問を呈し、Zhao Ming氏に「Appleの真似をする必要はない」と呼びかけた。

Jan 12, 2024 pm 10:03 PM

Luo Yonghao氏はHonor Anygate社のSmartphone One Stepの模倣に疑問を呈し、Zhao Ming氏に「Appleの真似をする必要はない」と呼びかけた。

Jan 12, 2024 pm 10:03 PM

1 月 11 日のニュースによると、昨日行われた記者会見で、Honor は MagicOS 8.0 を正式にリリースし、その特殊機能の 1 つ「Any Door」が物議を醸したとのことです。ルオ・ヨンハオ氏は、スマーティザン携帯電話のワンステップ機能をコピーしたというオナー氏の噂に反論する趙明氏を非難し、趙明氏に「これはスマーティザン携帯電話のワンステップの裸のコピーだ。趙明氏は、 「? あなたの会社はそこまで恥知らずではないと信じていますし、あなたは Apple ではありません。」 この点に関して、オナー関係者は公には返答していない。 Honor の公式紹介によると、「エニー ドア」機能は新世代の人間とコンピューターのインタラクション エクスペリエンスをもたらします。

紙のイラストも拡散モデルを使用して自動生成でき、ICLR にも受け入れられます。

Jun 27, 2023 pm 05:46 PM

紙のイラストも拡散モデルを使用して自動生成でき、ICLR にも受け入れられます。

Jun 27, 2023 pm 05:46 PM

生成 AI は人工知能コミュニティに旋風を巻き起こし、個人も企業も、Vincent 写真、Vincent ビデオ、Vincent 音楽など、関連するモーダル変換アプリケーションの作成に熱心になり始めています。最近、ServiceNow Research や LIVIA などの科学研究機関の数人の研究者が、テキストの説明に基づいて論文内のグラフを生成しようとしました。この目的のために、彼らは FigGen の新しい手法を提案し、関連する論文も TinyPaper として ICLR2023 に掲載されました。絵用紙のアドレス: https://arxiv.org/pdf/2306.00800.pdf 絵用紙のチャートを生成するのは何がそんなに難しいのかと疑問に思う人もいるかもしれません。これは科学研究にどのように役立ちますか?

チャットのスクリーンショットから AI レビューの隠されたルールが明らかになります。 AAAI 3000元は強力に受け入れられますか?

Apr 12, 2023 am 08:34 AM

チャットのスクリーンショットから AI レビューの隠されたルールが明らかになります。 AAAI 3000元は強力に受け入れられますか?

Apr 12, 2023 am 08:34 AM

AAAI 2023 の論文提出期限が近づいていたとき、AI 投稿グループの匿名チャットのスクリーンショットが突然 Zhihu に表示されました。そのうちの1人は、「3,000元で強力なサービスを提供できる」と主張した。このニュースが発表されるとすぐに、ネットユーザーの間で国民の怒りを引き起こした。ただし、まだ急ぐ必要はありません。 Zhihuのボス「Fine Tuning」は、これはおそらく単に「言葉による喜び」である可能性が高いと述べた。 『ファイン・チューニング』によると、挨拶や集団犯罪はどの分野でも避けられない問題だという。 openreview の台頭により、cmt のさまざまな欠点がますます明らかになり、小さなサークルが活動できる余地は将来的には小さくなるでしょうが、余地は常にあります。これは個人の問題であり、投稿システムや仕組みの問題ではないからです。オープンRの紹介

NeRFと自動運転の過去と現在、10本近くの論文をまとめました!

Nov 14, 2023 pm 03:09 PM

NeRFと自動運転の過去と現在、10本近くの論文をまとめました!

Nov 14, 2023 pm 03:09 PM

Neural Radiance Fieldsは2020年に提案されて以来、関連論文の数が飛躍的に増加し、3次元再構成の重要な分野となっただけでなく、自動運転の重要なツールとして研究の最前線でも徐々に活発になってきています。 NeRF は、過去 2 年間で突然出現しました。その主な理由は、特徴点の抽出とマッチング、エピポーラ幾何学と三角形分割、PnP とバンドル調整、および従来の CV 再構成パイプラインのその他のステップをスキップし、メッシュ再構成、マッピング、ライト トレースさえもスキップするためです。 、2D から直接入力画像を使用して放射線野を学習し、実際の写真に近いレンダリング画像が放射線野から出力されます。言い換えれば、ニューラル ネットワークに基づく暗黙的な 3 次元モデルを指定されたパースペクティブに適合させます。

中国チームが最優秀論文賞と最優秀システム論文賞を受賞し、CoRLの研究成果が発表されました。

Nov 10, 2023 pm 02:21 PM

中国チームが最優秀論文賞と最優秀システム論文賞を受賞し、CoRLの研究成果が発表されました。

Nov 10, 2023 pm 02:21 PM

2017 年に初めて開催されて以来、CoRL はロボット工学と機械学習の交差点における世界トップクラスの学術会議の 1 つになりました。 CoRL は、理論と応用を含むロボット工学、機械学習、制御などの複数のトピックをカバーするロボット学習研究のための単一テーマのカンファレンスであり、2023 年 CoRL カンファレンスは 11 月 6 日から 9 日まで米国アトランタで開催されます。公式データによると、今年は25か国から199本の論文がCoRLに選ばれた。人気のあるトピックには、演算、強化学習などが含まれます。 CoRLはAAAIやCVPRといった大規模なAI学会に比べて規模は小さいものの、今年は大型モデル、身体化知能、ヒューマノイドロボットなどの概念の人気が高まる中、関連研究も注目されるだろう。

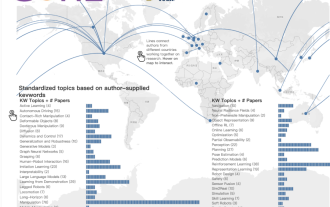

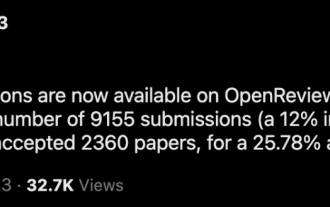

CVPR 2023 ランキング発表、採択率は 25.78%! 2,360 件の論文が受理され、投稿数は 9,155 件に急増しました。

Apr 13, 2023 am 09:37 AM

CVPR 2023 ランキング発表、採択率は 25.78%! 2,360 件の論文が受理され、投稿数は 9,155 件に急増しました。

Apr 13, 2023 am 09:37 AM

ちょうど今、CVPR 2023 が次のような記事を発表しました: 今年は記録的な 9,155 件の論文 (CVPR2022 より 12% 増) を受け取り、2,360 件の論文を受理し、受理率は 25.78% でした。統計によると、CVPRへの投稿数は2010年から2016年の7年間で1,724件から2,145件に増加しただけです。 2017年以降は急上昇して高度成長期に入り、2019年には初めて5,000件を超え、2022年には投稿数が8,161件に達した。ご覧のとおり、今年は合計 9,155 件の論文が投稿され、確かに記録を樹立しました。流行が緩和された後、今年のCVPRサミットはカナダで開催される予定だ。今年はシングルトラックカンファレンスとなり、従来の口頭選考は中止される。グーグルリサーチ