Technologie-Peripheriegeräte

Technologie-Peripheriegeräte

KI

KI

Erstellen eines QA -Modells mit universellem Satz Encoder und Wikiqa

Erstellen eines QA -Modells mit universellem Satz Encoder und Wikiqa

Erstellen eines QA -Modells mit universellem Satz Encoder und Wikiqa

Nutzung der Macht der Einbettung von Modellen für die Beantwortung fortgeschrittener Frage

In der heutigen informationsreichen Welt ist die Fähigkeit, genaue Antworten sofort zu erhalten, von größter Bedeutung. Dieser Artikel zeigt, dass das Erstellen eines robusten Fragen-Answering-Modells (QA) unter Verwendung des Universal-Satz-Encoders (Verwendung) und des Wikiqa-Datensatzes erstellt wird. Wir nutzen fortgeschrittene Einbettungstechniken, um die Lücke zwischen menschlicher Untersuchung und Maschinenverständnis zu überbrücken und eine intuitivere Informationsabruferfahrung zu schaffen.

Wichtige Lernergebnisse:

- Beherrschen Sie die Anwendung von Einbettungsmodellen wie verwendet, um Textdaten in hochdimensionale Vektordarstellungen umzuwandeln.

- Navigieren Sie durch die Komplexität der Auswahl und Feinabstimmung vorgebliebene Modelle für eine optimale Leistung.

- Implementieren Sie ein funktionales QA -System unter Verwendung von Einbettungsmodellen und Cosinus -Ähnlichkeit anhand praktischer Codierungsbeispiele.

- Erfassen Sie die zugrunde liegenden Prinzipien der Ähnlichkeit der Cosinus und ihre Rolle beim Vergleich des vektorisierten Textes.

(Dieser Artikel ist Teil des Data Science -Blogathons.)

Inhaltsverzeichnis:

- Einbetten von Modellen in NLP

- Verständnis der Einbettung von Darstellungen

- Semantische Ähnlichkeit: Erfassen von Textbedeutungen

- Nutzung des universellen Satz Encoder

- Aufbau eines Frage-Antwort-Generators

- Vorteile von Einbettungsmodellen in NLP

- Herausforderungen in der Entwicklung des QA -Systems

- Häufig gestellte Fragen

Einbetten von Modellen in die natürliche Sprachverarbeitung

Wir verwenden Einbettungsmodelle, einen Eckpfeiler des modernen NLP. Diese Modelle übersetzen Text in numerische Formate, die die semantische Bedeutung widerspiegeln. Wörter, Phrasen oder Sätze werden in numerische Vektoren (Einbettungen) umgewandelt, um Algorithmen auf raffinierte Weise zu verarbeiten und zu verstehen.

Verständnis der Einbettungsmodelle

Worteinbettungen repräsentieren Wörter als dichte numerische Vektoren, bei denen semantisch ähnliche Wörter ähnliche Vektor -Darstellungen aufweisen. Anstatt diese Codierungen manuell zuzuweisen, lernt das Modell sie während des Trainings als trainierbare Parameter. Die Einbettungsdimensionen variieren (z. B. 300 bis 1024), wobei höhere Dimensionen nuanciertere semantische Beziehungen aufnehmen. Stellen Sie sich Einbettungen als "Lookup -Tabelle" vor, die den Vektor jedes Wortes für effiziente Codierung und Abruf speichert.

Semantische Ähnlichkeit: Bedeutung quantifizieren

Die semantische Ähnlichkeit misst, wie eng zwei Textsegmente die gleiche Bedeutung vermitteln. Diese Fähigkeit ermöglicht es Systemen, verschiedene sprachliche Ausdrücke desselben Konzepts ohne explizite Definitionen für jede Variation zu verstehen.

Universeller Satzcodierer für eine verbesserte Textverarbeitung

Dieses Projekt verwendet den Universal Sätze Encoder (Verwendung), das hochdimensionale Vektoren aus Text erzeugt, ideal für Aufgaben wie semantische Ähnlichkeit und Textklassifizierung. Optimiert für längere Textsequenzen wird die Verwendung auf verschiedenen Datensätzen geschult und passt gut an verschiedene NLP -Aufgaben an. Es gibt für jeden Eingangssatz einen 512-dimensionalen Vektor aus.

Beispiel für die Einbettung der Generierung verwendet: Verwendung:

! PIP Installieren Sie TensorFlow Tensorflow-Hub

Tensorflow als TF importieren

TensorFlow_Hub als Hub importieren

Einbett = hub.load ("https://tfhub.dev/google/universal-stence-coder/4")

Sätze = [

"Der schnelle braune Fuchs springt über den faulen Hund."

"Ich bin ein Satz, für den ich seine Einbettung bekommen möchte"

]

Einbettungen = Einbettung (Sätze)

drucken (Einbettung)

drucken (embettdings.numpy ())Ausgabe:

Verwendung verwendet eine tiefgründige Mittelwerte (Dan) -Architektur, die sich eher auf Satzebene als auf einzelne Wörter konzentriert. Ausführliche Informationen finden Sie in der Einbettungsdokumentation von Papier und TensorFlow. Das Modul behandelt die Vorverarbeitung und beseitigt die Bedarf an manueller Datenvorbereitung.

Das Verwendungsmodell ist teilweise für die Textklassifizierung vorbereitet, wodurch es mit minimal beschrifteten Daten an verschiedene Klassifizierungsaufgaben anpassbar ist.

Implementierung eines Fragen-Antworter-Generators

Wir verwenden den Wikiqa -Datensatz für diese Implementierung.

Pandas als PD importieren

TensorFlow_Hub als Hub importieren

Numph als NP importieren

von sklearn.metrics

# Dataset laden (Pfad nach Bedarf anpassen)

df = pd.read_csv ('/content/train.csv')

Fragen = df ['Frage']. Tolist ()

Antworten = df ['Antwort']. Tolist ()

# Universal -Satz -Encoder laden

Einbett = hub.load ("https://tfhub.dev/google/universal-stence-coder/4")

# Einbettungen berechnen

FRAGE_EMBEDDINGS = Einbettung (Fragen)

Antwort_embeddings = Einbett (Antworten)

# Ähnlichkeitswerte berechnen

Ähnlichkeit_Scores = Cosine_similarity (Frage_embeding, Antwort_embeddings)

# Antworten vorhersagen

Predicted_indices = np.argmax (Ähnlichkeit_Scores, Axis = 1)

Vorhersagen = [Antworten [IDX] für IDX in Predicted_indices]

# Fragen und vorhergesagte Antworten drucken

Für mich, Frage in Aufzählung (Fragen):

print (f "Frage: {Frage}")

print (f "vorhergesagte Antwort: {Vorhersagen [i]} \ n")

Der Code wird geändert, um benutzerdefinierte Fragen zu bearbeiten, die ähnlichste Frage aus dem Datensatz zu identifizieren und seine entsprechende Antwort zurückzugeben.

Def Ask_Question (New_Question):

new_question_embedding = einbett ([new_question])

yesineity_scores = Cosine_similarity (new_question_embedding, Frage_embeddings)

Most_simailar_Question_idx = np.argmax (Ähnlichkeit_Scores)

meist_simailar_Question = Fragen [Most_similar_Question_idx]

Predicted_answer = Answers [Most_simailar_Question_idx]

RECHT MELD_SIMILILE_QUESTION, PHODICATED_ANSWER

# Beispielnutzung

new_question = "Wann wurde Apple Computer gegründet?"

meist_simailar_Question, vorhergesagt_answer = Ask_Question (new_question)

print (f "neue Frage: {new_question}")

print (f "die ähnliche Frage: {Most_similar_Question}")

print (f "vorhergesagte Antwort: {Predicated_answer}"))Ausgabe:

Vorteile von Einbettungsmodellen in NLP

- Vorausgebildete Modelle wie Verwendung reduzieren die Trainingszeit und Rechenressourcen.

- Erfassen Sie semantische Ähnlichkeit, passende Paraphrasen und Synonyme.

- Unterstützen Sie mehrsprachige Fähigkeiten.

- Vereinfachen Sie Feature Engineering für maschinelles Lernen.

Herausforderungen in der Entwicklung des QA -Systems

- Modellauswahl und Parameterabstimmung.

- Effizienter Umgang mit großen Datensätzen.

- Nuancen und kontextbezogene Unklarheiten in der Sprache.

Abschluss

Die Einbettungsmodelle verbessern die QA -Systeme erheblich, indem genaue Identifizierung und Abrufen relevanter Antworten ermöglicht werden. Dieser Ansatz zeigt die Kraft, Modelle bei der Verbesserung der Human-Computer-Wechselwirkung innerhalb von NLP-Aufgaben einzubetten.

Wichtigste Imbiss:

- Einbettungsmodelle bieten leistungsstarke Tools für die numerischste Darstellung von Text.

- Einbettungsbasierte QA-Systeme verbessern die Benutzererfahrung durch genaue Antworten.

- Die Herausforderungen sind semantische Mehrdeutigkeit, vielfältige Abfragetypen und Recheneffizienz.

Häufig gestellte Fragen

F1: Welche Rolle spielt die Einbettungsmodelle in QA -Systeme? A1: Das Einbetten von Modellen verwandeln Text in numerische Darstellungen und ermöglicht es, Systeme genau zu verstehen und auf Fragen zu reagieren.

F2: Wie gehen Einbettungssysteme mit mehreren Sprachen um? A2: Viele Einbettungsmodelle unterstützen mehrere Sprachen und erleichtern die Entwicklung mehrsprachiger QA -Systeme.

F3: Warum sind die Einbettungssysteme den traditionellen Methoden für die QA überlegen? A3: Einbettungssysteme zeichnen sich aus, um semantische Ähnlichkeit zu erfassen und verschiedene sprachliche Ausdrücke zu bewältigen.

F4: Welche Herausforderungen bestehen bei der Einbettungsbasis QA-Systeme? A4: Optimale Modellauswahl, Parameterabstimmung und effiziente groß angelegte Datenbearbeitung stellen erhebliche Herausforderungen dar.

F5: Wie verbessern die Einbettungsmodelle die Benutzerinteraktion in QA -Systemen? A5: Durch genaue Anpassung von Fragen zu Antworten, die auf semantischer Ähnlichkeit basieren, bieten Einbettungsmodelle relevantere und zufriedenstellendere Benutzererfahrungen.

(Hinweis: Die verwendeten Bilder sind nicht im Besitz des Autors und werden mit Genehmigung verwendet.)

Das obige ist der detaillierte Inhalt vonErstellen eines QA -Modells mit universellem Satz Encoder und Wikiqa. Für weitere Informationen folgen Sie bitte anderen verwandten Artikeln auf der PHP chinesischen Website!

Heiße KI -Werkzeuge

Undresser.AI Undress

KI-gestützte App zum Erstellen realistischer Aktfotos

AI Clothes Remover

Online-KI-Tool zum Entfernen von Kleidung aus Fotos.

Undress AI Tool

Ausziehbilder kostenlos

Clothoff.io

KI-Kleiderentferner

Video Face Swap

Tauschen Sie Gesichter in jedem Video mühelos mit unserem völlig kostenlosen KI-Gesichtstausch-Tool aus!

Heißer Artikel

Heiße Werkzeuge

Notepad++7.3.1

Einfach zu bedienender und kostenloser Code-Editor

SublimeText3 chinesische Version

Chinesische Version, sehr einfach zu bedienen

Senden Sie Studio 13.0.1

Leistungsstarke integrierte PHP-Entwicklungsumgebung

Dreamweaver CS6

Visuelle Webentwicklungstools

SublimeText3 Mac-Version

Codebearbeitungssoftware auf Gottesniveau (SublimeText3)

Heiße Themen

1677

1677

14

14

1431

1431

52

52

1334

1334

25

25

1280

1280

29

29

1257

1257

24

24

Wie baue ich multimodale KI -Agenten mit AGNO -Framework auf?

Apr 23, 2025 am 11:30 AM

Wie baue ich multimodale KI -Agenten mit AGNO -Framework auf?

Apr 23, 2025 am 11:30 AM

Während der Arbeit an Agentic AI navigieren Entwickler häufig die Kompromisse zwischen Geschwindigkeit, Flexibilität und Ressourceneffizienz. Ich habe den Agenten-KI-Framework untersucht und bin auf Agno gestoßen (früher war es phi-

OpenAI-Verschiebungen Fokus mit GPT-4.1, priorisiert die Codierung und Kosteneffizienz

Apr 16, 2025 am 11:37 AM

OpenAI-Verschiebungen Fokus mit GPT-4.1, priorisiert die Codierung und Kosteneffizienz

Apr 16, 2025 am 11:37 AM

Die Veröffentlichung umfasst drei verschiedene Modelle, GPT-4.1, GPT-4.1 Mini und GPT-4.1-Nano, die einen Zug zu aufgabenspezifischen Optimierungen innerhalb der Landschaft des Großsprachenmodells signalisieren. Diese Modelle ersetzen nicht sofort benutzergerichtete Schnittstellen wie

Wie füge ich eine Spalte in SQL hinzu? - Analytics Vidhya

Apr 17, 2025 am 11:43 AM

Wie füge ich eine Spalte in SQL hinzu? - Analytics Vidhya

Apr 17, 2025 am 11:43 AM

SQL -Änderungstabellanweisung: Dynamisches Hinzufügen von Spalten zu Ihrer Datenbank Im Datenmanagement ist die Anpassungsfähigkeit von SQL von entscheidender Bedeutung. Müssen Sie Ihre Datenbankstruktur im laufenden Flug anpassen? Die Änderungstabelleerklärung ist Ihre Lösung. Diese Anleitung Details Hinzufügen von Colu

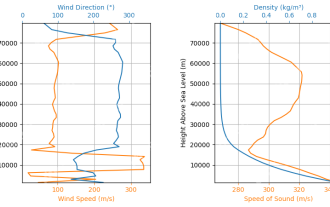

Raketenstartsimulation und -analyse unter Verwendung von Rocketpy - Analytics Vidhya

Apr 19, 2025 am 11:12 AM

Raketenstartsimulation und -analyse unter Verwendung von Rocketpy - Analytics Vidhya

Apr 19, 2025 am 11:12 AM

Simulieren Raketenstarts mit Rocketpy: Eine umfassende Anleitung Dieser Artikel führt Sie durch die Simulation von Rocketpy-Starts mit hoher Leistung mit Rocketpy, einer leistungsstarken Python-Bibliothek. Wir werden alles abdecken, von der Definition von Raketenkomponenten bis zur Analyse von Simula

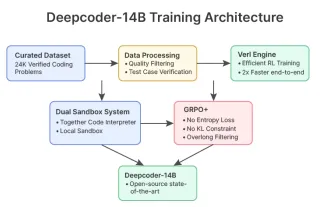

DeepCoder-14b: Der Open-Source-Wettbewerb mit O3-Mini und O1

Apr 26, 2025 am 09:07 AM

DeepCoder-14b: Der Open-Source-Wettbewerb mit O3-Mini und O1

Apr 26, 2025 am 09:07 AM

In einer bedeutenden Entwicklung für die KI-Community haben Agentica und gemeinsam KI ein Open-Source-KI-Codierungsmodell namens DeepCoder-14b veröffentlicht. Angebotsfunktionen der Codegenerierung mit geschlossenen Wettbewerbern wie OpenAI,

Die Eingabeaufforderung: Chatgpt generiert gefälschte Pässe

Apr 16, 2025 am 11:35 AM

Die Eingabeaufforderung: Chatgpt generiert gefälschte Pässe

Apr 16, 2025 am 11:35 AM

Der Chip Giant Nvidia sagte am Montag, es werde zum ersten Mal in den USA die Herstellung von KI -Supercomputern - Maschinen mit der Verarbeitung reichlicher Daten herstellen und komplexe Algorithmen ausführen. Die Ankündigung erfolgt nach Präsident Trump SI

Eine Eingabeaufforderung kann die Schutzmaßnahmen von den großen LLM umgehen

Apr 25, 2025 am 11:16 AM

Eine Eingabeaufforderung kann die Schutzmaßnahmen von den großen LLM umgehen

Apr 25, 2025 am 11:16 AM

Die bahnbrechende Forschung von HiddenLayer zeigt eine kritische Anfälligkeit in führenden großsprachigen Modellen (LLMs). Ihre Ergebnisse zeigen eine universelle Bypass -Technik, die als "Policy Puppetry" bezeichnet wird und fast alle wichtigen LLMs umgehen können

Guy Peri hilft bei der Zukunft von McCormick durch Datenumwandlung

Apr 19, 2025 am 11:35 AM

Guy Peri hilft bei der Zukunft von McCormick durch Datenumwandlung

Apr 19, 2025 am 11:35 AM

Guy Peri ist McCormicks Chief Information und Digital Officer. Obwohl Peri nur sieben Monate nach seiner Rolle eine umfassende Transformation der digitalen Fähigkeiten des Unternehmens vorantreibt. Sein beruflicher Fokus auf Daten und Analysen informiert