Warum scheitert Rag und wie kann ich es beheben?

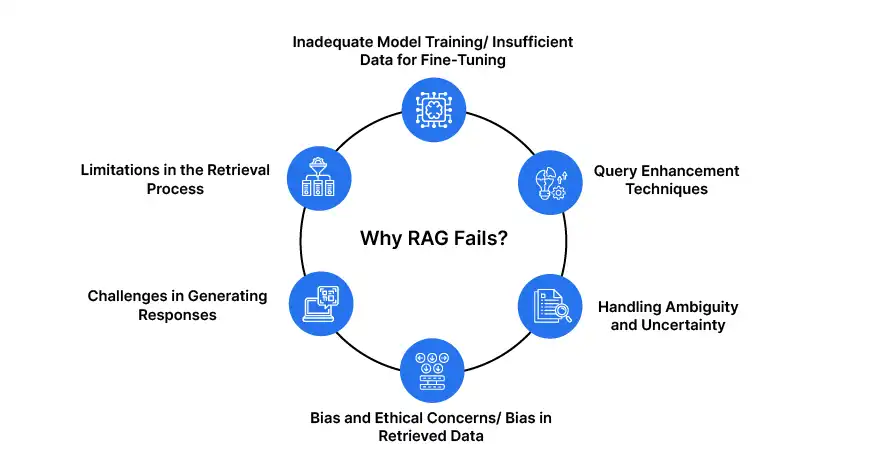

ARRAVEAL-AUGmented Generation (RAG) verbessert die Großsprachenmodelle (LLMs) erheblich, indem externe Wissensquellen einbezogen werden, was zu genaueren und kontextbezogenen Antworten führt. Lag -Systeme sind jedoch nicht ohne ihre Mängel und erzeugen häufig ungenaue oder irrelevante Ausgänge. Diese Einschränkungen behindern die Anwendung von RAG in verschiedenen Bereichen, einschließlich Kundendienst, Forschung und Inhaltserstellung. Das Verständnis dieser Mängel ist entscheidend für die Entwicklung zuverlässigerer ARI-basierter KI. Dieser Artikel befasst sich mit den Gründen für Lappenversagen und untersucht Strategien zur Steigerung der Lappenleistung, was zu effizienteren und skalierbaren Systemen führt. Verbesserte Lappenmodelle versprechen konsistentere, qualitativ hochwertige KI-Ausgänge.

Inhaltsverzeichnis

- Was ist Lag?

- Rags Grenzen

- Abrufprozessfehler und Lösungen

- Abfrage-Dokument-Missverhältnisse

- Mängel bei Such-/Abrufalgorithmen

- Chunking -Herausforderungen

- Einbetten von Problemen in Lappensysteme

- Probleme bei ineffizienten Abrufen

- Erzeugungsprozessfehler und Lösungen

- Kontextintegrationsschwierigkeiten

- Argumentationsbeschränkungen

- Reaktionsformatierungsprobleme

- Kontextfensterverwaltung

- Fehler und Lösungen auf Systemebene

- Zeit- und Latenzprobleme

- Bewertungsschwierigkeiten

- Architektonische Einschränkungen

- Kosten- und Ressourcenoptimierung

- Abschluss

- Häufig gestellte Fragen

Was ist Lag?

Rag oder retrieval-generierte Generation ist eine hoch entwickelte Technik für natürliche Sprachverarbeitung, die Abrufmethoden mit generativen KI-Modellen kombiniert, um präzise und kontextbezogene Antworten zu liefern. Im Gegensatz zu Modellen, die sich ausschließlich auf Trainingsdaten stützen, greifen Lag dynamisch auf externe Informationen zu, um die Antworten zu informieren.

Schlüsselkomponenten:

- Abrufsystem: Diese Komponente extrahiert relevante Informationen aus externen Quellen und bietet aktuelles Wissen. Ein robustes Abrufsystem ist für hochwertige Antworten von entscheidender Bedeutung. Eine schlecht gestaltete, kann zu Ungenauigkeiten oder fehlenden Informationen führen.

- Generatives Modell: Ein LLM verarbeitet Daten und Benutzerabfragen, um kohärente Antworten zu generieren. Die Genauigkeit des generativen Modells hängt stark von der Qualität der abgerufenen Daten ab.

- Systemkonfiguration: Dadurch werden Abrufstrategien, Modellparameter, Indexierung und Validierung verwaltet, um Geschwindigkeit, Genauigkeit und Effizienz zu optimieren. Eine effektive Konfiguration ist für ein gut funktionierendes System unerlässlich.

Weitere Informationen: Abrufenvergrößerung der Augmented Generation (LAG) verstehen

Rags Grenzen

Während RAG LLMs durch Einbeziehung externer Wissen, Verbesserung der Genauigkeit und kontextbezogenen Relevanz verbessert, steht er erheblichen Herausforderungen, die die allgemeine Zuverlässigkeit und Effektivität einschränken. Das Erkennen dieser Einschränkungen ist entscheidend für die Entwicklung robusterer Systeme.

Diese Einschränkungen fallen in drei Hauptkategorien:

- Abrufprozessfehler

- Erzeugungsprozessfehler

- Fehler auf Systemebene

Indem wir diese Probleme behandeln und gezielte Verbesserungen implementieren, können wir zuverlässigere und effektivere Lappensysteme erstellen.

Sehen Sie sich dies an, um mehr zu erfahren: Bewältigung der realen Herausforderungen in Rag-Systemen

(Die verbleibenden Abschnitte, in denen das Abrufen von Abrufprozessfehlern, Erzeugungsprozessfehlern, Fehler auf Systemebene, Schlussfolgerung und FAQs ein ähnliches Muster der Reform- und Umstrukturierung folgen, die ursprüngliche Inhalt und Bildplatzierung beibehalten.)

Das obige ist der detaillierte Inhalt vonWarum scheitert Rag und wie kann ich es beheben?. Für weitere Informationen folgen Sie bitte anderen verwandten Artikeln auf der PHP chinesischen Website!

Heiße KI -Werkzeuge

Undresser.AI Undress

KI-gestützte App zum Erstellen realistischer Aktfotos

AI Clothes Remover

Online-KI-Tool zum Entfernen von Kleidung aus Fotos.

Undress AI Tool

Ausziehbilder kostenlos

Clothoff.io

KI-Kleiderentferner

Video Face Swap

Tauschen Sie Gesichter in jedem Video mühelos mit unserem völlig kostenlosen KI-Gesichtstausch-Tool aus!

Heißer Artikel

Heiße Werkzeuge

Notepad++7.3.1

Einfach zu bedienender und kostenloser Code-Editor

SublimeText3 chinesische Version

Chinesische Version, sehr einfach zu bedienen

Senden Sie Studio 13.0.1

Leistungsstarke integrierte PHP-Entwicklungsumgebung

Dreamweaver CS6

Visuelle Webentwicklungstools

SublimeText3 Mac-Version

Codebearbeitungssoftware auf Gottesniveau (SublimeText3)

Heiße Themen

1677

1677

14

14

1431

1431

52

52

1334

1334

25

25

1280

1280

29

29

1257

1257

24

24

Wie baue ich multimodale KI -Agenten mit AGNO -Framework auf?

Apr 23, 2025 am 11:30 AM

Wie baue ich multimodale KI -Agenten mit AGNO -Framework auf?

Apr 23, 2025 am 11:30 AM

Während der Arbeit an Agentic AI navigieren Entwickler häufig die Kompromisse zwischen Geschwindigkeit, Flexibilität und Ressourceneffizienz. Ich habe den Agenten-KI-Framework untersucht und bin auf Agno gestoßen (früher war es phi-

OpenAI-Verschiebungen Fokus mit GPT-4.1, priorisiert die Codierung und Kosteneffizienz

Apr 16, 2025 am 11:37 AM

OpenAI-Verschiebungen Fokus mit GPT-4.1, priorisiert die Codierung und Kosteneffizienz

Apr 16, 2025 am 11:37 AM

Die Veröffentlichung umfasst drei verschiedene Modelle, GPT-4.1, GPT-4.1 Mini und GPT-4.1-Nano, die einen Zug zu aufgabenspezifischen Optimierungen innerhalb der Landschaft des Großsprachenmodells signalisieren. Diese Modelle ersetzen nicht sofort benutzergerichtete Schnittstellen wie

Wie füge ich eine Spalte in SQL hinzu? - Analytics Vidhya

Apr 17, 2025 am 11:43 AM

Wie füge ich eine Spalte in SQL hinzu? - Analytics Vidhya

Apr 17, 2025 am 11:43 AM

SQL -Änderungstabellanweisung: Dynamisches Hinzufügen von Spalten zu Ihrer Datenbank Im Datenmanagement ist die Anpassungsfähigkeit von SQL von entscheidender Bedeutung. Müssen Sie Ihre Datenbankstruktur im laufenden Flug anpassen? Die Änderungstabelleerklärung ist Ihre Lösung. Diese Anleitung Details Hinzufügen von Colu

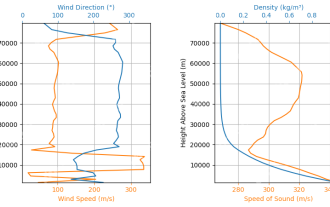

Raketenstartsimulation und -analyse unter Verwendung von Rocketpy - Analytics Vidhya

Apr 19, 2025 am 11:12 AM

Raketenstartsimulation und -analyse unter Verwendung von Rocketpy - Analytics Vidhya

Apr 19, 2025 am 11:12 AM

Simulieren Raketenstarts mit Rocketpy: Eine umfassende Anleitung Dieser Artikel führt Sie durch die Simulation von Rocketpy-Starts mit hoher Leistung mit Rocketpy, einer leistungsstarken Python-Bibliothek. Wir werden alles abdecken, von der Definition von Raketenkomponenten bis zur Analyse von Simula

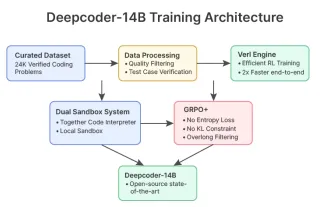

DeepCoder-14b: Der Open-Source-Wettbewerb mit O3-Mini und O1

Apr 26, 2025 am 09:07 AM

DeepCoder-14b: Der Open-Source-Wettbewerb mit O3-Mini und O1

Apr 26, 2025 am 09:07 AM

In einer bedeutenden Entwicklung für die KI-Community haben Agentica und gemeinsam KI ein Open-Source-KI-Codierungsmodell namens DeepCoder-14b veröffentlicht. Angebotsfunktionen der Codegenerierung mit geschlossenen Wettbewerbern wie OpenAI,

Die Eingabeaufforderung: Chatgpt generiert gefälschte Pässe

Apr 16, 2025 am 11:35 AM

Die Eingabeaufforderung: Chatgpt generiert gefälschte Pässe

Apr 16, 2025 am 11:35 AM

Der Chip Giant Nvidia sagte am Montag, es werde zum ersten Mal in den USA die Herstellung von KI -Supercomputern - Maschinen mit der Verarbeitung reichlicher Daten herstellen und komplexe Algorithmen ausführen. Die Ankündigung erfolgt nach Präsident Trump SI

Eine Eingabeaufforderung kann die Schutzmaßnahmen von den großen LLM umgehen

Apr 25, 2025 am 11:16 AM

Eine Eingabeaufforderung kann die Schutzmaßnahmen von den großen LLM umgehen

Apr 25, 2025 am 11:16 AM

Die bahnbrechende Forschung von HiddenLayer zeigt eine kritische Anfälligkeit in führenden großsprachigen Modellen (LLMs). Ihre Ergebnisse zeigen eine universelle Bypass -Technik, die als "Policy Puppetry" bezeichnet wird und fast alle wichtigen LLMs umgehen können

Guy Peri hilft bei der Zukunft von McCormick durch Datenumwandlung

Apr 19, 2025 am 11:35 AM

Guy Peri hilft bei der Zukunft von McCormick durch Datenumwandlung

Apr 19, 2025 am 11:35 AM

Guy Peri ist McCormicks Chief Information und Digital Officer. Obwohl Peri nur sieben Monate nach seiner Rolle eine umfassende Transformation der digitalen Fähigkeiten des Unternehmens vorantreibt. Sein beruflicher Fokus auf Daten und Analysen informiert