Andrej Karpathie auf Puzzlungslösungs-Benchmarks

AI-Entwicklungsbewertung: Über die Benchmarks über Puzzleauslösungen hinaus

KI -Benchmarks sind seit langem der Standard für die Messung der Fortschritte in der KI und bieten eine praktische Möglichkeit, Systemfunktionen zu bewerten und zu vergleichen. Aber ist dieser Ansatz wirklich der beste Weg, KI -Systeme zu bewerten? Andrej Karpathy stellte kürzlich die Angemessenheit dieses Ansatzes in einem Artikel auf der X -Plattform in Frage. KI -Systeme werden immer besser darin, vordefinierte Probleme zu lösen, aber ihre breitere Nützlichkeit und ihre Anpassungsfähigkeit bleiben ungewiss. Dies wirft eine wichtige Frage auf: Konzentrieren wir uns nur auf Puzzle-Lösungs-Benchmarks und behindern so das wahre Potenzial der KI?

Ich persönlich fange keine Erkältung über diese kleinen Puzzle -Benchmarks und fühle mich wieder in der Atari -Ära. Die Benchmarks, auf die ich mich mehr konzentriere, sind näher an der Summe des Gesamtumsatzes (ARR) von AI -Produkten, aber nicht sicher, ob es eine einfachere/öffentliche Metrik gibt, die den größten Teil der Situation erfasst. Ich weiß, dieser Witz bezieht sich auf Nvidia.

- Andrej Karpathy (@karpathy) 23. Dezember 2024

Inhaltsverzeichnis

- Probleme beim Puzzle -Benchmarking

- Wichtige Herausforderungen des aktuellen Benchmarking

- Sich auf sinnvollere Benchmarks bewegen

- Missionssimulation der realen Welt

- Langfristige Planung und Argumentation

- Ethik und soziales Bewusstsein

- Cross-Domänen-Generalisierungsfähigkeit

- Die Zukunft des AI -Benchmarking

- Abschluss

Probleme beim Puzzle -Benchmarking

LLM -Benchmarks wie MMLU und Kleber steigern zweifellos erhebliche Fortschritte in NLP und Deep Learning. Diese Benchmarks reduzieren jedoch häufig komplexe, reale Herausforderungen bei gut definierten Herausforderungen mit klaren Zielen und Bewertungskriterien. Während diese Vereinfachung für die Forschung möglich ist, kann sie die tieferen Fähigkeiten, die erforderlich sind, um einen sinnvollen Einfluss auf die Gesellschaft zu haben, maskieren.

Der Artikel von Karpathy zeigt ein grundlegendes Problem: „Benchmarks werden immer mehr wie Puzzlebe. Viele Kommentatoren betonen, dass die Fähigkeit, neue, undefinierte Aufgaben zu verallgemeinern und sich an sie anzupassen, weitaus wichtiger ist, als in eng definierten Benchmarks gut zu funktionieren.

Lesen Sie auch: Wie bewertet man große Sprachmodelle (LLMs)?

Wichtige Herausforderungen des aktuellen Benchmarking

Überanpassung des Indikators

KI -Systeme sind so optimiert, dass sie in einem bestimmten Datensatz oder einer bestimmten Aufgabe gut abschneiden, was zu Überanpassungen führt. Auch wenn der Benchmark-Datensatz während des Trainings nicht explizit verwendet wird, kann es zu Datenverlusten kommen, wodurch das Modell versehentlich Benchmark-spezifische Muster erlernen kann. Dies kann seine Leistung in einer breiteren Palette realer Anwendungen behindern. KI -Systeme sind so optimiert, dass sie in einem bestimmten Datensatz oder einer bestimmten Aufgabe gut abschneiden, was zu Überanpassungen führt. Dies führt jedoch nicht unbedingt in den realen Dienstprogramm.

Mangel an Verallgemeinerungsfähigkeit

Das Lösen von Benchmarking -Aufgaben garantiert nicht, dass KI ähnliche, leicht unterschiedliche Probleme bewältigen kann. Beispielsweise kann ein System, das in Untertitel eines Bildes trainiert ist, Schwierigkeiten haben, Untertitelbeschreibungen außerhalb seiner Trainingsdaten zu bearbeiten.

Enge Aufgabendefinition

Benchmarks konzentrieren sich normalerweise auf Aufgaben wie Klassifizierung, Übersetzung oder Zusammenfassung. Diese Aufgaben testen keine breitere Palette von Fähigkeiten wie Argumentation, Kreativität oder ethische Entscheidungsfindung.

Sich auf sinnvollere Benchmarks bewegen

Die Einschränkungen von Benchmarks mit Puzzle-Lösung erfordern, dass wir die Art und Weise, wie wir die KI bewerten, ändern. Hier sind einige empfohlene Möglichkeiten, um die KI -Benchmarks neu zu definieren:

Missionssimulation der realen Welt

Benchmarks können dynamische Umgebungen in realer Welt anstelle von statischen Datensätzen einnehmen, in denen sich AI-Systeme an sich ändernde Bedingungen anpassen müssen. Google hat beispielsweise bereits durch Initiativen wie Genie 2, ein großflächiges Modell der Welt, daran gearbeitet. Weitere Details finden Sie in ihrem DeepMind -Blog und in den Artikeln von Analytics Vidhya.

- Simulationsmittel: Testen Sie die KI in einer offenen Umgebung wie Minecraft oder Robotersimulation, um ihre Fähigkeiten und Anpassungsfähigkeit der Problemlösung zu bewerten.

- Komplexe Szenarien: KI in reale Branchen (wie Gesundheitswesen, Klimaemodellierung) einsetzen, um ihren Nutzen in praktischen Anwendungen zu bewerten.

Langfristige Planung und Argumentation

Benchmarks sollten die Fähigkeit der KI testen, Aufgaben auszuführen, die eine langfristige Planung und Argumentation erfordern. Zum Beispiel:

- Multi-Step-Problemlösung muss im Laufe der Zeit verstanden werden.

- Aufgaben, die sich selbst neu lernt.

Ethik und soziales Bewusstsein

Da KI -Systeme zunehmend mit Menschen interagieren, müssen Benchmarks ethisches Denken und soziales Verständnis messen. Dies beinhaltet die Einbeziehung von Sicherheitsmaßnahmen und regulatorischen Schutzmaßnahmen, um die verantwortungsvolle Nutzung von KI -Systemen sicherzustellen. Die jüngsten Bewertungen des Roten Teams bieten einen umfassenden Rahmen für das Testen der Sicherheit und Glaubwürdigkeit von KI in sensiblen Anwendungen. Benchmarks müssen auch sicherstellen, dass KI-Systeme in Szenarien, die sensible Daten beinhalten, faire und unparteiische Entscheidungen treffen und ihre Entscheidungen transparent auf Nicht-Experten interpretieren. Durch die Implementierung von Sicherheitsmaßnahmen und regulatorischen Schutzmaßnahmen können Risiken reduziert werden und gleichzeitig das Vertrauen in KI -Anwendungen verbessert werden. Zu Nicht-Experten.

Cross-Domänen-Generalisierungsfähigkeit

Benchmarks sollten die Fähigkeit von KI testen, in mehreren nicht verwandten Aufgaben zu verallgemeinern. Beispielsweise ist ein einzelnes KI-System in Bezug auf Sprachverständnis, Bilderkennung und Robotik gut ab, ohne dass für jedes Feld spezielle Feinabstimmungen erforderlich sind.

Die Zukunft des AI -Benchmarking

Während sich das KI -Feld weiterentwickelt, müssen sich auch seine Benchmarks entwickeln. Wenn Sie über die Benchmarks von Rätsellösung hinausgehen, müssen sie die Zusammenarbeit zwischen Forschern, Praktikern und politischen Entscheidungsträgern erfordern, um Benchmarks zu entwerfen, die den Bedürfnissen und Werten der realen Welt erfüllen. Diese Benchmarks sollten betonen:

- Anpassungsfähigkeit: Die Fähigkeit, verschiedene unsichtbare Aufgaben zu erledigen.

- Auswirkungen: Messung der Beiträge zu sinnvollen sozialen Herausforderungen.

- Ethik: Stellen Sie sicher, dass KI mit den menschlichen Werten und Fairness übereinstimmt.

Abschluss

Die Beobachtungen von Karpathy veranlassten uns, den Zweck und das Design von AI -Benchmarks zu überdenken. Während die Benchmarks zur Lösung von Puzzle unglaubliche Fortschritte getrieben haben, können sie uns nun daran hindern, ein breiteres, wirkungsvolleres KI-System zu implementieren. Die KI-Community muss sich dem Benchmarking-Test-Test-Anpassungsfähigkeit, der Generalisierungsfähigkeiten und des realen Dienstprogramms zuwenden, um das wahre Potenzial von KI freizuschalten.

Der Weg nach vorne ist nicht einfach, aber die Belohnungen - nicht nur leistungsstarke, sondern wirklich transformative KI -Systeme - sind die Mühe wert.

Was denkst du darüber? Bitte teilen Sie uns im Kommentarbereich unten mit!

Das obige ist der detaillierte Inhalt vonAndrej Karpathie auf Puzzlungslösungs-Benchmarks. Für weitere Informationen folgen Sie bitte anderen verwandten Artikeln auf der PHP chinesischen Website!

Heiße KI -Werkzeuge

Undresser.AI Undress

KI-gestützte App zum Erstellen realistischer Aktfotos

AI Clothes Remover

Online-KI-Tool zum Entfernen von Kleidung aus Fotos.

Undress AI Tool

Ausziehbilder kostenlos

Clothoff.io

KI-Kleiderentferner

Video Face Swap

Tauschen Sie Gesichter in jedem Video mühelos mit unserem völlig kostenlosen KI-Gesichtstausch-Tool aus!

Heißer Artikel

Heiße Werkzeuge

Notepad++7.3.1

Einfach zu bedienender und kostenloser Code-Editor

SublimeText3 chinesische Version

Chinesische Version, sehr einfach zu bedienen

Senden Sie Studio 13.0.1

Leistungsstarke integrierte PHP-Entwicklungsumgebung

Dreamweaver CS6

Visuelle Webentwicklungstools

SublimeText3 Mac-Version

Codebearbeitungssoftware auf Gottesniveau (SublimeText3)

Heiße Themen

1675

1675

14

14

1429

1429

52

52

1333

1333

25

25

1278

1278

29

29

1257

1257

24

24

Wie baue ich multimodale KI -Agenten mit AGNO -Framework auf?

Apr 23, 2025 am 11:30 AM

Wie baue ich multimodale KI -Agenten mit AGNO -Framework auf?

Apr 23, 2025 am 11:30 AM

Während der Arbeit an Agentic AI navigieren Entwickler häufig die Kompromisse zwischen Geschwindigkeit, Flexibilität und Ressourceneffizienz. Ich habe den Agenten-KI-Framework untersucht und bin auf Agno gestoßen (früher war es phi-

OpenAI-Verschiebungen Fokus mit GPT-4.1, priorisiert die Codierung und Kosteneffizienz

Apr 16, 2025 am 11:37 AM

OpenAI-Verschiebungen Fokus mit GPT-4.1, priorisiert die Codierung und Kosteneffizienz

Apr 16, 2025 am 11:37 AM

Die Veröffentlichung umfasst drei verschiedene Modelle, GPT-4.1, GPT-4.1 Mini und GPT-4.1-Nano, die einen Zug zu aufgabenspezifischen Optimierungen innerhalb der Landschaft des Großsprachenmodells signalisieren. Diese Modelle ersetzen nicht sofort benutzergerichtete Schnittstellen wie

Wie füge ich eine Spalte in SQL hinzu? - Analytics Vidhya

Apr 17, 2025 am 11:43 AM

Wie füge ich eine Spalte in SQL hinzu? - Analytics Vidhya

Apr 17, 2025 am 11:43 AM

SQL -Änderungstabellanweisung: Dynamisches Hinzufügen von Spalten zu Ihrer Datenbank Im Datenmanagement ist die Anpassungsfähigkeit von SQL von entscheidender Bedeutung. Müssen Sie Ihre Datenbankstruktur im laufenden Flug anpassen? Die Änderungstabelleerklärung ist Ihre Lösung. Diese Anleitung Details Hinzufügen von Colu

Neuer kurzer Kurs zum Einbetten von Modellen von Andrew NG

Apr 15, 2025 am 11:32 AM

Neuer kurzer Kurs zum Einbetten von Modellen von Andrew NG

Apr 15, 2025 am 11:32 AM

Schalte die Kraft des Einbettungsmodelle frei: einen tiefen Eintauchen in den neuen Kurs von Andrew Ng Stellen Sie sich eine Zukunft vor, in der Maschinen Ihre Fragen mit perfekter Genauigkeit verstehen und beantworten. Dies ist keine Science -Fiction; Dank der Fortschritte in der KI wird es zu einem R

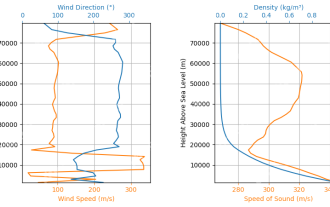

Raketenstartsimulation und -analyse unter Verwendung von Rocketpy - Analytics Vidhya

Apr 19, 2025 am 11:12 AM

Raketenstartsimulation und -analyse unter Verwendung von Rocketpy - Analytics Vidhya

Apr 19, 2025 am 11:12 AM

Simulieren Raketenstarts mit Rocketpy: Eine umfassende Anleitung Dieser Artikel führt Sie durch die Simulation von Rocketpy-Starts mit hoher Leistung mit Rocketpy, einer leistungsstarken Python-Bibliothek. Wir werden alles abdecken, von der Definition von Raketenkomponenten bis zur Analyse von Simula

Google enthüllt die umfassendste Agentenstrategie bei Cloud nächsten 2025

Apr 15, 2025 am 11:14 AM

Google enthüllt die umfassendste Agentenstrategie bei Cloud nächsten 2025

Apr 15, 2025 am 11:14 AM

Gemini als Grundlage der KI -Strategie von Google Gemini ist der Eckpfeiler der AI -Agentenstrategie von Google und nutzt seine erweiterten multimodalen Funktionen, um Antworten auf Text, Bilder, Audio, Video und Code zu verarbeiten und zu generieren. Entwickelt von Deepm

Open Source Humanoide Roboter, die Sie 3D selbst ausdrucken können: Umarme Gesicht kauft Pollenroboter

Apr 15, 2025 am 11:25 AM

Open Source Humanoide Roboter, die Sie 3D selbst ausdrucken können: Umarme Gesicht kauft Pollenroboter

Apr 15, 2025 am 11:25 AM

"Super froh, Ihnen mitteilen zu können, dass wir Pollenroboter erwerben, um Open-Source-Roboter in die Welt zu bringen", sagte Hugging Face auf X.

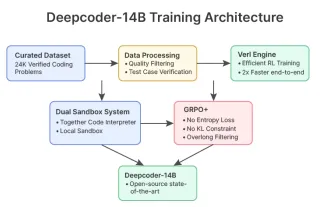

DeepCoder-14b: Der Open-Source-Wettbewerb mit O3-Mini und O1

Apr 26, 2025 am 09:07 AM

DeepCoder-14b: Der Open-Source-Wettbewerb mit O3-Mini und O1

Apr 26, 2025 am 09:07 AM

In einer bedeutenden Entwicklung für die KI-Community haben Agentica und gemeinsam KI ein Open-Source-KI-Codierungsmodell namens DeepCoder-14b veröffentlicht. Angebotsfunktionen der Codegenerierung mit geschlossenen Wettbewerbern wie OpenAI,